来源:https://www.cnblogs.com/weiluoyan/p/11772319.html

以下为复制内容:

我们这个项目有个接口因为数据比较多,返回的json串就特别长,你用curl调这个接口,发现返回的json串被截断。

解决:

- 1、首先查看nginx的error日志,会有报错提示,类似:nginx的目录明下的文件 failed(13: Permission denied) while reading upstream, client:...,server:…

- 2、看报错提示是没有权限,原因就是nginx存在一个buffer的机制,在数据过大超出缓冲区的 最大容量,会将数据写入临时文件(临时目录),而此时如果你安装的nginx的用户权限不是 服务器权限,就会报没有权限的问题,因为此时没有权限,所以再返回时,超出缓冲区的数据将丢失, 就会出现截断。

- 3、最后将nginx的目录赋予权限就可以了

- 4、执行操作: sudo chown -R www:root nginx目录名称 chmod -R 764 /usr/local/nginx/临时目录名称

补充:

对于来自fastcgi server的response,nginx将其缓冲到内存中,然后依次发送到客户端浏览器,缓冲区的大小由fastcgi_buffers和fasecgi_buffer_size两个值控制,比如一下配置:fastcgi_buffer 8 128;此处代表nginx设置8个128k的块进行缓存,总共大小是8*128k

fastcgi_buffer_size 128k; 此处代表每块大小,用于指定读取fastcgi应答第一部分需要用 多大的缓冲区,这个值表示将使用1个128kb的缓冲区读取应答的一部分(应答头),可以设置 为fastcgi_buffers选项指定的缓冲区大小。

fastcgi_buffers : 指定本地需要用多少和多大的缓冲区来缓冲FastCGI的应答请求。如果一个PHP脚本所产生的页面大小为256KB,那么会为其分配4个64KB的缓冲区来缓存; 如果页面大小大于256KB,那么大于256KB的部分会缓存到fastcgi_temp指定的路径中, 但是这并不是好方法,因为内存中的数据处理速度要快于硬盘。一般这个值应该为站点中PHP脚本 所产生的页面大小的中间值,如果站点大部分脚本所产生的页面大小为256KB,那么可以把这个值 设置为“16 16k”、“4 64k”等。

所以总计能创建的最大内存缓冲区大小是 464K+64K = 320k。而这些缓冲区是根据实际的 Response 大小动态生成的,并不是一次性创建的。比如一个 128K 的页面,Nginx 会创建 264K 共 2 个 buffers。

当 Response 小于等于 320k 时,所有数据当然全部在内存中处理。如果 Response 大于 320k 呢? fastcgi_temp 的作用就在于此。多出来的数据会被临时写入到文件中,放在这个目录下面。

内存中缓冲了 320K,剩下的会写入的文件中。而实际的情况是,运行 Nginx Process 的用户并没有fastcgi_temp 目录的写权限,于是剩下的数据就丢失掉了。

以上就是对自己遇到的一个问题做了一个总结。

以下为原创内容:

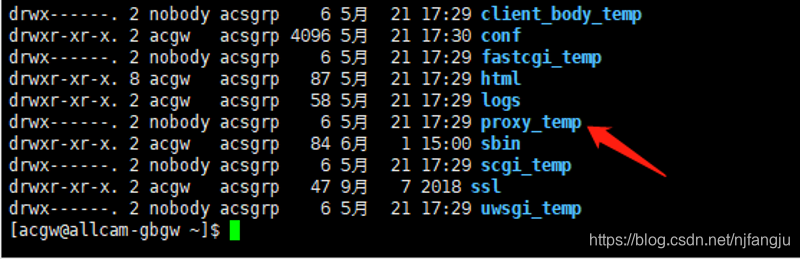

在实战中遇到的问题并没有通过修改nginx配置文件解决,加了相关配置依然会有同样的问题,然后修改了acgw的临时目录 proxy_temp 的权限才将问题解决:

本来是nobody:acsgrp 改成了acgw:acsgrp

原因:nginx对于小的反向代理请求是使用内存作中转,对于稍微大一点的,是使用临时文件系统来做中转的,临时文件目录/usr/local/nginx/proxy_temp,而对这个目录没有读写权限,导致数据不全。

解决:然后让运维看了下nginx的日志和目录权限,发现确实如此,给临时文件目录加上读写权限,搞定。

来源:https://blog.csdn.net/njfangju/article/details/106772846

相关推荐

错误 101 (net--ERR_CONNECTION_RESET).docx

在开发Vue应用时,开发者可能会遇到“net :ERR_CONNECTION_REFUSED”错误,这通常表示浏览器无法连接到指定的服务器。这个错误可能出现在多种场景下,比如本地开发环境配置不正确或者网络环境变化等。本文将重点讲解...

4. 未配置CORS时,运行项目,浏览器会因跨域限制而返回错误。 5. 使用NuGet在WebApiCORS项目中添加CORS支持,然后在App_Start/WebApiConfig.cs中配置允许跨域。例如,使用`config.EnableCors(new ...

在使用Chrome浏览器访问网站时,新版MacOS的用户可能会遇到一个特定的错误提示——"NET::ERR_CERT_WEAK_KEY"。这个问题的出现往往是由于网站SSL证书中的加密密钥强度不足以满足当前的安全标准。针对这一问题,本文将...

在Google chrome开发人员控制台中一直报此错误。(虽然只是一个警告,但是体验还是非常不好) 先说解决方案: 第一种: 在Google chrome浏览器调试工具中,设置该调试工具,点开之后选择Settings 关闭此选项 ...

- 返回的不再是纯JSON数据,而是`callback(data)`这样的格式,其中`callback`是客户端传来的函数名,`data`是JSON数据。 - ASP.NET中,可以使用C#编写控制器或API来处理这个逻辑。 3. **响应与执行**: - 浏览器...

https请求出现net::ERR-CACHE-MISS

解决 Tomcat 配置 SSL 错误的解决办法 在 Tomcat 服务器中配置 SSL 加密连接是非常重要的,然而在 Tomcat 6.0.33 版本中,默认启用了 APR(APR 是通过 JNI 访问的可移植库,可以提高 Tomcat 的性能和伸缩性),这...

2. **服务器返回的数据格式**:`ajaxFileUpload`可能期待特定的JSON格式或字符串作为成功响应。如果服务器返回的数据不符合这些预期,即使状态码是200,也可能触发error回调。检查服务器返回的数据格式,确保符合...

burp的Cert证书

ERR_CONNECTION_RESET的解释是:ERR-错误CONNECTION-连接-RESET-重复 Google没有对此错误的解决方案因此会再次提示用户这个网站含有未知错误

标题中的“谷歌浏览器Charset.crx”指的是一个针对谷歌浏览器(Google Chrome)的扩展插件,其文件名为"Charset_v0.4.1.crx"。这个插件的主要功能可能与字符集(Charset)有关,可能是为了帮助用户解决网页编码问题...

问题:wx.requset请求出错net::ERR_CONNECTION_RESET 源代码如下: wx.request({ url: 'https://www.dinggestyle.com/API/GetOrgList', data: { OrgType: 0 }, method: 'GET', success: function (res) { ... ...

常见问题

常见的错误

项目中碰到的,记录一下

标题中的"解决报错ERR_UNKNOWN_URL_SCHEME源码.zip"表明这是一个关于修复Android应用程序中出现的"ERR_UNKNOWN_URL_SCHEME"错误的代码解决方案。这个错误通常发生在尝试在Android的WebView组件中加载一个不支持或...

常见问题解决方案

这个错误是在Master进程向子进程send消息时发现pipe已经关闭了的情况下由Master进程报出来的。 2019-12-16 14:33:02,pid-170096, Error [ERR_IPC_CHANNEL_CLOSED]: channel closed at ChildProcess.target.send ...