Õå│ńŁ¢µĀæ

Õå│ńŁ¢µĀæµś»õĖĆõĖ¬ķó䵥ŗµ©ĪÕ×ŗ’╝īÕ«āõ╗ŻĶĪ©ńÜ䵜»Õ»╣Ķ▒ĪÕ▒׵ƦõĖÄÕ»╣Ķ▒ĪÕĆ╝õ╣ŗķŚ┤ńÜäõĖĆń¦ŹµśĀÕ░äÕģ│ń│╗ŃĆéµĀæõĖŁµ»ÅõĖ¬ĶŖéńé╣ĶĪ©ńż║µ¤ÉõĖ¬Õ»╣Ķ▒Ī’╝īĶĆīµ»ÅõĖ¬ÕłåÕÅēĶĘ»ÕŠäÕłÖõ╗ŻĶĪ©ńÜ䵤ÉõĖ¬ÕÅ»ĶāĮńÜäÕ▒׵ƦÕĆ╝’╝īĶĆīµ»ÅõĖ¬ÕÅČń╗ōńé╣ÕłÖÕ»╣Õ║öõ╗ĵĀ╣ĶŖéńé╣Õł░Ķ»źÕÅČĶŖéńé╣µēĆń╗ÅÕÄåńÜäĶĘ»ÕŠäµēĆĶĪ©ńż║ńÜäÕ»╣Ķ▒ĪńÜäÕĆ╝ŃĆé

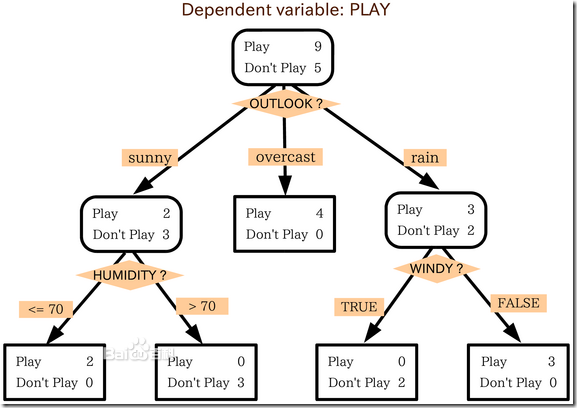

Ķ┐ÖÕ╝ĀÕøŠÕŠłÕźĮÕ£░Ķ¦ŻķćŖõ║åÕå│ńŁ¢µĀæ’╝Ü

µśÄÕż®Ķ”üõĖŹĶ”üÕć║ÕÄ╗ńÄ®’╝¤

- µÖ┤Õż®’╝Ü

- µĮ«µ╣┐’╝ÜõĖŹÕć║ÕÄ╗

- õĖŹµĮ«µ╣┐’╝ÜÕć║ÕÄ╗

- ķś┤Õż®’╝ÜÕć║ÕÄ╗ńÄ®

- ķø©Õż®’╝Ü

- Õł«ķŻÄ’╝ÜõĖŹÕć║ÕÄ╗

- õĖŹÕł«ķŻÄ’╝ÜÕć║ÕÄ╗

õŠŗÕŁÉõĖŁÕÅ»õ╗źµēŠÕł░õĖżÕ▒éńÜäÕłåń▒╗õŠØµŹ«Õ▒׵Ʀ’╝īń¼¼õĖĆÕ▒鵜»µÖ┤/ķś┤/ķø©’╝īń¼¼õ║īÕ▒鵜»µś»ÕÉ”µĮ«µ╣┐ÕÆīµś»ÕÉ”Õł«ķŻÄ’╝īÕłåń▒╗õŠØµŹ«ńÜäńĪ«Õ«ÜÕÆīÕģłÕÉÄķĪ║Õ║ÅÕ»╣Õå│ńŁ¢µĀæńÜäĶ┤©ķćŵ£ēÕå│Õ«ÜµĆ¦ńÜäÕĮ▒ÕōŹŃĆéÕÅ”Õż¢’╝īÕ£©Õ«×ķÖģµ×äķĆĀÕå│ńŁ¢µĀæµŚČ’╝īń╗ÅÕĖĖĶ”üĶ┐øĶĪīÕē¬µ×Ø’╝īõĖ╗Ķ”üµś»ÕøĀõĖ║µĢ░µŹ«õĖŁÕŠĆÕŠĆÕŁśÕ£©õĖĆõ║øÕÖ¬ķ¤│µĢ░µŹ«’╝īµł¢ĶĆģµś»ÕŁśÕ£©Õłåń▒╗Ķ┐ćń╗åńÜäķŚ«ķóś’╝īÕÅŹĶĆīÕż▒ÕÄ╗õ║åÕłåń▒╗ńÜäµäÅõ╣ēŃĆéõĖĆń¦Źµś»ÕģłÕē¬µ×Ø’╝īÕ£©µ×äķĆĀµĀæńÜäĶ┐ćń©ŗõĖŁ’╝īÕĮōµ¤ÉõĖ¬ĶŖéńé╣µ╗ĪĶČ│Õē¬µ×صØĪõ╗Č’╝īÕłÖńø┤µÄźÕü£µŁóµŁżÕłåµö»ńÜäµ×äķĆĀ’╝øĶ┐śµ£ēõĖĆń¦Źµś»ÕÉÄÕē¬µ×Ø’╝īÕģłµ×äķĆĀÕ«īµłÉÕ«īµĢ┤ńÜäÕå│ńŁ¢µĀæ’╝īÕåŹķĆÜĶ┐浤Éõ║øµØĪõ╗ČķüŹÕÄåµĀæĶ┐øĶĪīÕē¬µ×ØŃĆé

ID3ń«Śµ│Ģ

ID3ń«Śµ│Ģµś»J. Ross QuinlanµÅÉÕć║ńÜäÕłåń▒╗ķó䵥ŗń«Śµ│Ģ’╝īÕ«āńÜäµĀĖÕ┐āµś»ńö©Ķ┤¬Õ┐āń«Śµ│ĢµØźµĀ╣µŹ«ŌĆ£õ┐Īµü»ńåĄŌĆØÕłåń▒╗ŃĆéõĮĢõĖ║õ┐Īµü»ńåĄ’╝¤Ķ┐ÖõĖ¬µ”éÕ┐ĄĶ┐śµś»ķ”ÖÕ壒╝łC. E. Shannon’╝ēµÅÉÕć║µØźńÜä’╝īńö©õ╗źĶĪ©ńż║õ┐Īµü»ńÜäõĖŹńĪ«Õ«ÜµĆ¦ŃĆéõ┐Īµü»õĖŹńĪ«Õ«ÜńÜäÕøĀń┤ĀĶČŖÕżÜ’╝īĶ┐ÖõĖ¬ńåĄÕ░▒ĶČŖÕż¦ŃĆé

Õ”éµ×£õĖĆń╗äµĢ░µŹ«ńö▒{d1,d2,ŌĆ”,dn}µ×䵳ɒ╝īÕģČÕÆīµś»sum’╝īķéŻõ╣łõ┐Īµü»ńåĄÕÅ»õ╗źĶĪ©ńż║õĖ║’╝Ü

õĖŗķØóõĖŠõŠŗµØźĶ»┤µśÄĶ┐ÖõĖ¬Õģ¼Õ╝Å’╝Ü

ÕüćõĮ┐Ķ»┤µłæõ╗¼Ķ”üńĀöń®ČńŗŚńÜäµÖ║ÕĢå’╝łńø«µĀćÕ▒׵Ʀ’╝ē’╝īµĮ£Õ£©ńÜäÕģ│ĶüöÕøĀń┤ĀÕīģµŗ¼ķó£Ķē▓ÕÆīµ»øńÜäķĢ┐Õ║”ŃĆé

| ķó£Ķē▓’╝łcolor’╝ē | µ»øńÜäķĢ┐Õ║”’╝łlength’╝ē | µÖ║ÕĢå’╝łIQ’╝ē |

| black | ķĢ┐ | ķ½ś |

| white | ķĢ┐ | ķ½ś |

| white | ń¤Ł | ķ½ś |

| white | ń¤Ł | õĮÄ |

3µ¼ĪÕć║ńÄ░ŌĆ£ķ½śŌĆصÖ║ÕĢå’╝ī1µ¼ĪÕć║ńÄ░ŌĆ£õĮĵÖ║ÕĢåŌĆØ’╝īµēĆõ╗źńø«µĀćÕ▒׵ƦIQńÜäõ┐Īµü»ńåĄ’╝ÜHIQ(D)=-(2/4)log2(2/4)-(1/4)log2(1/4)

colorÕ▒×µĆ¦Õ£©ÕÅ¢õĖŹÕÉīńÜäÕĆ╝Õ»╣Õ║öńø«µĀćÕ▒׵ƦIQńÜäõ┐Īµü»ńåĄ’╝Ü

- Õ£©colorÕÅ¢ÕĆ╝õĖ║blackńÜ䵌ČÕĆÖ’╝īIQÕŬÕÅ¢ŌĆ£ķ½śŌĆØĶ┐ÖõĖ¬ÕĆ╝’╝ÜHcolor(Dblack)=-(1/1)log2(1/1)

- Õ£©colorÕÅ¢ÕĆ╝õĖ║whiteńÜ䵌ČÕĆÖ’╝īIQÕÅ¢ÕĆ╝µ£ēõĖżõĖ¬ŌĆ£ķ½śŌĆØ’╝īõĖĆõĖ¬ŌĆ£õĮÄŌĆØ’╝ÜHcolor(Dwhite)=-(1/3)log2(1/3)-(2/3)log2(2/3)

ĶĆīcolorÕ▒׵ƦńÜäµĢ┤õĮōõ┐Īµü»ńåĄµś»õĖŖĶ┐░õ║īĶĆģńÜäÕŖĀµØāÕ╣│ÕØćÕĆ╝’╝ÜHcolor(D)=(1/4)Hcolor(Dblack)+(3/4)Hcolor(Dwhite)ŃĆéÕÉīµĀĘÕÅ»õ╗źµ▒éÕŠŚHlength(D)ŃĆé

ńÄ░Õ£©Õ«Üõ╣ēõ┐Īµü»Õó×ńøŖGaincolor=HIQ(D)-Hcolor(D)’╝īGainlength=HIQ(D)-Hlength(D)’╝īÕ«āµś»õ┐Īµü»ńåĄńÜäµ£ēµĢłÕćÅÕ░æķćÅ’╝īÕĆ╝ĶČŖķ½ś’╝īĶ»┤µśÄńø«µĀćÕ▒׵ƦIQÕ£©ÕÅéĶĆāÕ▒×µĆ¦ÕżäµŹ¤Õż▒ńÜäõ┐Īµü»ńåĄĶČŖÕżÜ’╝īõ╣¤Õ░▒µś»Õż▒ÕÄ╗ńÜäõĖŹńĪ«Õ«ÜµĆ¦ĶČŖÕżÜ’╝īķéŻõ╣łÕ£©Õå│ńŁ¢µĀæĶ┐øĶĪīÕłåń▒╗ńÜ䵌ČÕĆÖ’╝īĶ┐ÖõĖ¬ÕÅéĶĆāÕ▒׵ƦÕ║öĶ»źĶČŖµŚ®õĮ£õĖ║Õå│ńŁ¢ńÜäõŠØµŹ«Õ▒׵ƦŃĆé

Ķ┐ÖõĖ¬õŠŗÕŁÉõĖŁÕ”éµ×£Gainlength┬Ā> Gaincolor’╝īĶ»┤µśÄlengthµ»öcolorĶ”üÕ»╣IQµ£ēµø┤Õż¦ńÜäÕĮ▒ÕōŹ’╝īµēĆõ╗źÕå│ńŁ¢µĀæõĖŁ’╝īĶ”üÕģłõŠØµŹ«lengthµØźĶ┐øĶĪīÕłåń▒╗ŃĆé

Õ£©Õ«×ķÖģÕ║öńö©õĖŁ’╝īÕŠĆÕŠĆÕ╝ĢÕģźõĖĆõĖ¬ŌĆ£ķśłÕĆ╝ŌĆØ’╝īÕĮōĶŖéńé╣õĖŗńÜäõ╗╗µäÅõĖĆÕłåń▒╗µēĆÕŹĀńÖŠÕłåµ»öĶČģĶ┐ćĶ┐ÖõĖ¬ķśłÕĆ╝µŚČ’╝īÕ░▒õĖŹÕåŹĶ┐øĶĪīÕłåń▒╗’╝īõ╗źķü┐ÕģŹõ║¦ńö¤Õć║Ķ┐ćÕ░ÅńÜäµ▓Īµ£ēÕ«×ķÖģµäÅõ╣ēÕłåń▒╗ĶŖéńé╣ŃĆé

ID3ń«Śµ│Ģõ╣¤ÕŁśÕ£©Ķ»ĖÕżÜõĖŹĶČ│’╝īµ»öÕ”éÕłåń▒╗ÕüÅÕÉæõ║ÄÕÅ¢ÕĆ╝µĢ░ķćÅ’╝īÕŬĶāĮÕżäńÉåń”╗µĢŻµĢ░µŹ«ńŁēńŁēķŚ«ķóśŃĆéC4.5ń«Śµ│Ģµś»Õ»╣ID3ńÜäõĖĆõĖ¬µö╣Ķ┐ø’╝īõĮåµś»µĆ╗õĮōµØźń£ŗ’╝īńö▒õ║Äķ£ĆĶ”üÕÅŹÕżŹķüŹÕÄåµĢ░µŹ«’╝īõ║īĶĆģķāĮµś»µĢłńÄćÕŠłõĮÄńÜäń«Śµ│ĢŃĆé

µ¢ćń½Āń│╗µ£¼õ║║ÕÄ¤Õłø’╝īĶĮ¼ĶĮĮĶ»Ęõ┐صīüÕ«īµĢ┤µĆ¦Õ╣ȵ│©µśÄÕć║Ķć¬ŃĆŖÕøøńü½ńÜäÕöĀÕÅ©ŃĆŗ

ńøĖÕģ│µÄ©ĶŹÉ

µĆ╗ńÜäµØźĶ»┤’╝īID3ń«Śµ│Ģµś»ńÉåĶ¦ŻÕÆīÕŁ”õ╣ĀÕå│ńŁ¢µĀæń«Śµ│ĢńÜäõĖĆõĖ¬ķćŹĶ”üĶĄĘńé╣’╝īķĆÜĶ┐ćÕ«āńÜäÕ«×ńÄ░’╝īµłæõ╗¼ÕÅ»õ╗źõ║åĶ¦ŻÕå│ńŁ¢µĀæńÜäÕ¤║µ£¼µ×äķĆĀÕĤńÉåÕÆīÕłåń▒╗Ķ┐ćń©ŗŃĆéÕ£©Õ«×ķÖģÕ║öńö©õĖŁ’╝īńö▒õ║ÄID3Õ»╣õ║ÄĶ┐×ń╗ŁÕ×ŗÕ▒׵ƦÕÆīń╝║Õż▒ÕĆ╝ńÜäÕżäńÉåĶŠāõĖ║Õ▒ĆķÖÉ’╝īÕÉÄń╗ŁńÜäC4.5ÕÆīCARTń«Śµ│ĢÕ»╣ÕģČĶ┐øĶĪī...

ID3’╝łIterative Dichotomiser 3’╝ēń«Śµ│Ģµś»Õå│ńŁ¢µĀæÕŁ”õ╣Āµ¢╣µ│ĢńÜäõĖĆń¦Ź’╝īńö▒Ross Quinlanõ║Ä1986Õ╣┤µÅÉÕć║’╝īõĖ╗Ķ”üńö©õ║ÄÕłåń▒╗õ╗╗ÕŖĪŃĆéÕ£©µ£¼ķĪ╣ńø«õĖŁ’╝īµłæõ╗¼Õ░åµĘ▒ÕģźµÄóĶ«©ID3ń«Śµ│ĢńÜäÕĤńÉåõ╗źÕÅŖÕ”éõĮĢõĮ┐ńö©C++Ķ┐øĶĪīÕ«×ńÄ░ŃĆé ID3ń«Śµ│ĢÕ¤║õ║Äõ┐Īµü»ńåĄÕÆīõ┐Īµü»Õó×ńøŖµØź...

### Õ║öńö©C4.5ń«Śµ│Ģµ×äķĆĀÕ«óµłĘÕłåń▒╗Õå│ńŁ¢µĀæńÜäµ¢╣µ│Ģ #### õĖĆŃĆüÕå│ńŁ¢µĀæńö¤µłÉńÜäÕ¤║µ£¼Ķ┐ćń©ŗÕÅŖńøĖÕģ│ń«Śµ│Ģ ##### 1.1 Õå│ńŁ¢µĀæµ”éĶ┐░ Õå│ńŁ¢µĀæµś»õĖĆń¦Źń▒╗õ╝╝µĄüń©ŗÕøŠńÜäµĀæńŖČń╗ōµ×ä’╝īÕ£©µĢ░µŹ«µī¢µÄśķóåÕ¤¤õĖŁĶó½Õ╣┐µ│øÕ║öńö©õ║ÄÕłåń▒╗õ╗╗ÕŖĪŃĆéÕ£©Õå│ńŁ¢µĀæõĖŁ’╝īµ»ÅõĖ¬Õåģķā©ĶŖéńé╣...

Õģ│ķö«µ¢╣µ│ĢÕÅ»ĶāĮÕīģµŗ¼`buildTree()`ńö©õ║ĵ×äķĆĀÕå│ńŁ¢µĀæ’╝ī`splitData()`ńö©õ║ĵĢ░µŹ«ÕłÆÕłå’╝īõ╗źÕÅŖ`evaluateInstance()`ńö©õ║ÄĶ»äõ╝░Õ«×õŠŗÕ╣ČõĮ£Õć║ķó䵥ŗŃĆé `FormatTrans.java`µ¢ćõ╗ČÕÅ»ĶāĮµś»µĢ░µŹ«ķóäÕżäńÉåķā©Õłå’╝īĶ┤¤Ķ┤ŻÕ░åÕĤզŗµĢ░µŹ«ĶĮ¼Õī¢õĖ║C4.5ń«Śµ│ĢÕÅ»õ╗ź...

ID3’╝łIterative Dichotomiser 3’╝ēµś»Õå│ńŁ¢µĀæÕŁ”õ╣Āń«Śµ│ĢńÜäõĖĆń¦Ź’╝īńö▒Ross Quinlanõ║Ä1986Õ╣┤µÅÉÕć║ŃĆéÕ«āµś»õĖĆń¦ŹÕ¤║õ║Äõ┐Īµü»ńåĄÕÆīõ┐Īµü»Õó×ńøŖµØźµ×äÕ╗║Õå│ńŁ¢µĀæńÜäń«Śµ│Ģ’╝īõĖ╗Ķ”üńö©õ║ÄÕłåń▒╗õ╗╗ÕŖĪŃĆéID3ń«Śµ│ĢńÜäµĀĖÕ┐āµĆصā│µś»ķĆÜĶ┐ćõĖŹµ¢ŁÕ£░ÕłÆÕłåµĢ░µŹ«ķøå’╝īµēŠÕł░µ£ĆõĮ│...

ÕćåÕżćµĢ░µŹ«: µĀæµ×äķĆĀń«Śµ│Ģ’╝łĶ┐ÖķćīõĮ┐ńö©ńÜ䵜»ID3ń«Śµ│Ģ’╝īÕøĀµŁżµĢ░ÕĆ╝Õ×ŗµĢ░µŹ«Õ┐ģķĪ╗ń”╗µĢŻÕī¢ŃĆé’╝ē Õłåµ×ɵĢ░µŹ«: ÕÅ»õ╗źõĮ┐ńö©õ╗╗õĮĢµ¢╣µ│Ģ’╝īµ×äķĆĀµĀæÕ«īµłÉõ╣ŗÕÉÄ’╝īµłæõ╗¼ÕÅ»õ╗źÕ░åµĀæńö╗Õć║µØźŃĆé Ķ«Łń╗āń«Śµ│Ģ: µ×äķĆĀµĀæń╗ōµ×ä µĄŗĶ»Ģń«Śµ│Ģ: õĮ┐ńö©õ╣ĀÕŠŚńÜäÕå│ńŁ¢µĀæµē¦ĶĪīÕłåń▒╗ õĮ┐ńö©...

### C Õ«×ńÄ░Õå│ńŁ¢µĀæID3ń«Śµ│Ģ #### õĖĆŃĆüµ”éĶ¦ł µ£¼µ¢ćµĪŻµŚ©Õ£©Ķ¦Żµ×ÉõĖĆõĖ¬ńö©CĶ»ŁĶ©ĆÕ«×ńÄ░ńÜäÕå│ńŁ¢µĀæID3ń«Śµ│ĢńÜäõ╗ŻńĀüńē浫ĄŃĆéÕå│ńŁ¢µĀæµś»õĖĆń¦ŹÕĖĖńö©ńÜäµ£║ÕÖ©ÕŁ”õ╣Āµ¢╣µ│Ģ’╝īÕ╣┐µ│øÕ║öńö©õ║ÄÕłåń▒╗õĖÄÕø×ÕĮÆõ╗╗ÕŖĪõĖŁŃĆéID3’╝łIterative Dichotomiser 3’╝ēµś»Õå│ńŁ¢µĀæńÜäõĖĆń¦Ź...

õĖĆõĖ¬ń╗ÅÕģĖńÜäÕå│ńŁ¢µĀæń«Śµ│Ģµś»ID3ń«Śµ│Ģ’╝īÕ«āķĆÜĶ┐ćĶ«Īń«Śõ┐Īµü»Õó×ńøŖµØźķĆēµŗ®ńē╣ÕŠü’╝īńø«µĀ浜»µ×äÕ╗║õĖƵŻĄÕģʵ£ēµ£ĆÕ░ÅÕī¢ńåĄÕĆ╝’╝łµł¢µ£ĆÕż¦õ┐Īµü»Õó×ńøŖ’╝ēńÜäÕå│ńŁ¢µĀæŃĆéID3ńÜäõĖĆõĖ¬ķÖÉÕłČµś»Õ»╣ńē╣ÕŠüńÜäķÖÉÕłČ’╝īÕ«āÕŬĶāĮÕ║öńö©õ║ÄķéŻõ║øÕ▒׵ƦÕĆ╝µś»ÕÉŹõ╣ēÕ×ŗńÜäńē╣ÕŠüŃĆéõĖ║õ║åÕģŗµ£ŹĶ┐ÖõĖĆńé╣’╝ī...

µ×äķĆĀÕå│ńŁ¢µĀæńÜäĶ┐ćń©ŗµś»õĖĆõĖ¬ķĆÆÕĮÆńÜäÕå│ńŁ¢Ķ┐ćń©ŗ’╝īķĆÜĶ┐ćķĆēµŗ®µ£ĆÕģĘÕłåĶŠ©ÕŖøńÜäÕ▒׵ƦµØźÕłÆÕłåµĢ░µŹ«ķøå’╝īńø┤Õł░µēƵ£ēÕŁÉķøåńÜäµĢ░µŹ«Õ▒×õ║ÄÕÉīõĖĆń▒╗Õł½õĖ║µŁóŃĆé #### 1.3 ID3Õå│ńŁ¢µĀæń«Śµ│Ģµ©ĪÕ×ŗ ID3ń«Śµ│Ģµś»Õå│ńŁ¢µĀæń«Śµ│ĢõĖŁńÜäõĖĆń¦Źń╗ÅÕģĖÕ«×ńÄ░’╝īńö▒Ross QuinlanµÅÉÕć║’╝ī...

MatlabÕ«×ńÄ░Õå│ńŁ¢µĀæń«Śµ│Ģ’╝īõĮ┐ńö©ID3_2ÕćĮµĢ░Õ╣ČĶ«ŠĶ«Īõ║åÕŹüµīćõ║żÕÅēķ¬īĶ»ü’╝īÕÅ»µśŠńż║µ»ÅõĖƵ¼ĪńÜ䵩ĪÕ×ŗń▓ŠÕ║”ŃĆéĶĄäµ║ɵÅÉõŠøń▒╗õĖĆõĖ¬µĢ░µŹ«ķøåńö©õ║ĵ©ĪÕ×ŗĶ«Łń╗ā’╝īÕ░åõ╣ŗńø┤µÄźµø┐µŹóõĖ║Ķć¬ÕĘ▒ńÜäµĢ░µŹ«ÕŹ│ÕÅ»Ķ┐ÉĶĪīŃĆéµ£Ćń╗łńÜäÕå│ńŁ¢µĀæÕ╗║ń½ŗń╗ōµ×£õ╗źńö╗ÕøŠńÜäÕĮóÕ╝ÅĶĪ©ńż║’╝īÕ╣ČõĖöõĖ║µ»ÅõĖĆń▒╗...

ķĆÜĶ┐ćķśģĶ»╗ÕÆīńÉåĶ¦ŻĶ┐Öµ«Ąõ╗ŻńĀü’╝īõĮĀÕÅ»õ╗źõ║åĶ¦ŻÕł░Õ”éõĮĢÕżäńÉåµĢ░µŹ«ŃĆüĶ«Īń«Śõ┐Īµü»Õó×ńøŖÕ╣ȵ×äķĆĀÕå│ńŁ¢µĀæńÜäÕģĘõĮōµŁźķ¬żŃĆé Ķ┐ÖõĖ¬ķĪ╣ńø«Õ»╣õ║ÄÕŁ”õ╣ĀÕÆīńÉåĶ¦ŻID3ń«Śµ│ĢÕÅŖÕģČJavaÕ«×ńÄ░ķØ×ÕĖĖµ£ēÕĖ«ÕŖ®ŃĆéķĆÜĶ┐ćĶ┐ÉĶĪīõ╗ŻńĀü’╝īõĮĀÕÅ»õ╗źĶ¦éÕ»¤Õå│ńŁ¢µĀæńÜäńö¤µłÉĶ┐ćń©ŗ’╝īÕ╣Čń╗ōÕÉł`app.arff`...

1986Õ╣┤’╝īJ.R.QuinlanµÅÉÕć║õ║åID3ń«Śµ│Ģ’╝īĶ»źń«Śµ│ĢÕ¤║õ║Äõ┐Īµü»Õó×ńøŖÕĤńÉåµØźµ×äķĆĀÕå│ńŁ¢µĀæŃĆéÕ£©ID3ńÜäÕ¤║ńĪĆõĖŖ’╝īQuinlanÕÅłµÅÉÕć║õ║åC4.5ń«Śµ│Ģ’╝īÕ«āÕ£©ÕŠłÕżÜµ¢╣ķØóÕ»╣ID3Ķ┐øĶĪīõ║åµö╣Ķ┐øŃĆéĶ┐Öõ║øµö╣Ķ┐øÕīģµŗ¼ÕżäńÉåĶ┐×ń╗ŁÕ▒׵ƦŃĆüķś▓µŁóĶ┐ćµŗ¤ÕÉłõ╗źÕÅŖĶāĮÕż¤ÕżäńÉåń╝║Õż▒ÕĆ╝ńŁēŃĆé ...

"µĢ░µŹ«µī¢µÄśÕå│ńŁ¢µĀæID3ń«Śµ│Ģõ╝śÕī¢" µĢ░µŹ«µī¢µÄśµś»õ╗ÄÕż¦ķćŵĢ░µŹ«õĖŁµÅÉÕÅ¢Õć║ÕÅ»õ┐ĪŃĆüµ¢░ķó¢ŃĆüµ£ēµĢłÕ╣ČĶāĮĶó½õ║║ńÉåĶ¦ŻńÜ䵩ĪÕ╝ÅńÜäķ½śń║¦ÕżäńÉåĶ┐ćń©ŗŃĆéÕ«āµś»õĖĆķŚ©õ║żÕÅēÕŁ”ń¦æ’╝īµŖŖõ║║õ╗¼Õ»╣µĢ░µŹ«ńÜäÕ║öńö©õ╗ÄõĮÄÕ▒éµ¼ĪńÜäń«ĆÕŹĢµ¤źĶ»ó’╝īµÅÉÕŹćÕł░õ╗ÄÕż¦ķćŵĢ░µŹ«õĖŁµÅÉńé╝µ£ēõ╗ĘÕĆ╝ńÜäõ┐Īµü»’╝ī...

Õå│ńŁ¢µĀæÕŁ”õ╣Āń«Śµ│Ģµś»µ×äķĆĀÕå│ńŁ¢µĀæµØźÕÅæńÄ░µĢ░µŹ«õĖŁĶĢ┤µČĄńÜäÕłåń▒╗Ķ¦äÕłÖ’╝īµś»õĖĆń¦ŹķĆ╝Ķ┐æń”╗µĢŻÕćĮµĢ░ÕĆ╝ńÜäµ¢╣µ│ĢŃĆéÕå│ńŁ¢µĀæń«Śµ│ĢńÜäµĀĖÕ┐āÕåģÕ«╣µś»Õ”éõĮĢµ×äķĆĀń▓ŠÕ║”ķ½śŃĆüĶ¦äµ©ĪÕ░ÅńÜäÕå│ńŁ¢µĀæŃĆéµ£¼µ¢ćĶ»”ń╗åÕÅÖĶ┐░õ║åÕå│ńŁ¢µĀæÕĮÆń║│Õłåń▒╗ń«Śµ│ĢńÜäÕĤńÉåÕÅŖÕ║öńö©’╝īÕÉīµŚČõ╗ŗń╗Źõ║åÕå│ńŁ¢µĀæ...

ÕģĘõĮōÕ«×ńÄ░µŚČ’╝īÕÅ»õ╗źÕģłÕ░åµĢ░µŹ«ķøåĶĮ¼Õī¢õĖ║ńē╣ÕŠüÕÉæķćÅÕĮóÕ╝Å’╝īńäČÕÉÄķĆÜĶ┐ćķüŹÕÄåµĢ░µŹ«ķøåŃĆüĶ«Īń«Śõ┐Īµü»ńåĄÕÆīõ┐Īµü»Õó×ńøŖ’╝īµ×äķĆĀÕå│ńŁ¢µĀæŃĆéÕ£©Javaõ╗ŻńĀüõĖŁ’╝īÕÅ»õ╗źõĮ┐ńö©`ArrayList`ńŁēķøåÕÉłń▒╗µØźÕŁśÕ驵Ģ░µŹ«’╝īÕł®ńö©ķĆÆÕĮƵł¢µĀłńŁēµĢ░µŹ«ń╗ōµ×äµØźÕ«×ńÄ░µĀæńÜäµ×äÕ╗║ŃĆé µ£ĆÕÉÄ’╝ī...

Õå│ńŁ¢µĀæń«Śµ│Ģµ×äķĆĀÕå│ńŁ¢µĀæµØźÕÅæńÄ░µĢ░µŹ«õĖŁĶĢ┤µČĄńÜäÕłåń▒╗Ķ¦äÕłÖ’╝ÄÕ”éõĮĢµ×äķĆĀń▓ŠÕ║”ķ½śŃĆüĶ¦äµ©ĪÕ░ÅńÜäÕå│ńŁ¢µĀæµś»Õå│ńŁ¢µĀæń«Śµ│ĢńÜäµĀĖÕ┐āÕåģÕ«╣ŃĆéÕå│ńŁ¢µĀæµ×äķĆĀÕÅ»õ╗źÕłåõĖżµŁźĶ┐øĶĪīŃĆéń¼¼õĖƵŁź’╝īÕå│ńŁ¢µĀæńÜäńö¤µłÉ’╝Üńö▒Ķ«Łń╗āµĀʵ£¼ķøåńö¤µłÉÕå│ńŁ¢µĀæńÜäĶ┐ćń©ŗŃĆéõĖĆĶł¼µāģÕåĄõĖŗ’╝īĶ«Łń╗āµĀʵ£¼...

ID3ŃĆüC4.5ÕÆīCARTµś»ÕĖĖĶ¦üńÜäÕå│ńŁ¢µĀæń«Śµ│ĢŃĆé 2. µ£┤ń┤ĀĶ┤ØÕÅȵ¢»’╝łNaive Bayes’╝ē’╝ÜÕ¤║õ║ÄĶ┤ØÕÅȵ¢»Õ«ÜńÉåńÜäÕłåń▒╗µ¢╣µ│ĢŃĆéÕ░Įń«ĪŌĆ£µ£┤ń┤ĀŌĆصäÅÕæ│ńØĆÕüćĶ«ŠÕÉäńē╣ÕŠüõ╣ŗķŚ┤ńøĖõ║Æńŗ¼ń½ŗ’╝īõĮåĶ┐ÖÕ£©Õ«×ķÖģÕ║öńö©õĖŁÕŠĆÕŠĆÕŠłµ£ēµĢłŃĆéÕ£©IrisµĢ░µŹ«ķøåõĖŖ’╝īµ£┤ń┤ĀĶ┤ØÕÅȵ¢»ń«Śµ│Ģõ╝ÜĶ«Īń«Ś...

- `ID3` ń▒╗’╝ÜÕīģÕɽµ×äķĆĀÕå│ńŁ¢µĀæńÜäõĖ╗Ķ”üķĆ╗ĶŠæ’╝īÕ”é`calcEntropy()`’╝łĶ«Īń«ŚńåĄ’╝ēŃĆü`calcGain()`’╝łĶ«Īń«Śõ┐Īµü»Õó×ńøŖ’╝ēÕÆī`buildTree()`’╝łµ×äÕ╗║Õå│ńŁ¢µĀæ’╝ēńŁēµ¢╣µ│ĢŃĆé **4. Õ║öńö©Õ£║µÖ»** ID3ń«Śµ│ĢÕøĀÕģČń«ĆÕŹĢµśōµćéŃĆüµśōõ║ÄÕ«×ńÄ░ĶĆīĶó½Õ╣┐µ│øÕ║öńö©õ║ÄÕÉäõĖ¬...

2. Õå│ńŁ¢µĀæµ×äķĆĀ’╝ܵĀ╣µŹ«ĶŠōÕģźµĢ░µŹ«’╝īµ×äķĆĀÕå│ńŁ¢µĀæŃĆé 3. ĶŖéńé╣ķĆēµŗ®’╝ÜķĆēµŗ®ĶŖéńé╣’╝īÕīģµŗ¼µĀ╣ĶŖéńé╣ÕÆīÕÅČĶŖéńé╣ŃĆé 4. Õłåń▒╗µł¢Õø×ÕĮÆ’╝ܵĀ╣µŹ«Õå│ńŁ¢µĀæ’╝īĶ┐øĶĪīÕłåń▒╗µł¢Õø×ÕĮƵōŹõĮ£ŃĆé Õå│ńŁ¢µĀæńÜäõ╝śńé╣ Õå│ńŁ¢µĀæµ£ēÕŠłÕżÜõ╝śńé╣’╝Ü 1. ÕÅ»Ķ¦ŻķćŖµĆ¦Õ╝║’╝ÜÕå│ńŁ¢µĀæÕÅ»õ╗źµÅÉõŠø...