负载均衡系统可以选用LVS方案,而为避免Director Server单点故障引起系统崩溃,我们可以选用LVS+Keepalived组合保证高可用性。

重点:每个节点时间都同步哈!

- [root@DR2 ~]# ntpdate time.windows.com && hwclock -w

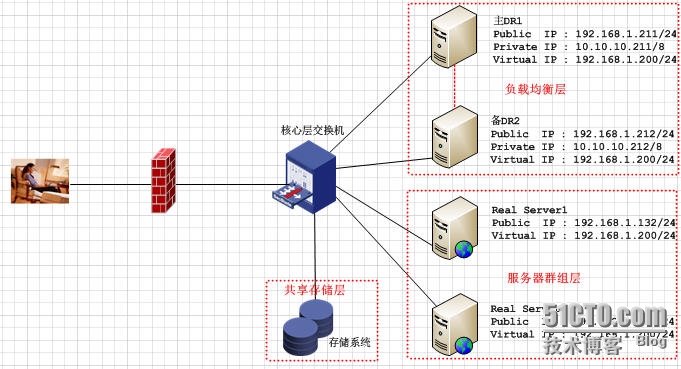

1、环境简介:

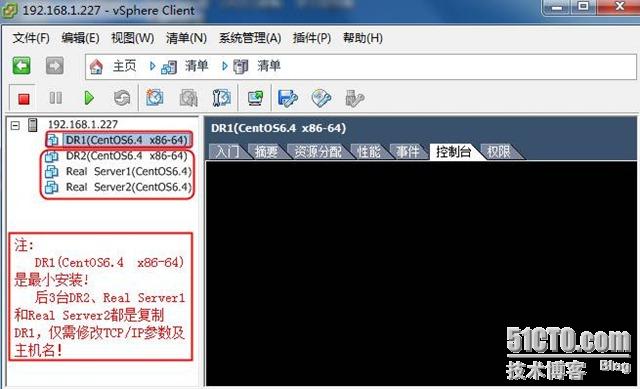

1)虚拟机:VMware ESXi 5.5 (CentOS 6.4 x86-64安装在其中)

2)操作系统: CentOS 6.4 x86-64

3)Keepalived版本: Keepalived-1.2.9

4)IPVS管理工具IPVSadm-1.26

5) Linux/Unix工具Xmanager 4.0 (Xshell)

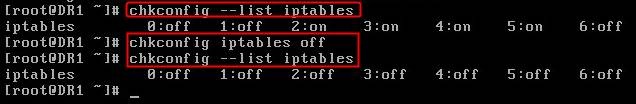

2、禁掉防火墙和Selinux

(1) 禁掉防火墙

(2) 禁掉Selinux

- vim /etc/selinux/config

(3) 最后,必须重新启动系统

- shutdown -r now

重点: DR2、Real Server1和Real Server2如下图所述完成!

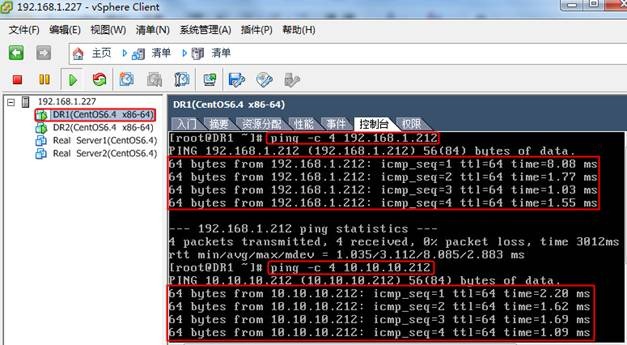

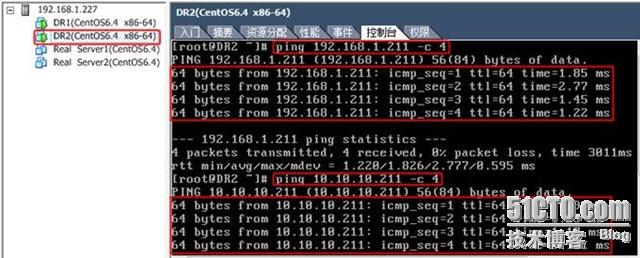

3、检查DR1与DR2的连通性:

//在DR1上分别ping DR2的public IP和private IP,如下图所示:

//在DR2上分别ping DR1的public IP和private IP,如下图所示:

一、理论篇:

1. LVS简介:

LVS是Linux Virtual Server的简写,意即Linux虚拟服务器,是一个虚拟的服务器集群系统。本项目在1998年5月由章文嵩博士成立,是中国国内最早出现的自由软件项目之一。章文嵩博士目前工作于阿里集团,主要从事集群技术、操作系统、对象存储与数据库的研究。(摘自《BAIDU百科》)

2. LVS集群的组成:

LVS服务器系统由三部分组成:

1)负载均衡层:

位于整个集群系统的最前端,避免单点故障一般最少由2台或2台以上负载调度器组成。

2)服务器群组层:

是一组真正运行应用服务器的机器组成,Real Server可以是Web、FTP、DNS、Mail 、视频等服务器中的一个或N个,每个Real Server之间通过高速的LAN/WAN相连接。为了节省宝贵的资源,在生产环境中,Director Server同时身兼Real Server的角色!

3)共享存储层:

为Real Server提供共享存储空间和内容一致性的存储区域。可以为磁盘阵列、Red Hat的GFS文件系统、Oracle的OCFS2文件系统等。

Director Server是整个LVS的核心!到目前为止,Director server只能安装在Linux、FreeBSD上,如果Linux内核是2.6及以上时,则已经内置了LVS的各个模块,不用作任何的设置就支持LVS功能。

Real Server服务器几乎为所有有系统平台,如:Windows、Linux、Solaris、AIX、BSD等系统平台。

3. LVS集群的特点:

(1) IP负载均衡和负载调度算法;

(2) 高可用性;

(3) 高可靠性;

(4) 适用环境;

(5) 开源软件。

4. LVS集群系统的优缺点:

LVS集群系统的优点:

(1) 抗负载能力强

工作在第4层仅作分发之用,没有流量的产生,这个特点也决定了它在负载均衡软件里的性能最强的;无流量,同时保证了均衡器I/O的性能不会受到大流量的影响;

(2) 工作稳定

自身有完整的双机热备方案,如LVS+Keepalived和LVS+Heartbeat;

(3) 应用范围比较广

可以对所有应用做负载均衡;

(4) 配置性比较低

既是优点,也是缺点,因为没有太多配置,所以并不需要太多接触,大大减少了人为出错的几率;

LVS集群系统的缺点:

(1) 软件本身不支持正则处理,不能做动静分离,这就凸显了Nginx/HAProxy+Keepalived的优势。

(2) 如果网站应用比较庞大,LVS/DR+Keepalived就比较复杂了,特别是后面有Windows Server应用的机器,

实施及配置还有维护过程就比较麻烦,相对而言,Nginx/HAProxy+Keepalived就简单多了。

集群根据业务目标而分为以下几种:

(1) High Availability (高可用): 目的是保持业务的持续性。

(2) Load Balancing(负载均衡): 将请求一个个分担到不同一计算机上去,每台计算机独立完成一个用户的请求的。

(3) High Performance (高性能): 需要一组计算机共同完成一件事情。

5. 实现集群产品:

*HA

(1)RHCS: 企业内用得比较多

(2)heartbeat:

(3)keepalived:

(*)黄金组合: LVS + Keepalived (重点)

*LB(负载均衡)

(1)HAProxy;

(2)LVS;

(3)Nginx;

(4)硬件F5;

(5)Piranha :红帽光盘自带的,但在Linux 6.0中又去掉了

*HPC

6. LVS负载均衡技术:

(1)LVS-DR模式(Direct routing):直接路由模式。用得最多!可以跟100个以上Real Server

(2)LVS-NAT模式(Network Address Translaton): 只能跟3~5个Real Server;

(3)LVS-TUN模式(IP Tunneling): 应用于远程,尤其是外网等

7. LVS-NAT特性:

(1)Real Server必须与Director在同一网络,仅用于与Director服务器通讯;

(2)Director接收所有的数据包通讯(包括客户端与Director、Director和real server直接的通讯);

(3)Real Server的默认网关指向Director的真实IP地址;

(4)Director支持端口映射,可以将客户端的请求映射到Real Server的另一个端口;(与DR模式的区别)

(5)支持任意操作系统; 如:Windows、Linux、FreeBSD、AIX等

(6)单一的Director是整个集群的瓶颈(故一般都是2台或2台以上的Director机器)

8. LVS负载均衡的调度算法(静态)

(1)轮循调度(Round Robin)(rr)(最笨的调度算法)

调度器通过“轮循”调度算法将外部请求按顺序轮流分配到集群中的Real Server上,均等每一台Server,而不管Server上实际的连接和系统负载。

(2)加权轮循(Weighted Round Robin)(wrr)

调度器通过”加权轮循”调度算法根据真实服务器的不同处理能力来调访问请求。如此保证处理能力强的服务器能处理更多的访问流量。调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

(3)目标地址散列(Destination Hashing)(DH)(有缓存,目标不变,则不变)

它的调度算法根据请求的目标IP地址,作为散列(Hash Key)从静态分配的散列表找出对应的服务器,若该服务器是可用的且未超载,则将请求发送到该服务器,否则返回空。

(4)源地址散列(Source Hashing)(SH) (有缓存,源不变,则不变)

是根据请求的源IP地址,作为散列键(Hash key)从静态分配的散列表找出对应的服务器,若该 服务器是可用的且未超载,将请求发送到该服务器,否则返回空。

9. LVS负载均衡的调度算法(动态)

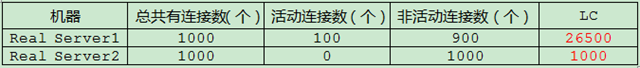

(5)最少链接(Least Connections)(LC)

调度器通过”最少连接”调度算法动态地将网络请求调度到已建立的链接数最少的服务器上。若集群系统的真实服务器具有相近的系统性能,采用“最少连接”调度算法可以较好地均衡负载。

公式:LC = 活动连接数*256 + 非活动连接数

例如:

(6)加权最少链接(Weighted Least Connections)(WLC) 注:目前最优秀的调度算法!

适应:在集群系统中的服务器性能差异较大的情况下,调度器采用”加权最少链接”调算法优化负载均衡性能。具有较高权值的服务器将承受较大比例的活动连接负载。调度器可以自动问询真实服务器的负载情况,并动态地调整其权值。

例如:在上表加入Real Server1权值 为3,Real Server2权值为1时,则

公式:WLC = (活动连接数*256 + 非活动连接数)/权重

(7)最短的期望的延时(Shortest Expected Delay)(SED)

sed只是在WLC上做了些微调而已。只计算活动连接数!

公式:LC = (活动连接数+1)*256 ÷权重

(8)最少队列调度(Never Queue Scheduling)(NQS)

无需队列。若Real Server的连接数=0,就直接分配过去,不需要再进行sed运算。只计算活动连接数!

(9)基于局部性的最少连接(Locality-Based Least Connections)(LBLC)

它的调度算法针对目标IP地址的负载均衡,目前主要用于Cache集群系统。该算法根据请求的目标IP地址找出该目标IP地址最近使用的服务器,若该服务器是可用的且没有超载,将请求发送到该服务器;若服务器不存在,或者该服务器超载且有服务器处于一半的工作负载,则用“最少连接”的原则选出一个可用的服务器,将请求发送到该服务器。(HD动态算法)

(10)带复制的基于局部最少链接(Locality-Based Leat Connections Witch Replication)(LBLCR)

此调算法也是针对目标IP地址的负载均衡,目前主要用于Cache集群系统。它与LBLC算法的不同之处是它要维护从一个目标IP地址到一组服务器的映射,而LBLC算法维护从一个目标IP地址到一台服务器的映射。该算法根据请求的目标IP地址找出该目标IP地址对应的服务器组,按“最小连接”原则从服务器组中选出一台服务器,若服务器没有超载,将请求发送到该服务器,若服务器超载,则按“按最少连接”原则从这个集群中选出一台服务器,将该服务器加入到服务器组中,将请求发送到该服务器。同时,当该服务器组有一段时间没有被修改,将最忙的服务器从服务器组中删除,以降低复制的程度。

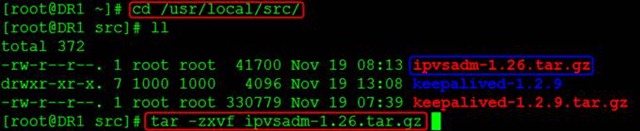

二、实战篇:

1. 安装LVS软件:(分别在DR1和DR2中)

LVS软件包括二部分:

① IPVS模块,LVS已经是Linux标准内核的一部分,直接被编译在内核中!

② IPVS管理工具IPVSadm ,如:IPVSadm-1.26

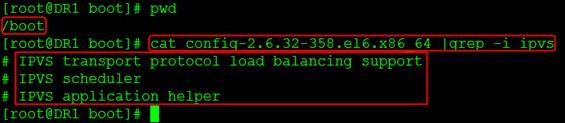

1)检查是否安装了IPVS模块: 注:LVS已经是Linux标准内核的一部分,直接被编译在内核中!

方法1: 查看IPVS模块是否真的编译到内核中去了,如下图所示:

由上可知,有3个项,说明这个功能已经编译到内核中了!

方法2: 使用modprobe命令查看,如下图所示:

由上可知,明显安装了支持LVS的IPVS模块!

2)在DR1上安装IPVS管理软件:

方法1:源码安装

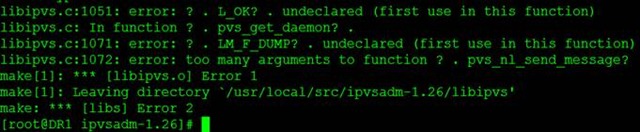

- [root@DR1 src]# cd ipvsadm-1.26

- [root@DR1 ipvsadm-1.26]# make

//make时,出现如下所示:

解决方法:

安装以下4个包: (rpm –ivh 软件包名)

(1) popt-1.13-7.el6.x86_64.rpm

(2) libnl-1.1-14.el6.x86_64.rpm

(3) libnl-devel-1.1-14.el6.x86_64.rpm

(4)popt-static-1.13-7.el6.x86_64.rpm

重点:

安装以上4个包后,安装成功,如下图所示:

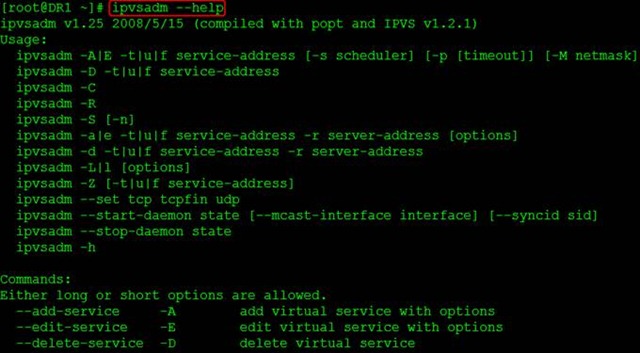

方法2: yum安装

- yum -y install ipvsadm

//检查ipvsadm安装是否成功:

如果显示了ipvsadm的各种用法,则说明ipvsadm安装成功了!

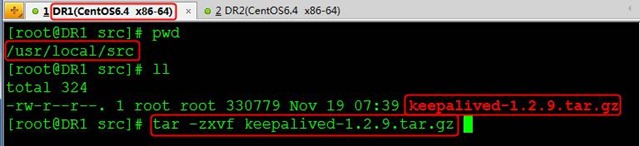

2. 安装Keepalived (分别在DR1和DR2中)

- [root@DR1 src]# cd keepalived-1.2.9

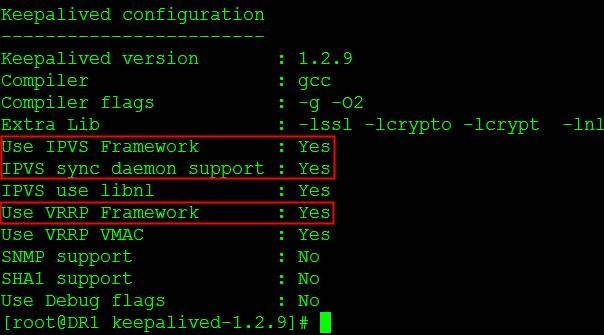

- [root@DR1 keepalived-1.2.9]# ./configure --sysconf=/etc\

- > --with-kernel-dir=/usr/src/kernels/2.6.32-358.el6.x86_64/

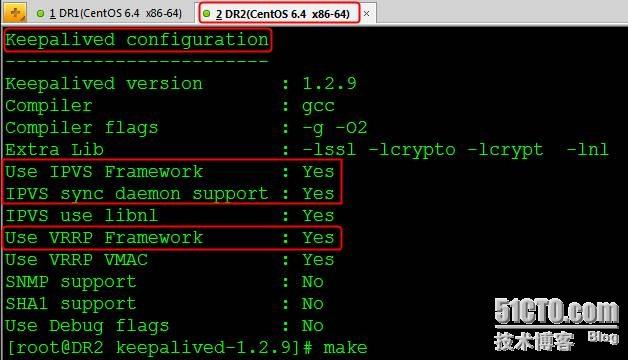

重点: 确保下面3行是 yes !如下图所示:

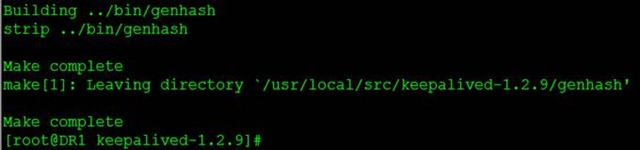

//编译之

- [root@DR1 keepalived-1.2.9]# make

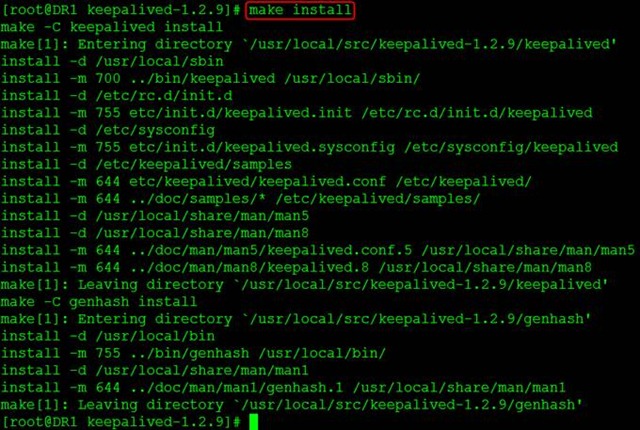

//安装

//做个软链接

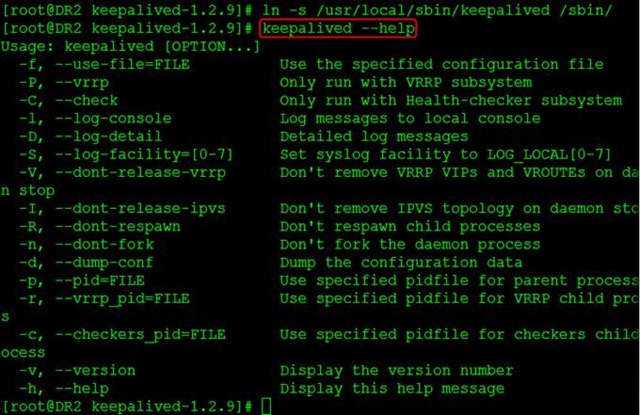

- [root@DR1 keepalived-1.2.9]# ln -s /usr/local/sbin/keepalived /sbin/

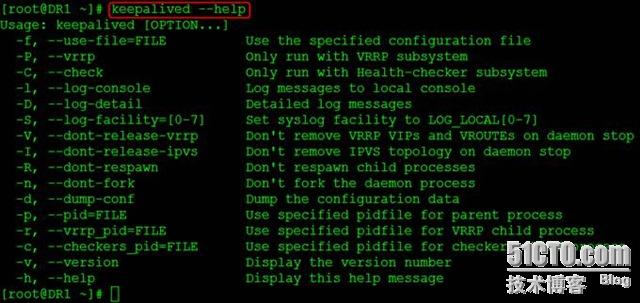

//检验安装是否成功:

如果显示了Keepalived的各种用法,则说明Keepalived安装成功了!

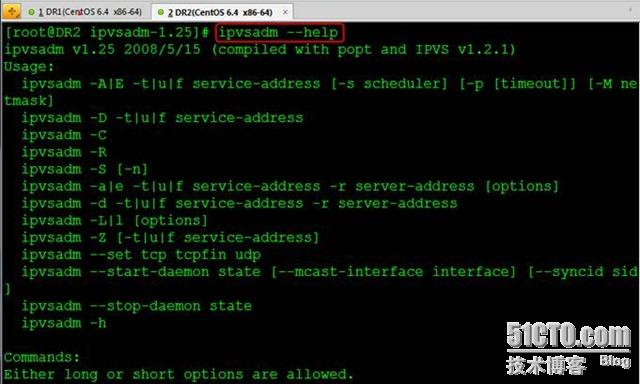

//同理DR2中安装keepalived,现在检查安装是否成功:

3. 配置keepalived

(1)在DR1上配置keepalived:

最简单的方法:先在记事本中,手工创建之。复制到/etc/keepalived/keepalived.conf中,保存即可!

//手工创建keepalived.conf文件(vim /etc/keepalived/keepalived.conf)

- ! Configuration File for keepalived

- global_defs {

- notification_email {

- acassen@firewall.loc #设置报警邮件地址,可以设置多个,每行1个,

- failover@firewall.loc #需开启邮件报警及本机的Sendmail服务。

- sysadmin@firewall.loc

- }

- notification_email_from Alexandre.Cassen@firewall.loc

- smtp_server 192.168.200.1 #设置SMTP Server地址;

- smtp_connect_timeout 30

- router_id LVS_DEVEL

- }

- ########VRRP Instance########

- vrrp_instance VI_1 {

- state MASTER #指定Keepalived的角色,MASTER为主机服务器,BACKUP为备用服务器

- interface eth0 #BACKUP为备用服务器

- virtual_router_id 51

- priority 100 #定义优先级,数字越大,优先级越高,主DR必须大于备用DR。

- advert_int 1

- authentication {

- auth_type PASS #设置验证类型,主要有PASS和AH两种

- auth_pass 1111 #设置验证密码

- }

- virtual_ipaddress {

- 192.168.1.200 #设置主DR的虚拟IP地址(virtual IP),可多设,但必须每行1个

- }

- }

- ########Virtual Server########

- virtual_server 192.168.1.200 80 { #注意IP地址与端口号之间用空格隔开

- delay_loop 6 #设置健康检查时间,单位是秒

- lb_algo rr #设置负载调度算法,默认为rr,即轮询算法,最优秀是wlc算法

- lb_kind DR #设置LVS实现LB机制,有NAT、TUNN和DR三个模式可选

- nat_mask 255.255.255.0

- persistence_timeout 50 #会话保持时间,单位为秒

- protocol TCP #指定转发协议类型,有TCP和UDP两种

- real_server 192.168.1.132 80 {

- weight 1 #配置节点权值,数字越大权值越高

- TCP_CHECK {

- connect_timeout 3 #表示3秒无响应,则超时

- nb_get_retry 3 #表示重试次数

- delay_before_retry 3 #表示重试间隔

- }

- }

- real_server 192.168.1.133 80 { #配置服务器节点,即Real Server2的public IP

- weight 3 #配置节点权值,数字越大权值越高

- TCP_CHECK {

- connect_timeout 3 #表示3秒无响应,则超时

- nb_get_retry 3 #表示重试次数

- delay_before_retry 3 #表示重试间隔

- }

- }

- }

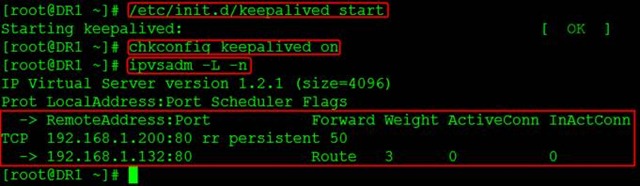

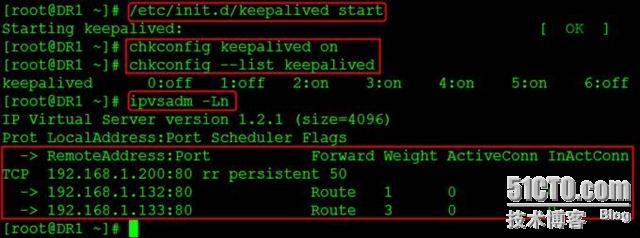

//启动哈keepalived、设置keepalived服务自动启动、检查是否生效,如下图所示:

(2)在DR2上配置keepalived:

先将上面记事本中的keepalived.conf配置文件,仅仅修改2处,如下图所示:

No.1处:把“stateMASTER”修改为“stateBACKUP” #即备用服务器;

No.2处:把“priority 100”修改为“priority 90” #优先级为90。

修改好后,复制到DR2的/etc/keepalived/keepalived.conf中,保存即可!

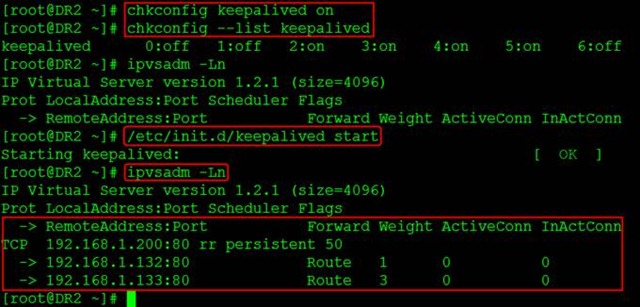

//启动哈keepalived、设置keepalived服务自动启动、检查是否生效,如下图所示:

4. 配置Real Server节点:

1)yum –y install httpd

2)启动httpd服务时,出错:

//vim /etc/httpd/conf/httpd.conf中,依如下操作:

#265 ServerName www.example.com:80 //去掉前面的#号即可!

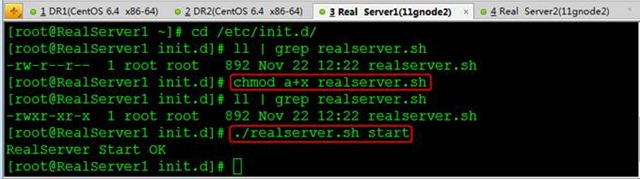

3)在RealServer1和RealServer2上的脚本realserver.sh:

- #add for chkconfig

- #chkconfig: 2345 70 30 #234都是文本界面,5就是图形界面X,70启动顺序号,30系统关闭,脚本

- #止顺序号

- #description: RealServer's script #关于脚本的简短描述

- #processname: realserver.sh #第一个进程名,后边设置自动时会用到

- #!/bin/bash

- VIP=192.168.1.200

- source /etc/rc.d/init.d/functions

- case "$1" in

- start)

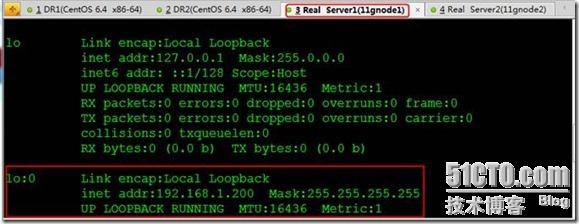

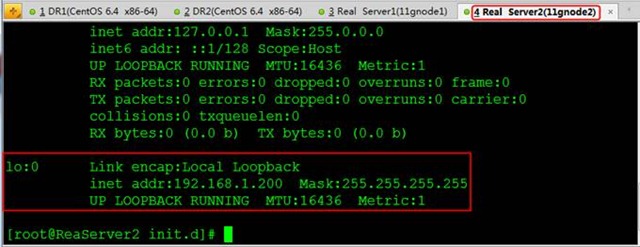

- ifconfig lo:0 $VIP netmask 255.255.255.255 broadcast $VIP

- /sbin/route add -host $VIP dev lo:0

- echo "1" >/proc/sys/net/ipv4/conf/lo/arp_ignore

- echo "2" >/proc/sys/net/ipv4/conf/lo/arp_announce

- echo "1" >/proc/sys/net/ipv4/conf/all/arp_ignore

- echo "2" >/proc/sys/net/ipv4/conf/all/arp_announce

- echo "RealServer Start OK"

- ;;

- stop)

- ifconfig lo:0 down

- route del $VIP >/dev/null 2>&1

- echo "0" >/proc/sys/net/ipv4/conf/lo/arp_ignore

- echo "0" >/proc/sys/net/ipv4/conf/lo/arp_announce

- echo "0" >/proc/sys/net/ipv4/conf/all/arp_ignore

- echo "0" >/proc/sys/net/ipv4/conf/all/arp_announce

- echo "RealServer Stoped"

- ;;

- *)

- echo "Usage: $0 {start|stop}"

- exit 1

- esac

- exit 0

//为realserver.sh添加权限

5. 启动keepalived + LVS集群系统:

6. 测试分为三个部分:

1)高可用性功能测试:

高可用性是通过LVS的两个DR1和DR2完成的。为了模拟故障,先将DR1上的Keepalived服务停止或者干脆关掉节点DR1,然后观察备用DR2上Keepalived是否获得虚拟IP地址,即VIP 192.168.1.200

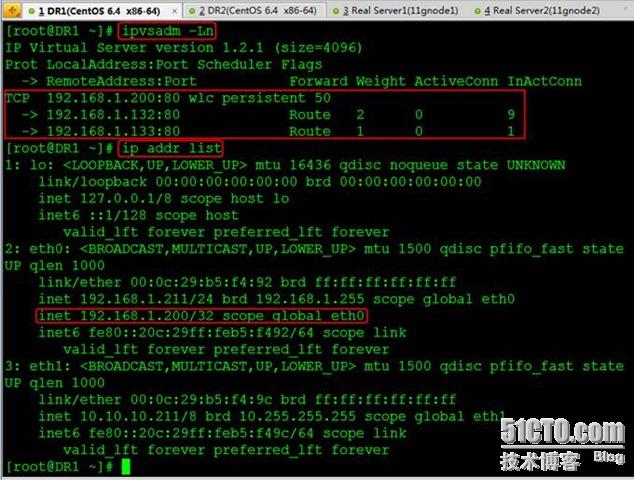

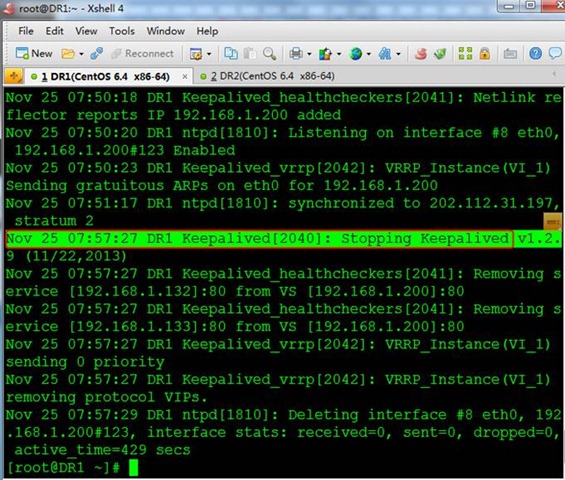

//在DR1查看哈,信息如下图所示:

由上可知,虚拟IP地址在DR1节点上,即VIP 192.168.1.200

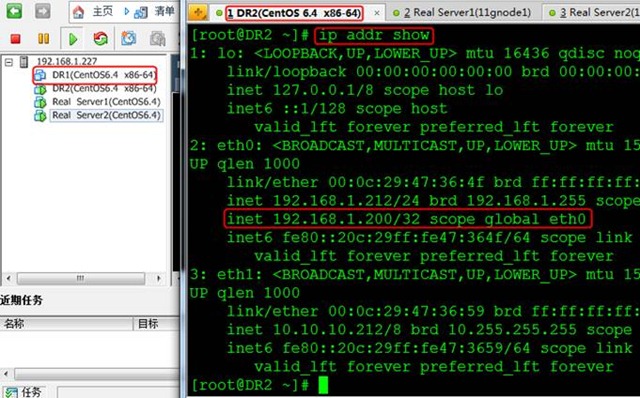

//在DR2查看哈,信息如下图所示:

【思考】自己查查看,一定会成功!

方法1:命令检验法

使用命令ipvsadm –Ln和ip addr list/show查看虚拟IP漂移情况来判断。

//关闭DR1,模拟宕机,如下图所示:

由上图可知,DR1确实宕机了,而DR2得到了虚拟IP地址(上图红框中的192.168.1.200)

且访问依然正常,再次证明了高可用性,如下图所示:

方法2:查看日志法

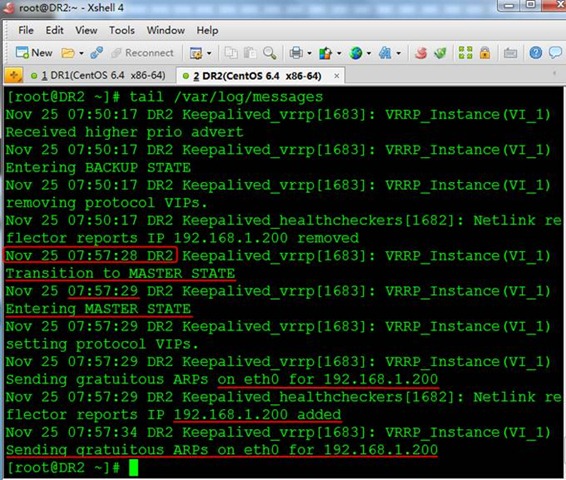

//关闭DR1/停止DR1的keepalived服务,模拟宕机,在DR2中查看日志,如下图日志所示:

//再查看DR2是否立刻检测到DR1出现故障,确实非常快就检测到DR1的故障,并马上接管主机的虚拟IP地址(192.168.1.200),注意观察上图和下图!

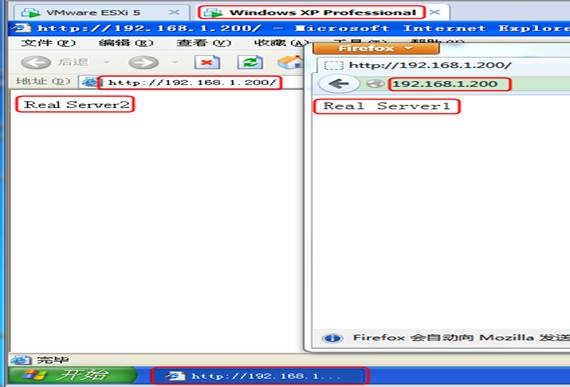

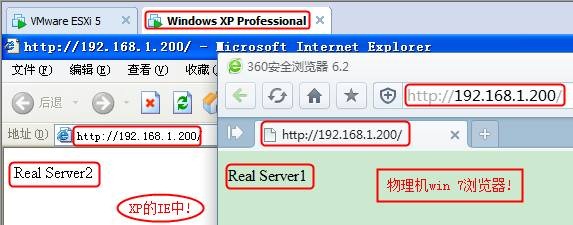

2)负载均衡测试:

为了便于测试,我们在Real Server1和Real Server2分别配置www服务的网页且内容也好识别,如下图所示:

方法1:客户端浏览器中测试

由上可知,我们在VMWare中的XP操作系统和物理机器win 7的浏览器中分别输入http://192.168.1.200且不断地刷新之都可访问!

方法2:用压力测试法

- [root@CentOS6 ~]# ab –c 100 –n 10000 http://192.168.1.200/index.html

3)故障切换测试

故障切换是测试在某个节点出现故障后,keepalived监控模块能否及时发现,然后屏蔽故障节点,同时将服务转移到正常节点上执行之。

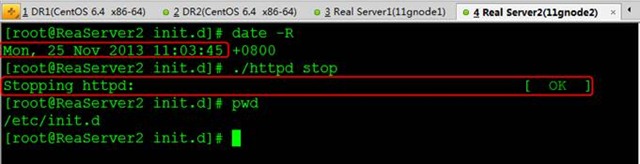

停掉节点Real Server2服务,模拟该节点出现故障,然后查查看主、备机器日志信息:

方法1:查看主、备机器日志信息

//先停掉节点Real Server2的httpd服务,如下图所示:

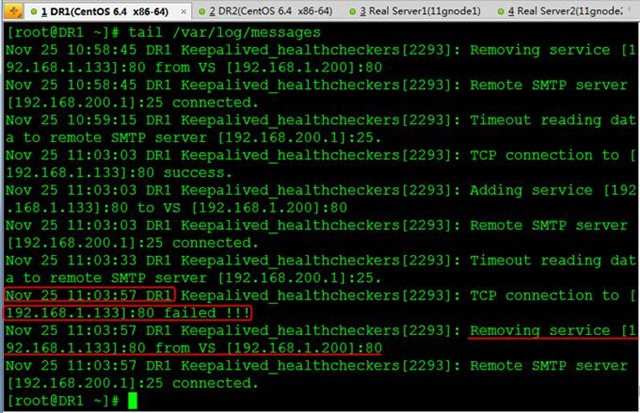

//再查看DR1上的日志,如下图所示:

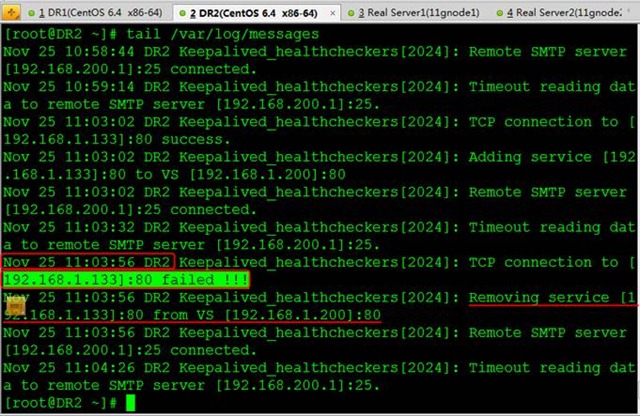

//再查看DR2上的日志,如下图所示:

由上可知,故障切换测试成功!

方法2:客户端浏览器中测试

不断刷新网页一直就显示如上图所示:Real Server1内容!可见故障切换成功!

相关推荐

随着你的网站业务量的增长你网站的服务器压力越来越大?需要负载均衡方案!商业的硬件如F5又太贵,你们又是创业型互联公司...我们利用LVS+Keepalived基于完整开源软件的架构可以为你提供一个负载均衡及高可用的服务器。

lvs+Keepalived+nginx高可用负载均衡搭建部署方案

本篇文章详细记录了Mysql双主热备+LVS+Keepalived高可用操作过程,可作为线上长期的实操手册.特此分享,希望能帮助到有用到的朋友.

本篇文档为Mysql双主热备+LVS+Keepalived高可用操作记录,可作为线上实操手册,有需要的朋友可以拿走,希望能帮助到有用到的人~

Lvs+keepalived 高可用性负载均衡配置 本文介绍了使用 LVS(Linux Virtual Server)和 Keepalived 实现高可用性负载均衡的配置。LVS 是一种开源的负载均衡解决方案,可以将入站流量分配到多个后端服务器上,以提高...

在构建大型、高可用性的FTP(File ...通过上述步骤,我们可以构建一个基于lvs+keepalived+vsftp的FTP服务器负载均衡环境,提供高可用性和良好的扩展性。记住,实施过程中应根据实际需求和服务器环境进行适当的调整。

HAProxy+Keepalived+LVS实现负载平衡高可用集群最佳实践

LVS+Keepalived+Nginx+Tomcat 高可用集群项目 本文主要讲述了如何构建一个高可用集群项目,使用 LVS、Keepalived、Nginx 和 Tomcat 实现高可用性和负载均衡。该项目的架构中,Keepalived 负责对 LVS 架构中的调度器...

搭建LVS+KEEPALIVED负载均衡需要安装ipvsadm和Keepalived软件,配置Keepalived的配置文件,并部署Master-lvs和Backup-lvs服务器。同时,LVS和KEEPALIVED可以实现高可用性和高性能,且可以灵活地配置Real Server和...

### LVS+Keepalived 实现高性能高可用负载均衡服务器 #### 一、LVS与Keepalived简介 ##### LVS LVS全称为Linux Virtual Server,即Linux虚拟服务器,是一个开源项目,由章文嵩博士于1998年创立。它是一个基于Linux...

通过LVS+Keepalived搭建高可用的负载均衡集群系统

MySQL 双主复制 + LVS + Keepalived 是一种常见的 MySQL 负载均衡解决方案,通过使用双主复制确保数据的一致性,使用 LVS 实现负载均衡,使用 Keepalived 实现高可用性。本文将详细介绍该解决方案的实现步骤和原理。...

LVS+Keepalived 是一种高性能高可用的负载均衡解决方案,可以满足不同业务场景的需求。通过本文档,我们了解了 LVS 和 Keepalived 的基本原理和安装配置过程。我们也了解了如何使用 LVS+Keepalived 实现网站负载均衡...

"LVS+KeepAlived+Nginx高可用实现方案" LVS(Linux Virtual Server)是一种虚拟服务器集群系统,旨在提供高性能、高可用的服务器解决方案。其主要特点包括可伸缩性、可靠性和可管理性。LVS通过IP负载均衡技术实现...

#### LVS+Keepalived 高可用负载均衡系统 - **LVS(Linux Virtual Server)** - LVS 是一种基于Linux的高性能负载均衡解决方案。 - 它通过IP负载均衡技术和基于内容请求分发技术,将访问请求均匀地分配到多个...

综上所述,LVS+keepalived负载均衡系统是构建高可用、高性能服务的关键技术之一,其强大的功能和灵活的配置使得它在各类规模的网络环境中都有广泛的应用。通过深入理解和熟练掌握这些知识点,可以有效地提升系统稳定...

linux集群应用实战 通过LVS+Keepalived搭建高可用的负载均衡集群系统 第二讲

【LVS+Keepalived+MySQL半同步主主复制高可用方案】 1. 方案概述 LVS(Linux Virtual Server)结合Keepalived构建的高可用解决方案,通常用于实现负载均衡和故障转移,以提高系统的整体可用性。在这个方案中,MySQL...