жЬђжЦЗиљђиЗ™:https://my.oschina.net/itblog/blog/547250/

ELKеє≥еП∞дїЛзїН

еЬ®жРЬ糥ELKиµДжЦЩзЪДжЧґеАЩпЉМеПСзО∞ињЩзѓЗжЦЗзЂ†жѓФиЊГе•љпЉМдЇОжШѓжСШжКДдЄАе∞ПжЃµпЉЪ

дї•дЄЛеЖЕеЃєжЭ•иЗ™пЉЪhttp://baidu.blog.51cto.com/71938/1676798

жЧ•ењЧдЄїи¶БеМЕжЛђз≥їзїЯжЧ•ењЧгАБеЇФзФ®з®ЛеЇПжЧ•ењЧеТМеЃЙеЕ®жЧ•ењЧгАВз≥їзїЯињРзїіеТМеЉАеПСдЇЇеСШеПѓдї•йАЪињЗжЧ•ењЧдЇЖиІ£жЬНеК°еЩ®иљѓз°ђдїґдњ°жБѓгАБж£АжЯ•йЕНзљЃињЗз®ЛдЄ≠зЪДйФЩиѓѓеПКйФЩиѓѓеПСзФЯзЪДеОЯеЫ†гАВзїПеЄЄеИЖжЮРжЧ•ењЧеПѓдї•дЇЖиІ£жЬНеК°еЩ®зЪДиіЯиНЈпЉМжАІиГљеЃЙеЕ®жАІпЉМдїОиАМеПКжЧґйЗЗеПЦжО™жЦљзЇ†ж≠£йФЩиѓѓгАВ

йАЪеЄЄпЉМжЧ•ењЧ襀еИЖжХ£зЪДеВ®е≠ШдЄНеРМзЪДиЃЊе§ЗдЄКгАВе¶ВжЮЬдљ†зЃ°зРЖжХ∞еНБдЄКзЩЊеП∞жЬНеК°еЩ®пЉМдљ†ињШеЬ®дљњзФ®дЊЭжђ°зЩїељХжѓПеП∞жЬЇеЩ®зЪДдЉ†зїЯжЦєж≥ХжЯ•йШЕжЧ•ењЧгАВињЩж†ЈжШѓдЄНжШѓжДЯиІЙеЊИзєБзРРеТМжХИзОЗдљОдЄЛгАВељУеК°дєЛжА•жИСдїђдљњзФ®йЫЖдЄ≠еМЦзЪДжЧ•ењЧзЃ°зРЖпЉМдЊЛе¶ВпЉЪеЉАжЇРзЪДsyslogпЉМе∞ЖжЙАжЬЙжЬНеК°еЩ®дЄКзЪДжЧ•ењЧжФґйЫЖж±ЗжАїгАВ

йЫЖдЄ≠еМЦзЃ°зРЖжЧ•ењЧеРОпЉМжЧ•ењЧзЪДзїЯиЃ°еТМж£А糥еПИжИРдЄЇдЄАдїґжѓФиЊГйЇїзГ¶зЪДдЇЛжГЕпЉМдЄАиИђжИСдїђдљњзФ®grepгАБawkеТМwcз≠ЙLinuxеСљдї§иГљеЃЮзО∞ж£А糥еТМзїЯиЃ°пЉМдљЖжШѓеѓєдЇОи¶Бж±ВжЫійЂШзЪДжߕ胥гАБжОТеЇПеТМзїЯиЃ°з≠Йи¶Бж±ВеТМеЇЮе§ІзЪДжЬЇеЩ®жХ∞йЗПдЊЭзДґдљњзФ®ињЩж†ЈзЪДжЦєж≥ХйЪЊеЕНжЬЙзВєеКЫдЄНдїОењГгАВ

еЉАжЇРеЃЮжЧґжЧ•ењЧеИЖжЮРELKеє≥еП∞иГље§ЯеЃМзЊОзЪДиІ£еЖ≥жИСдїђдЄКињ∞зЪДйЧЃйҐШпЉМELKзФ±ElasticSearchгАБLogstashеТМKiabanaдЄЙдЄ™еЉАжЇРеЈ•еЕЈзїДжИРгАВеЃШжЦєзљСзЂЩпЉЪhttps://www.elastic.co/products

-

ElasticsearchжШѓдЄ™еЉАжЇРеИЖеЄГеЉПжРЬ糥еЉХжУОпЉМеЃГзЪДзЙєзВєжЬЙпЉЪеИЖеЄГеЉПпЉМйЫґйЕНзљЃпЉМиЗ™еК®еПСзО∞пЉМ糥еЉХиЗ™еК®еИЖзЙЗпЉМ糥еЉХеЙѓжЬђжЬЇеИґпЉМrestfulй£Ож†ЉжО•еП£пЉМе§ЪжХ∞жНЃжЇРпЉМиЗ™еК®жРЬ糥иіЯиљљз≠ЙгАВ

-

LogstashжШѓдЄАдЄ™еЃМеЕ®еЉАжЇРзЪДеЈ•еЕЈпЉМдїЦеПѓдї•еѓєдљ†зЪДжЧ•ењЧињЫи°МжФґйЫЖгАБињЗжї§пЉМеєґе∞ЖеЕґе≠ШеВ®дЊЫдї•еРОдљњзФ®пЉИе¶ВпЉМжРЬ糥пЉЙгАВ

-

Kibana дєЯжШѓдЄАдЄ™еЉАжЇРеТМеЕНиієзЪДеЈ•еЕЈпЉМеЃГKibanaеПѓдї•дЄЇ Logstash еТМ ElasticSearch жПРдЊЫзЪДжЧ•ењЧеИЖжЮРеПЛе•љзЪД Web зХМйЭҐпЉМеПѓдї•еЄЃеК©жВ®ж±ЗжАїгАБеИЖжЮРеТМжРЬ糥йЗНи¶БжХ∞жНЃжЧ•ењЧгАВ

----------------------------жСШжКДеЖЕеЃєзїУжЭЯ-------------------------------

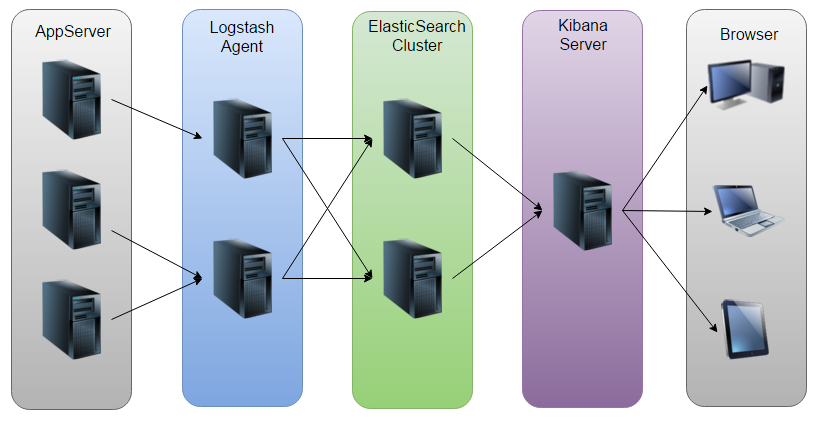

зФїдЇЖдЄАдЄ™ELKеЈ•дљЬзЪДеОЯзРЖеЫЊпЉЪ

е¶ВеЫЊпЉЪLogstashжФґйЫЖAppServerдЇІзФЯзЪДLogпЉМеєґе≠ШжФЊеИ∞ElasticSearchйЫЖзЊ§дЄ≠пЉМиАМKibanaеИЩдїОESйЫЖзЊ§дЄ≠жߕ胥жХ∞жНЃзФЯжИРеЫЊи°®пЉМеЖНињФеЫЮзїЩBrowserгАВ

ELKеє≥еП∞жР≠еїЇ

з≥їзїЯзОѓеҐГ

System: Centos release 6.7 (Final)

ElasticSearch: 2.1.0

Logstash: 2.1.1

Kibana: 4.3.0

Java: openjdk version  "1.8.0_65"

ж≥®пЉЪзФ±дЇОLogstashзЪДињРи°МдЊЭиµЦдЇОJavaзОѓеҐГпЉМ иАМLogstash 1.5дї•дЄКзЙИжЬђдЄНдљОдЇОjava 1.7пЉМеЫ†ж≠§жО®иНРдљњзФ®жЬАжЦ∞зЙИжЬђзЪДJavaгАВеЫ†дЄЇжИСдїђеП™йЬАи¶БJavaзЪДињРи°МзОѓеҐГпЉМжЙАдї•еПѓдї•еП™еЃЙи£ЕJREпЉМдЄНињЗињЩйЗМжИСдЊЭзДґдљњзФ®JDKпЉМиѓЈиЗ™и°МжРЬ糥еЃЙи£ЕгАВ

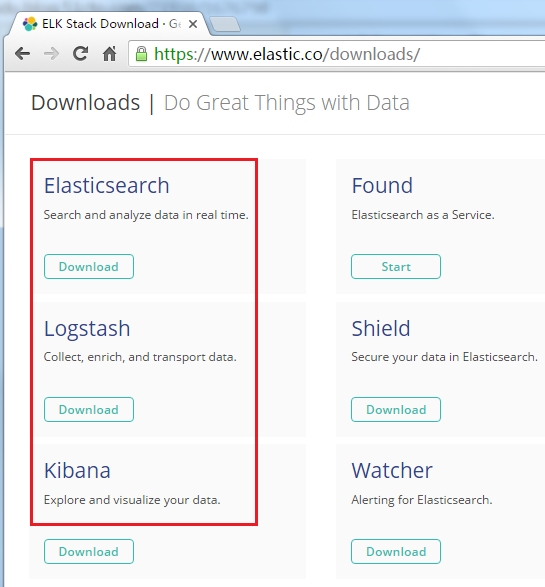

ELKдЄЛиљљпЉЪhttps://www.elastic.co/downloads/

ElasticSearch

йЕНзљЃElasticSearchпЉЪ

tar -zxvf elasticsearch-2.1.0.tar.gz

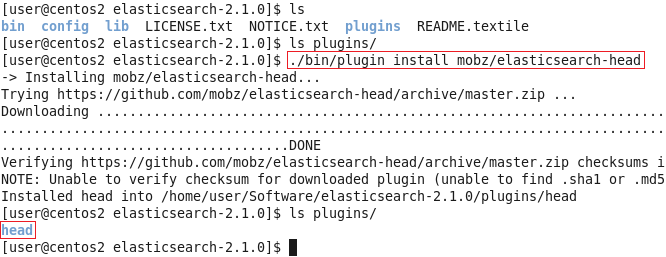

cd¬†elasticsearch-2.1.0еЃЙи£ЕHeadжПТдїґпЉИOptionalпЉЙпЉЪ

./bin/plugin install mobz/elasticsearch-head

зДґеРОзЉЦиЊСESзЪДйЕНзљЃжЦЗдїґпЉЪ

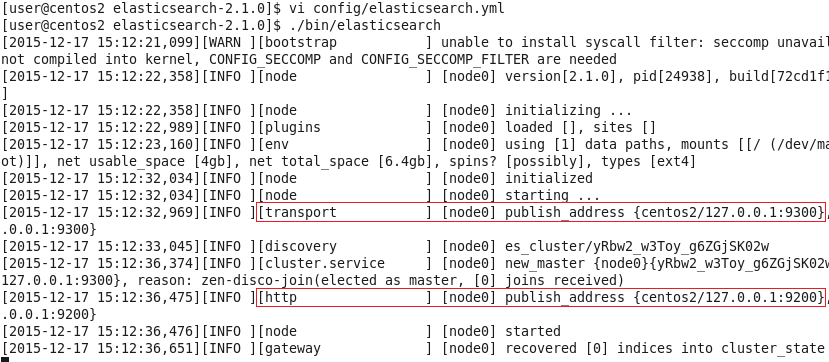

vi¬†config/elasticsearch.ymlдњЃжФєдї•дЄЛйЕНзљЃй°єпЉЪ

cluster.name=es_cluster

node.name=node0

path.data=/tmp/elasticsearch/data

path.logs=/tmp/elasticsearch/logs

#ељУеЙНhostnameжИЦIPпЉМжИСињЩйЗМжШѓcentos2

network.host=centos2

network.port=9200еЕґдїЦзЪДйАЙй°єдњЭжМБйїШиЃ§пЉМзДґеРОеРѓеК®ESпЉЪ

./bin/elasticsearch

еПѓдї•зЬЛеИ∞пЉМеЃГиЈЯеЕґдїЦзЪДиКВзВєзЪДдЉ†иЊУзЂѓеП£дЄЇ9300пЉМжО•еПЧHTTPиѓЈж±ВзЪДзЂѓеП£дЄЇ9200гАВ

дљњзФ®ctrl+CеБЬж≠ҐгАВељУзДґпЉМдєЯеПѓдї•дљњзФ®еРОеП∞ињЫз®ЛзЪДжЦєеЉПеРѓеК®ESпЉЪ

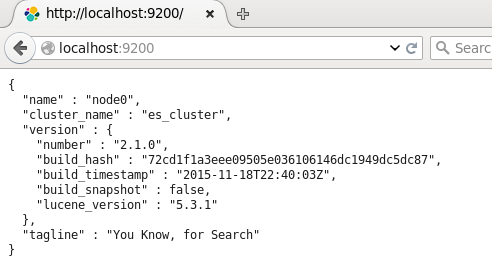

./bin/elasticsearch¬†&зДґеРОеПѓдї•жЙУеЉАй°µйЭҐlocalhost:9200пЉМе∞ЖдЉЪзЬЛеИ∞дї•дЄЛеЖЕеЃєпЉЪ

ињФеЫЮе±Хз§ЇдЇЖйЕНзљЃзЪДcluster_nameеТМnameпЉМдї•еПКеЃЙи£ЕзЪДESзЪДзЙИжЬђз≠Йдњ°жБѓгАВ

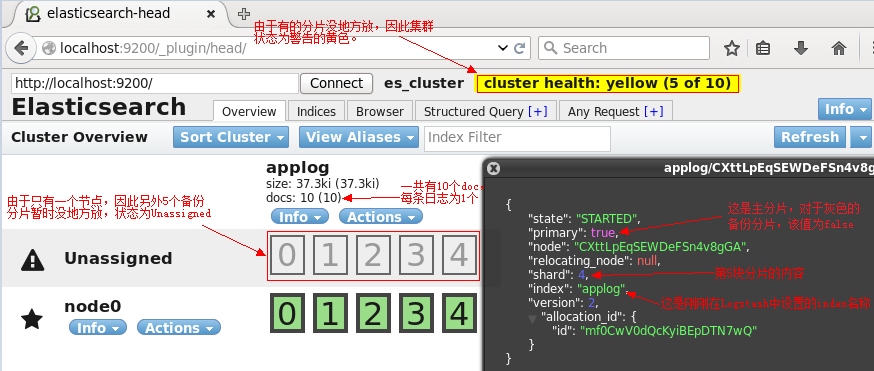

еИЪеИЪеЃЙи£ЕзЪДheadжПТдїґпЉМеЃГжШѓдЄАдЄ™зФ®жµПиІИеЩ®иЈЯESйЫЖзЊ§дЇ§дЇТзЪДжПТдїґпЉМеПѓдї•жЯ•зЬЛйЫЖзЊ§зКґжАБгАБйЫЖзЊ§зЪДdocеЖЕеЃєгАБжЙІи°МжРЬ糥еТМжЩЃйАЪзЪДRestиѓЈж±Вз≠ЙгАВзО∞еЬ®дєЯеПѓдї•дљњзФ®еЃГжЙУеЉАlocalhost:9200/_plugin/headй°µйЭҐжЭ•жЯ•зЬЛESйЫЖзЊ§зКґжАБпЉЪ

еПѓдї•зЬЛеИ∞пЉМзО∞еЬ®пЉМESйЫЖзЊ§дЄ≠ж≤°жЬЙindexпЉМдєЯж≤°жЬЙtypeпЉМеЫ†ж≠§ињЩдЄ§жЭ°жШѓз©ЇзЪДгАВ

Logstash

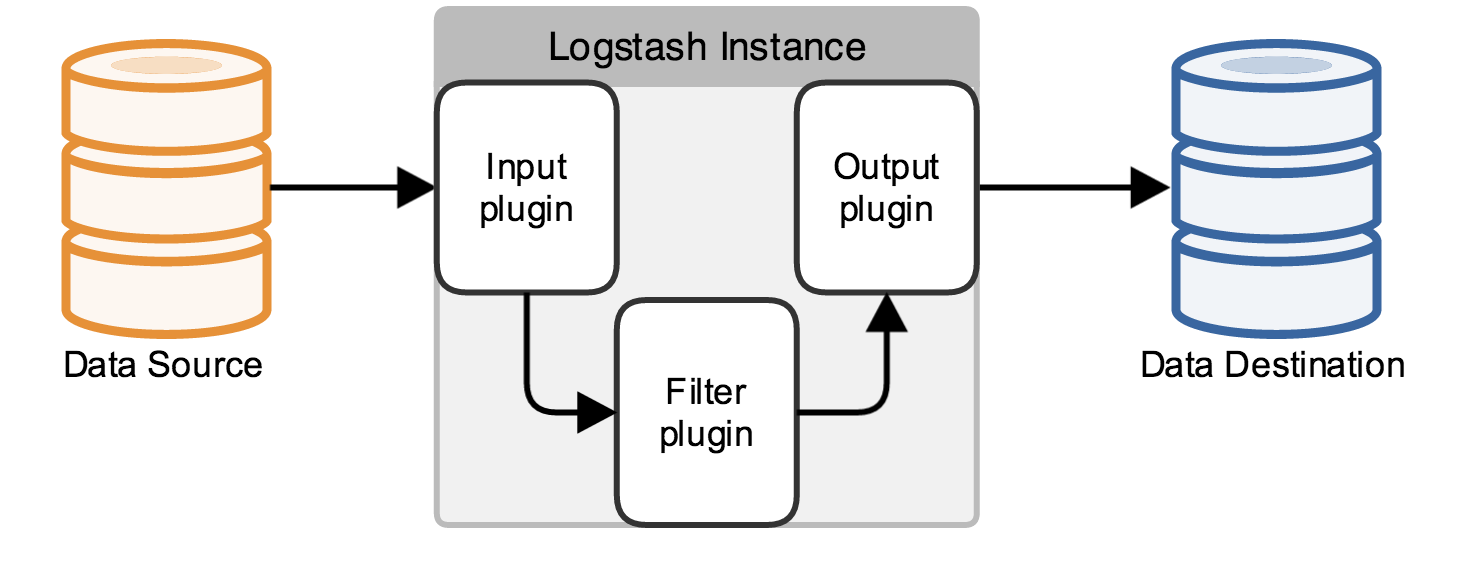

LogstashзЪДеКЯиГље¶ВдЄЛпЉЪ

еЕґеЃЮеЃГе∞±жШѓдЄАдЄ™жФґйЫЖеЩ®иАМеЈ≤пЉМжИСдїђйЬАи¶БдЄЇеЃГжМЗеЃЪInputеТМOutputпЉИељУзДґInputеТМOutputеПѓдї•дЄЇе§ЪдЄ™пЉЙгАВзФ±дЇОжИСдїђйЬАи¶БжККJavaдї£з†БдЄ≠Log4jзЪДжЧ•ењЧиЊУеЗЇеИ∞ElasticSearchдЄ≠пЉМеЫ†ж≠§ињЩйЗМзЪДInputе∞±жШѓLog4jпЉМиАМOutputе∞±жШѓElasticSearchгАВ

йЕНзљЃLogstashпЉЪ

tar -zxvf logstash-2.1.1.tar.gz

cd¬†logstash-2.1.1зЉЦеЖЩйЕНзљЃжЦЗдїґ(еРНе≠ЧеТМдљНзљЃеПѓдї•йЪПжДПпЉМињЩйЗМжИСжФЊеЬ®configзЫЃељХдЄЛпЉМеПЦеРНдЄЇlog4j_to_es.conf)пЉЪ

mkdir config

vi¬†config/log4j_to_es.confиЊУеЕ•дї•дЄЛеЖЕеЃєпЉЪ

# For detail structure of this file

# Set: https://www.elastic.co/guide/en/logstash/current/configuration-file-structure.html

input {

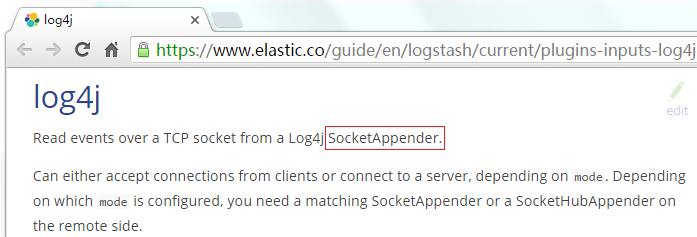

# For detail config for log4j as input,

# See: https://www.elastic.co/guide/en/logstash/current/plugins-inputs-log4j.html

log4j {

mode => "server"

host => "centos2"

port => 4567

}

}

filter {

#Only matched data are send to output.

}

output {

# For detail config for elasticsearch as output,

# See: https://www.elastic.co/guide/en/logstash/current/plugins-outputs-elasticsearch.html

elasticsearch {

action => "index"       #The operation on ES

hosts  => "centos2:9200" #ElasticSearch host, can be array.

index  => "applog"      #The index to write data to.

}

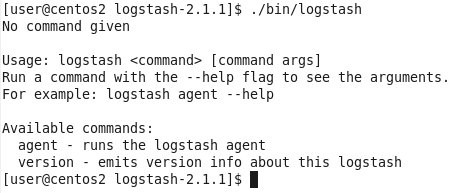

}logstashеСљдї§еП™жЬЙ2дЄ™еПВжХ∞пЉЪ

еЫ†ж≠§дљњзФ®agentжЭ•еРѓеК®еЃГпЉИдљњзФ®-fжМЗеЃЪйЕНзљЃжЦЗдїґпЉЙпЉЪ

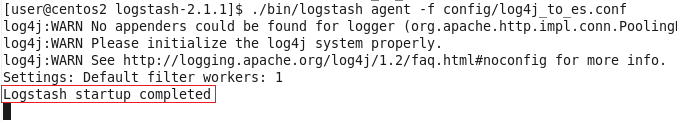

./bin/logstash agent -f config/log4j_to_es.conf

еИ∞ињЩйЗМпЉМжИСдїђеЈ≤зїПеПѓдї•дљњзФ®LogstashжЭ•жФґйЫЖжЧ•ењЧеєґдњЭе≠ШеИ∞ESдЄ≠дЇЖпЉМдЄЛйЭҐжЭ•зЬЛзЬЛй°єзЫЃдї£з†БгАВ

Javaй°єзЫЃ

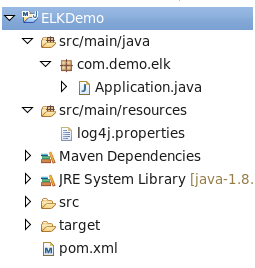

зЕІдЊЛеЕИзЬЛй°єзЫЃзїУжЮДеЫЊпЉЪ

pom.xmlпЉМеЊИзЃАеНХпЉМеП™зФ®еИ∞дЇЖLog4jеЇУпЉЪ

<dependency>

<groupId>log4j</groupId>

<artifactId>log4j</artifactId>

<version>1.2.17</version>

</dependency>log4j.propertiesпЉМе∞ЖLog4jзЪДжЧ•ењЧиЊУеЗЇеИ∞SocketAppenderпЉМеЫ†дЄЇеЃШзљСжШѓињЩдєИиѓізЪДпЉЪ

log4j.rootLogger=INFO,console

# for package com.demo.elk, log would be sent to socket appender.

log4j.logger.com.demo.elk=DEBUG, socket

# appender socket

log4j.appender.socket=org.apache.log4j.net.SocketAppender

log4j.appender.socket.Port=4567

log4j.appender.socket.RemoteHost=centos2

log4j.appender.socket.layout=org.apache.log4j.PatternLayout

log4j.appender.socket.layout.ConversionPattern=%d [%-5p] [%l] %m%n

log4j.appender.socket.ReconnectionDelay=10000

# appender console

log4j.appender.console=org.apache.log4j.ConsoleAppender

log4j.appender.console.target=System.out

log4j.appender.console.layout=org.apache.log4j.PatternLayout

log4j.appender.console.layout.ConversionPattern=%d¬†[%-5p]¬†[%l]¬†%m%nж≥®жДПпЉЪињЩйЗМзЪДзЂѓеП£еПЈйЬАи¶БиЈЯLogstashзЫСеРђзЪДзЂѓеП£еПЈдЄАиЗіпЉМињЩйЗМжШѓ4567гАВ

Application.javaпЉМдљњзФ®Log4jзЪДLOGGERжЙУеН∞жЧ•ењЧеН≥еПѓпЉЪ

package com.demo.elk;

import org.apache.log4j.Logger;

public class Application {

private static final Logger LOGGER = Logger.getLogger(Application.class);

public static void main(String[] args) throws Exception {

for (int i = 0; i < 10; i++) {

LOGGER.error("Info log [" + i + "].");

Thread.sleep(500);

}

}

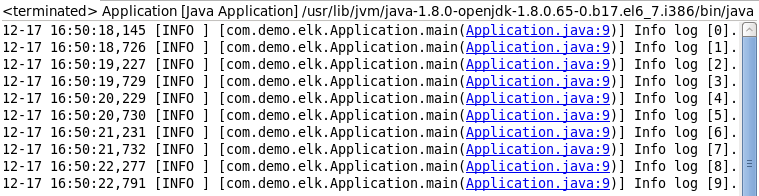

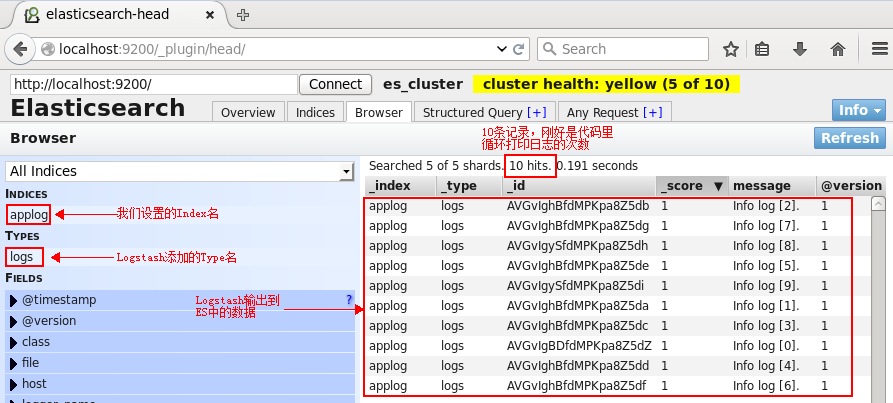

}зФ®HeadжПТдїґжЯ•зЬЛESзКґжАБеТМеЖЕеЃє

ињРи°МApplication.javaпЉМеЕИзЬЛзЬЛconsoleзЪДиЊУеЗЇпЉИељУзДґпЉМињЩдЄ™иЊУеЗЇеП™жШѓдЄЇдЇЖеБЪй™МиѓБпЉМдЄНиЊУеЗЇеИ∞consoleдєЯеПѓдї•зЪДпЉЙпЉЪ

еЖНжЭ•зЬЛзЬЛESзЪДheadй°µйЭҐпЉЪ

еИЗжНҐеИ∞Browserж†Зз≠ЊпЉЪ

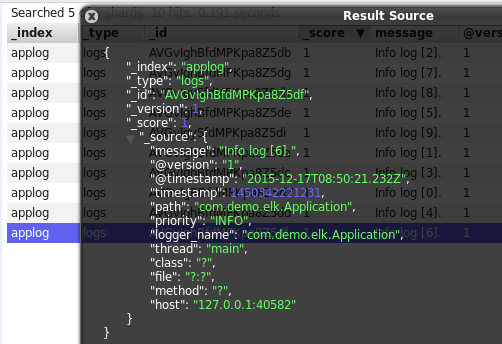

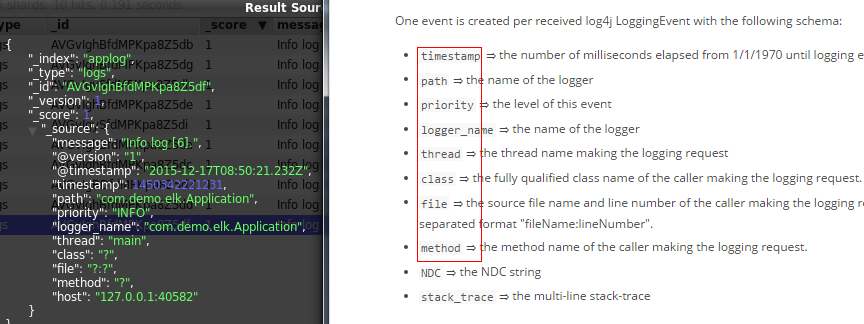

еНХеЗїжЯРдЄАдЄ™жЦЗж°£пЉИdocпЉЙпЉМеИЩдЉЪе±Хз§Їиѓ•жЦЗж°£зЪДжЙАжЬЙдњ°жБѓпЉЪ

еПѓдї•зЬЛеИ∞пЉМйЩ§дЇЖеЯЇз°АзЪДmessageе≠ЧжЃµжШѓжИСдїђзЪДжЧ•ењЧеЖЕеЃєпЉМLogstashињШдЄЇжИСдїђеҐЮеК†дЇЖиЃЄе§Ъе≠ЧжЃµгАВиАМеЬ®https://www.elastic.co/guide/en/logstash/current/plugins-inputs-log4j.htmlдЄ≠дєЯжШОз°ЃиѓіжШОдЇЖињЩдЄАзВєпЉЪ

дЄКйЭҐдљњзФ®дЇЖESзЪДHeadжПТдїґиІВеѓЯдЇЖESйЫЖзЊ§зЪДзКґжАБеТМжХ∞жНЃпЉМдљЖињЩеП™жШѓдЄ™зЃАеНХзЪДзФ®дЇОиЈЯESдЇ§дЇТзЪДй°µйЭҐиАМеЈ≤пЉМеєґдЄНиГљзФЯжИРжК•и°®жИЦиАЕеЫЊи°®дїАдєИзЪДпЉМжО•дЄЛжЭ•дљњзФ®KibanaжЭ•жЙІи°МжРЬ糥庴зФЯжИРеЫЊи°®гАВ

Kibana

йЕНзљЃKibana:

tar -zxvf kibana-4.3.0-linux-x86.tar.gz

cd kibana-4.3.0-linux-x86

vi¬†config/kibana.ymlдњЃжФєдї•дЄЛеЗ†й°єпЉИзФ±дЇОжШѓеНХжЬЇзЙИзЪДпЉМеЫ†ж≠§hostзЪДеАЉдєЯеПѓдї•дљњзФ®localhostжЭ•дї£жЫњпЉМињЩйЗМдїЕдїЕдљЬдЄЇжЉФз§ЇпЉЙпЉЪ

server.port: 5601

server.host:¬†вАЬcentos2вАЭ

elasticsearch.url: http://centos2:9200

kibana.index:¬†вАЬ.kibanaвАЭеРѓеК®kibanaпЉЪ

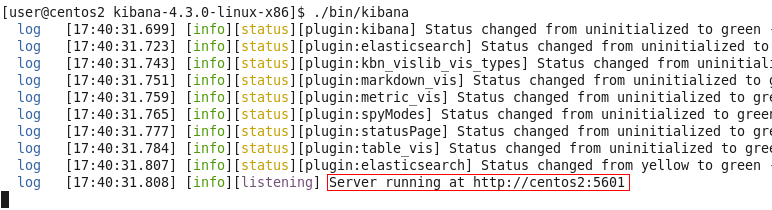

./bin/kibana

зФ®жµПиІИеЩ®жЙУеЉАиѓ•еЬ∞еЭАпЉЪ

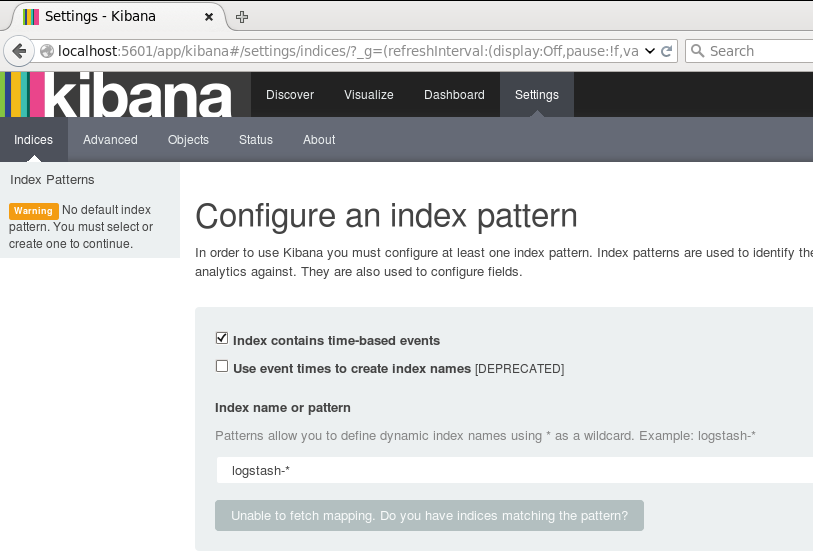

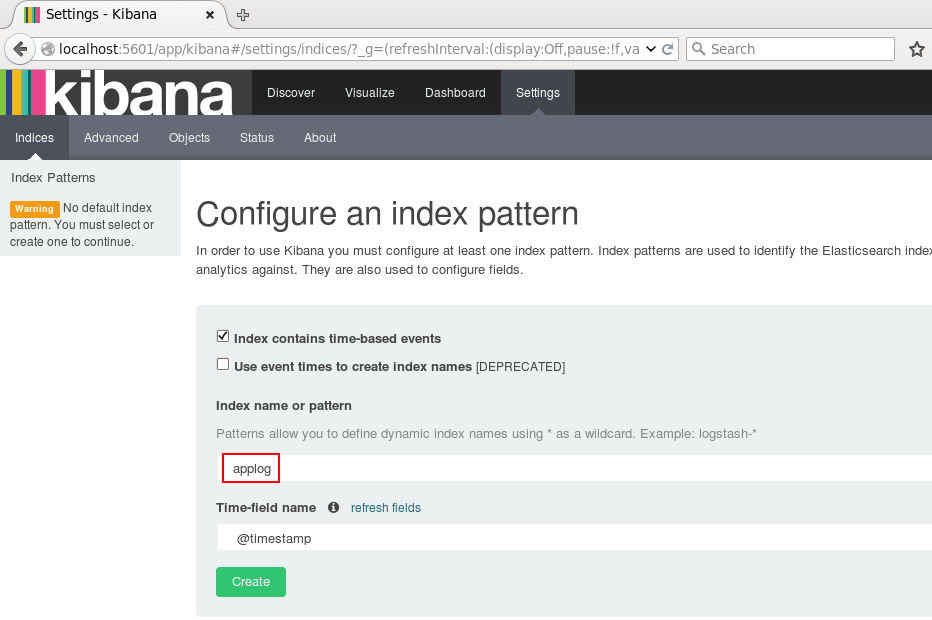

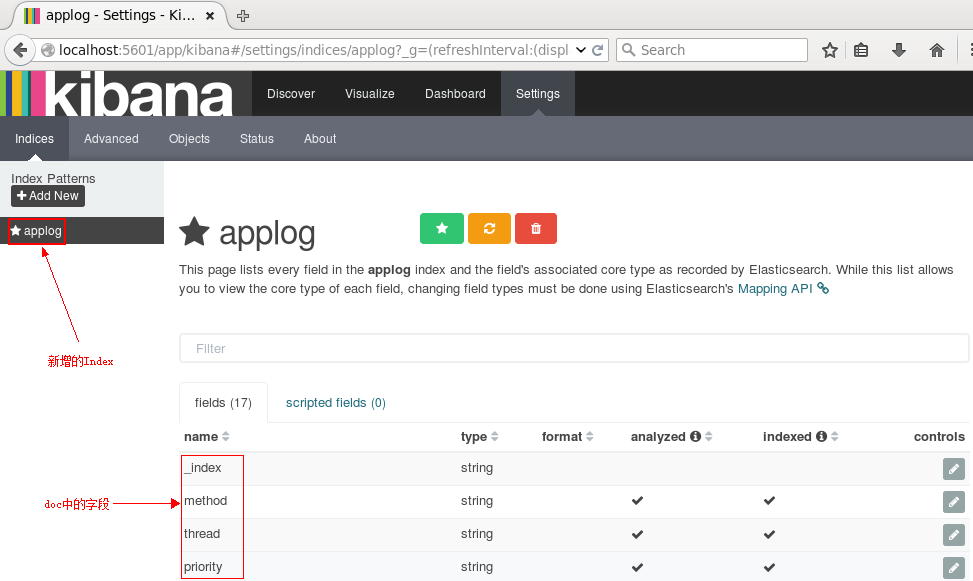

дЄЇдЇЖеРОзї≠дљњзФ®KibanaпЉМйЬАи¶БйЕНзљЃиЗ≥е∞СдЄАдЄ™IndexеРНе≠ЧжИЦиАЕPatternпЉМеЃГзФ®дЇОеЬ®еИЖжЮРжЧґз°ЃеЃЪESдЄ≠зЪДIndexгАВињЩйЗМжИСиЊУеЕ•дєЛеЙНйЕНзљЃзЪДIndexеРНе≠ЧapplogпЉМKibanaдЉЪиЗ™еК®еК†иљљиѓ•IndexдЄЛdocзЪДfieldпЉМеєґиЗ™еК®йАЙжЛ©еРИйАВзЪДfieldзФ®дЇОеЫЊж†ЗдЄ≠зЪДжЧґйЧіе≠ЧжЃµпЉЪ

зВєеЗїCreateеРОпЉМеПѓдї•зЬЛеИ∞еЈ¶дЊІеҐЮеК†дЇЖйЕНзљЃзЪДIndexеРНе≠ЧпЉЪ

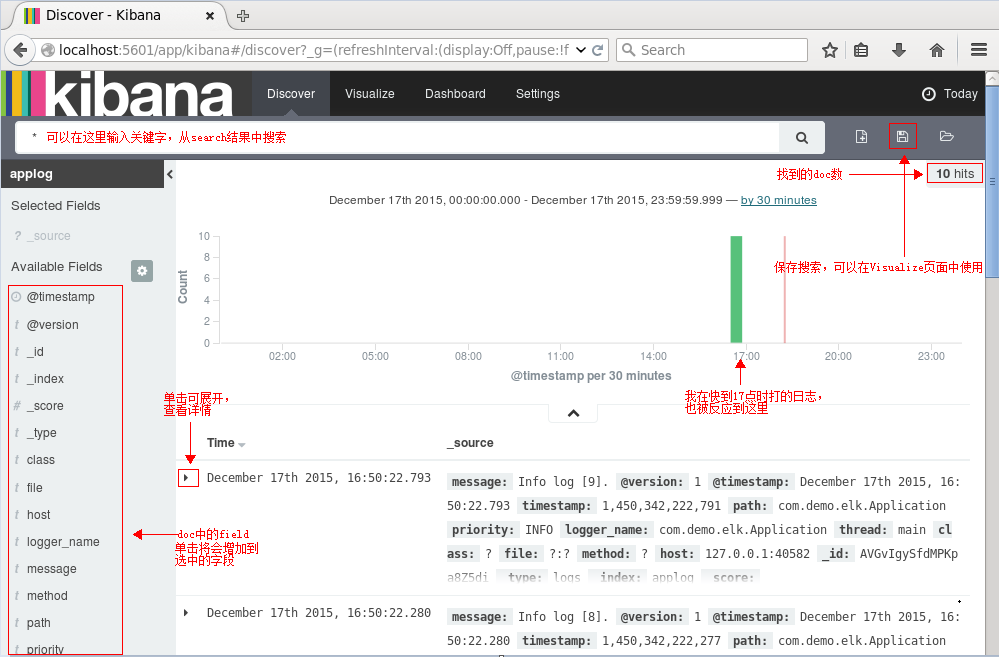

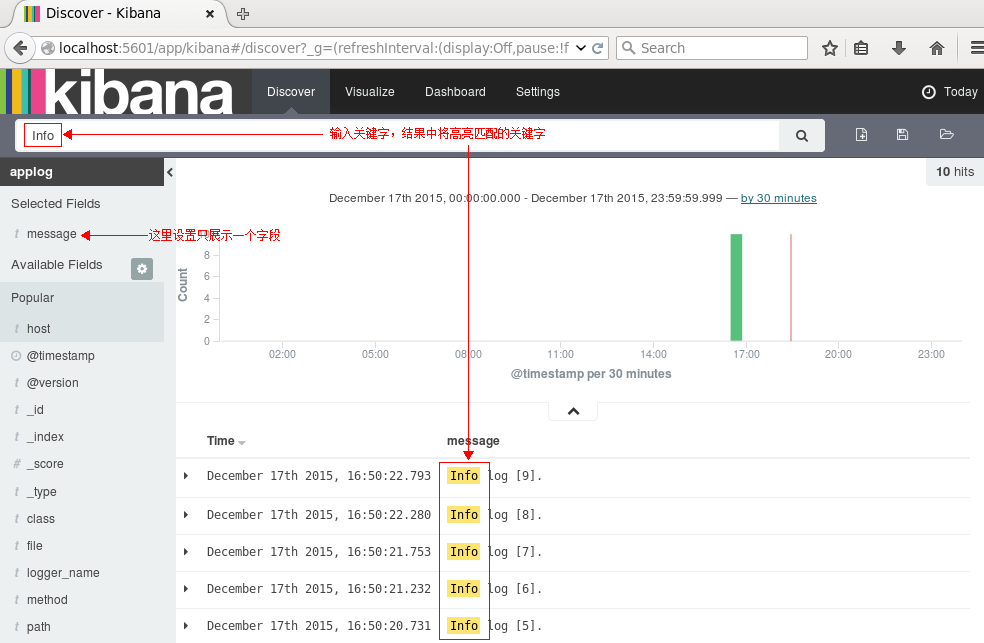

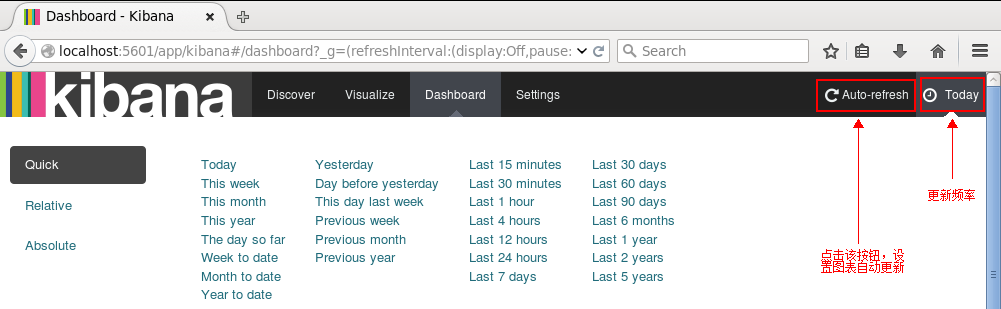

жО•дЄЛжЭ•еИЗжНҐеИ∞Discoverж†Зз≠ЊдЄКпЉМж≥®жДПеП≥дЄКиІТжШѓжߕ胥зЪДжЧґйЧіиМГеЫіпЉМе¶ВжЮЬж≤°жЬЙжЯ•жЙЊеИ∞жХ∞жНЃпЉМйВ£дєИдљ†е∞±еПѓиГљйЬАи¶Би∞ГжХіињЩдЄ™жЧґйЧіиМГеЫідЇЖпЉМињЩйЗМжИСйАЙжЛ©TodayпЉЪ

жО•дЄЛжЭ•е∞±иГљзЬЛеИ∞ESдЄ≠зЪДжХ∞жНЃдЇЖпЉЪ

жЙІи°МжРЬ糥зЬЛзЬЛеСҐпЉЪ

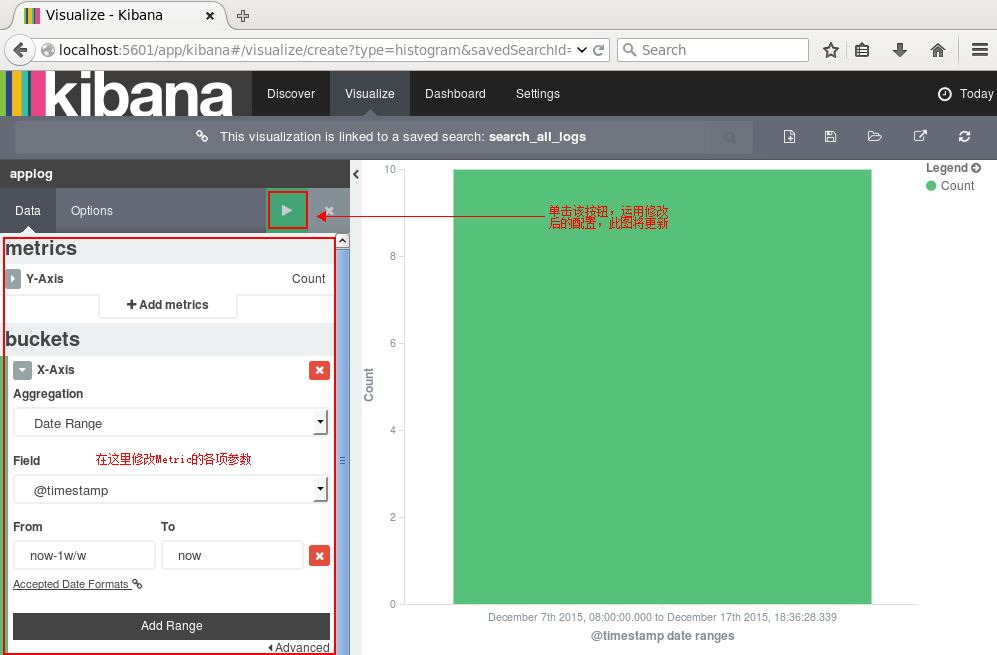

зВєеЗїеП≥иЊєзЪДдњЭе≠ШжМЙйТЃпЉМдњЭе≠Шиѓ•жߕ胥䪯search_all_logsгАВжО•дЄЛжЭ•еОїVisualizeй°µйЭҐпЉМзВєеЗїжЦ∞еїЇдЄАдЄ™жЯ±зКґеЫЊпЉИVertical Bar ChartпЉЙпЉМзДґеРОйАЙжЛ©еИЪеИЪдњЭе≠ШзЪДжߕ胥search_all_logsпЉМдєЛеРОпЉМKibanaе∞ЖзФЯжИРз±їдЉЉдЇОдЄЛеЫЊзЪДжЯ±зКґеЫЊпЉИеП™жЬЙ10жЭ°жЧ•ењЧпЉМиАМдЄФжШѓеЬ®еРМдЄАжЧґйЧіжЃµзЪДпЉМжѓФиЊГдЄСпЉМдљЖиґ≥еПѓдї•иѓіжШОйЧЃйҐШдЇЖпЉЪ) ¬†пЉЙпЉЪ

дљ†еПѓдї•еЬ®еЈ¶иЊєиЃЊзљЃеی嚥зЪДеРДй°єеПВжХ∞пЉМзВєеЗїApply ChangesжМЙйТЃпЉМеП≥иЊєзЪДеی嚥е∞Ж襀жЫіжЦ∞гАВеРМзРЖпЉМеЕґдїЦз±їеЮЛзЪДеی嚥йГљеПѓдї•еЃЮжЧґжЫіжЦ∞гАВ

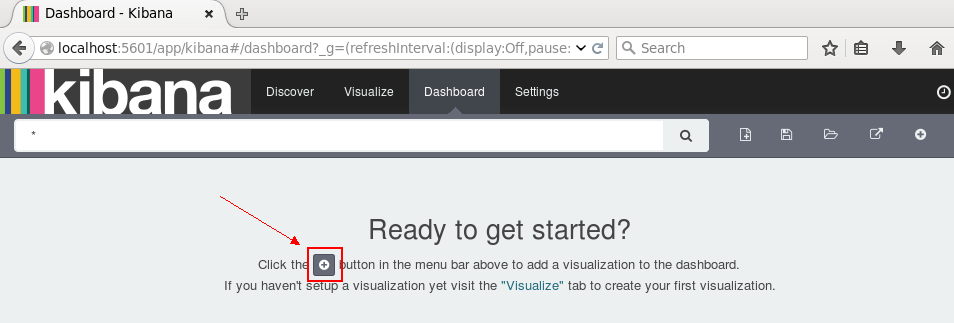

зВєеЗїеП≥иЊєзЪДдњЭе≠ШпЉМдњЭе≠Шж≠§еЫЊпЉМеСљеРНдЄЇsearch_all_logs_visualгАВжО•дЄЛжЭ•еИЗжНҐеИ∞Dashboardй°µйЭҐпЉЪ

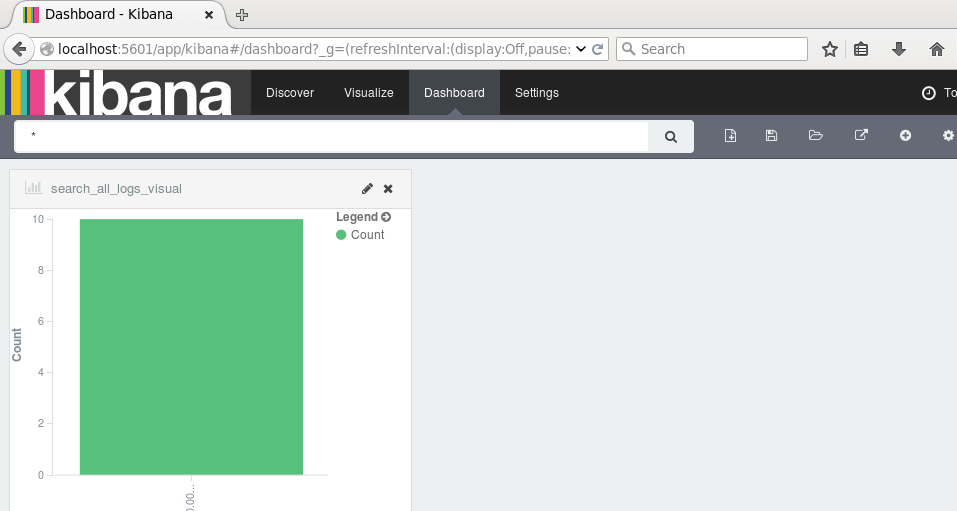

еНХеЗїжЦ∞еїЇжМЙйТЃпЉМйАЙжЛ©еИЪеИЪдњЭе≠ШзЪДsearch_all_logs_visualеی嚥пЉМйЭҐжЭњдЄКе∞Же±Хз§Їиѓ•еЫЊпЉЪ

е¶ВжЮЬжЬЙиЊГе§ЪжХ∞жНЃпЉМжИСдїђеПѓдї•ж†єжНЃдЄЪеК°йЬАж±ВеТМеЕ≥ж≥®зВєеЬ®Dashboardй°µйЭҐжЈїеК†е§ЪдЄ™еЫЊи°®пЉЪж߱嚥еЫЊпЉМжКШзЇњеЫЊпЉМеЬ∞еЫЊпЉМй•ЉеЫЊз≠Йз≠ЙгАВељУзДґпЉМжИСдїђеПѓдї•иЃЊзљЃжЫіжЦ∞йҐСзОЗпЉМиЃ©еЫЊи°®иЗ™еК®жЫіжЦ∞пЉЪ

е¶ВжЮЬиЃЊзљЃзЪДжЧґйЧійЧійЪФе§ЯзЯ≠пЉМе∞±еЊИиґЛињСдЇОеЃЮжЧґеИЖжЮРдЇЖгАВ

еИ∞ињЩйЗМпЉМELKеє≥еП∞йГ®зљ≤еТМеЯЇжЬђзЪДжµЛиѓХеЈ≤еЃМжИРгАВ

еПВиАГпЉЪ

http://baidu.blog.51cto.com/71938/1676798

http://blog.csdn.net/cnweike/article/details/33736429

зЫЄеЕ≥жО®иНР

е§ІжХ∞жНЃжРЬ糥дЄОжЧ•ењЧжМЦжОШеПКеПѓиІЖеМЦжЦєж°ИвАФвАФELK StackпЉЪElasticsearch Logstash KibanaпЉИзђђ2зЙИпЉЙ

- **дњЃжФєelasticsearchйЕНзљЃ**пЉЪзЉЦиЊС`/etc/elasticsearch/elasticsearch.yml`жЦЗдїґпЉМдњЃжФє`network.host`еПВжХ∞гАВ - **еРѓеК®elasticsearch**пЉЪ`systemctl start elasticsearch`гАВ - **жЈїеК†еИ∞еЉАжЬЇиЗ™еРѓеК®**пЉЪ`systemctl ...

зФ®дЇОжЙєйЗПеРѓеК®elasticsearchгАБlogstashгАБkibanaзЪДжЙєе§ДзРЖиДЪжЬђ

гАКе§ІжХ∞жНЃжРЬ糥дЄОжЧ•ењЧжМЦжОШеПКеПѓиІЖеМЦжЦєж°ИпЉЪELK StackпЉИElasticsearch, Logstash, KibanaпЉЙзђђдЇМзЙИгАЛ еЬ®е§ІжХ∞жНЃйҐЖеЯЯпЉМжЬЙжХИеЬ∞зЃ°зРЖеТМеИЖжЮРжµЈйЗПжХ∞жНЃжШѓиЗ≥еЕ≥йЗНи¶БзЪДгАВELK StackпЉМеН≥ElasticsearchгАБLogstashеТМKibanaзЪДзїДеРИпЉМжПРдЊЫдЇЖ...

kubernetes-elk-cluster, еЬ®KubernetesзЪДй°ґйГ®пЉМELK ( Elasticsearch Logstash Kibana ) йЫЖзЊ§ kubernetes-elk-clusterELK ( иЛ±йХС Elasticsearch Logstash иЛ±йХС Kibana )пЉМдљњeasyиљїжЭЊгАВеЬ®ињЩйЗМдљ†еПѓдї•жЙЊеИ∞пЉЪињЮжО•Elastic...

elk 6иІЖйҐСжХЩз®Лelastic stackеЃЮжИШElasticsearch Logstash Kibana

йАЪињЗе∞ЖLogstashжФґйЫЖгАБе§ДзРЖеТМдЉ†иЊУжЧ•ењЧпЉМElasticsearchе≠ШеВ®еТМжРЬ糥ињЩдЇЫжЧ•ењЧпЉМдї•еПКKibanaжПРдЊЫеПѓиІЖеМЦзЪДзХМйЭҐпЉМELK StackдЄЇзФ®жИЈжПРдЊЫдЇЖдЄАжХіе•ЧеЉЇе§ІзЪДжЧ•ењЧеИЖжЮРиГљеКЫгАВињЩзІНзїДеРИе∞§еЕґйАВеРИдЇОе§ІеЮЛеИЖеЄГеЉПз≥їзїЯзЪДжЧ•ењЧзЃ°зРЖеТМзЫСжОІпЉМжЬЙеК©дЇО...

жАїзїУиµЈжЭ•пЉМ"elasticsearch+logstash+kibana+filebeat.7z (ELK 7.9.0)" еОЛзЉ©еМЕеМЕеРЂдЇЖдЄАе•ЧеЃМжХізЪДжЧ•ењЧзЃ°зРЖеТМеИЖжЮРеЈ•еЕЈйУЊпЉМйАВзФ®дЇОе§ІжХ∞жНЃзОѓеҐГпЉМеПѓдї•еЄЃеК©дЉБдЄЪеЃЮзО∞йЂШжХИзЪДжХ∞жНЃжФґйЫЖгАБе§ДзРЖгАБе≠ШеВ®еТМеПѓиІЖеМЦгАВйАЪињЗдљњзФ®ињЩе•ЧеЈ•еЕЈпЉМ...

ELKжШѓдЄЙдЄ™еЉАжЇРиљѓдїґзЪДзЉ©еЖЩпЉМеИЖеИЂи°®з§ЇпЉЪElasticsearch , Logstash, Kibana , еЃГдїђйГљжШѓеЉАжЇРиљѓдїґгАВжЦ∞еҐЮдЇЖдЄАдЄ™FileBeatпЉМеЃГжШѓдЄАдЄ™иљїйЗПзЇІзЪДжЧ•ењЧжФґйЫЖе§ДзРЖеЈ•еЕЈ(Agent)пЉМFilebeatеН†зФ®иµДжЇРе∞СпЉМйАВеРИдЇОеЬ®еРДдЄ™жЬНеК°еЩ®дЄКжРЬйЫЖжЧ•ењЧеРО...

еѓєдЇОжЧ•ењЧжЭ•иѓіпЉМжЬАеЄЄиІБзЪДйЬАж±Ве∞±жШѓжФґйЫЖгАБе≠ШеВ®гАБжߕ胥гАБе±Хз§ЇпЉМеЉАжЇРз§ЊеМЇж≠£е•љжЬЙзЫЄеѓєеЇФзЪДеЉАжЇРй°єзЫЃпЉЪlogstashпЉИжФґйЫЖпЉЙгАБelasticsearchпЉИе≠ШеВ®+жРЬ糥пЉЙгАБkibanaпЉИе±Хз§ЇпЉЙпЉМжИСдїђе∞ЖињЩдЄЙдЄ™зїДеРИиµЈжЭ•зЪДжКАжЬѓзІ∞дєЛдЄЇELKпЉМжЙАдї•иѓіELKжМЗзЪДжШѓ...

ELK(ElasticSearch, Logstash, Kibana)жР≠еїЇеЃЮжЧґжЧ•ењЧеИЖжЮРеє≥еП∞иµДжЇР ELKпЉИElasticSearch, Logstash, KibanaпЉЙеє≥еП∞жБ∞е•љеПѓдї•еРМжЧґеЃЮзО∞жЧ•ењЧжФґйЫЖгАБжЧ•ењЧжРЬ糥еТМжЧ•ењЧеИЖжЮРзЪДеКЯиГљ

гАКеЃЮжИШElasticsearchгАБLogstashгАБKibana++еИЖеЄГеЉПе§ІжХ∞жНЃжРЬ糥дЄОжЧ•ењЧжМЦжОШеПКеПѓиІЖеМЦиІ£еЖ≥жЦєж°ИгАЛињЩжЬђдє¶дЄїи¶БиБЪзД¶дЇОдљњзФ®ElasticsearchгАБLogstashеТМKibanaжЮДеїЇйЂШжХИзЪДе§ІжХ∞жНЃе§ДзРЖеТМеПѓиІЖеМЦеє≥еП∞гАВдї•дЄЛжШѓеѓєињЩдЇЫеЕ≥йФЃзїДдїґеПКеЕґеЬ®еЃЮйЩЕ...

еЬ®CentOSгАБзЇҐеЄљlinuxдЄЛеЃЙи£ЕгАБйЕНзљЃгАБдљњзФ®ElasticsearchпЉМlogstashпЉМkibanaеПКзЫЄеЕ≥еЈ•еЕЈеИЖжЮРNginxжЧ•ењЧзЪДиѓ¶зїЖгАБдњЭиѓБеПѓзФ®зЪДжМЗеНЧжЦЗж°£пЉМдљњзФ®ELK 5.2.2пЉМеЕ®йГ®ињЗз®ЛйГљзїПињЗдЇЖй™МиѓБпЉМзљСдЄКзЪДзЫЄеЕ≥еЖЕеЃєи¶БдєИйАВзФ®дЇОELKзЪДиАБзЙИжЬђпЉМи¶БдєИдЄН...

еЉАжЇРеЃЮжЧґжЧ•ењЧеИЖжЮРELKеє≥еП∞иГље§ЯеЃМзЊОзЪДиІ£еЖ≥жЧ•ењЧжФґйЫЖеТМжЧ•ењЧж£А糥гАБеИЖжЮРзЪДйЧЃйҐШпЉМELKе∞±жШѓжМЗElasticSearchгАБLogstashеТМKiabanaдЄЙдЄ™еЉАжЇРеЈ•еЕЈгАВ еЫ†дЄЇELKжШѓеПѓдї•иЈ®еє≥еП∞йГ®зљ≤пЉМеЫ†ж≠§йЭЮеЄЄйАВзФ®дЇОе§Ъеє≥еП∞йГ®зљ≤зЪДеЇФзФ®гАВ дЇМ зОѓеҐГеЗЖе§З 1...

еЯЇдЇОdocker-composeжЮДеїЇfilebeat + Logstash +Elasticsearch+ kibanaжЧ•ењЧз≥їзїЯ еѓєnginxжЧ•ењЧињЫи°Мж≠£еИЩеИЗеЙ≤е≠ЧжЃµгАВ https://www.jianshu.com/p/f7927591d530

е§ІжХ∞жНЃжРЬ糥дЄОжЧ•ењЧжМЦжОШеПКеПѓиІЖеМЦжЦєж°И--ELK+Stack+Elasticsearch+Logstash+Kibanaе§ІжХ∞жНЃжРЬ糥дЄОжЧ•ењЧжМЦжОШеПКеПѓиІЖеМЦжЦєж°И--ELK+Stack+Elasticsearch+Logstash+Kibana

ELKе†Жж†ИпЉМеН≥ElasticsearchгАБLogstashеТМKibanaпЉМжШѓзФ®дЇОжЧ•ењЧзЃ°зРЖеТМеИЖжЮРзЪДеЉЇе§ІеЈ•еЕЈзїДеРИгАВињЩдЄ™йЫЖзЊ§йГ®зљ≤жЦєж°ИжЧ®еЬ®жПРдЊЫдЄАдЄ™йЂШжХИдЄФеПѓжЙ©е±ХзЪДжЧ•ењЧиІ£еЖ≥жЦєж°ИпЉМеЄЃеК©ITзЃ°зРЖеСШеТМеЉАеПСдЇЇеСШзЫСжОІгАБжРЬ糥гАБеИЖжЮРеТМеПѓиІЖеМЦе§ІйЗПз≥їзїЯгАБеЇФзФ®еПК...

дЄЇдЇЖиІ£еЖ≥ињЩдЄАйЧЃйҐШпЉМELK stackеЇФињРиАМзФЯпЉМеЃГжШѓзФ±ElasticsearchгАБLogstashгАБKibanaеТМKafkaзїДжИРзЪДеЉАжЇРеЃЮжЧґжЧ•ењЧеИЖжЮРз≥їзїЯгАВжЬђзѓЗжЦЗзЂ†иѓ¶зїЖдїЛзїНдЇЖе¶ВдљХдљњзФ®Elasticsearch5.3.2гАБLogstash5.3.2гАБKibana5.3.2дї•еПКKafka-*.**.*.*...

ELKжШѓElasticsearchгАБLogstashгАБKibanaзЪДзЃАзІ∞пЉМињЩдЄЙиАЕжШѓж†ЄењГе•ЧдїґпЉМдљЖеєґйЭЮеЕ®йГ®гАВ ElasticsearchжШѓеЃЮжЧґеЕ®жЦЗжРЬ糥еТМеИЖжЮРеЉХжУОпЉМжПРдЊЫжРЬйЫЖгАБеИЖжЮРгАБе≠ШеВ®жХ∞жНЃдЄЙе§ІеКЯиГљпЉЫжШѓдЄАе•ЧеЉАжФЊRESTеТМJAVA APIз≠ЙзїУжЮДжПРдЊЫйЂШжХИжРЬ糥еКЯиГљпЉМеПѓ...