以下文章是通过经验总结而得出的结论

在使用mongodb开发工作中,mongodb内存使用非常之大,64G的内存使用了99%的内存

通过整理和查询,了解了mongodb的内存工作原理,特此跟大家分享

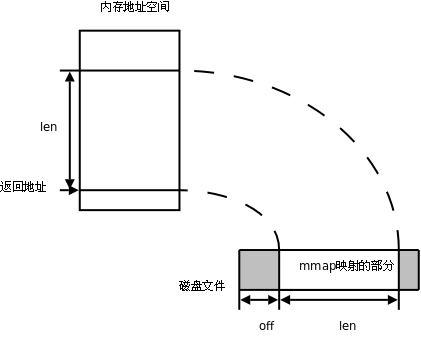

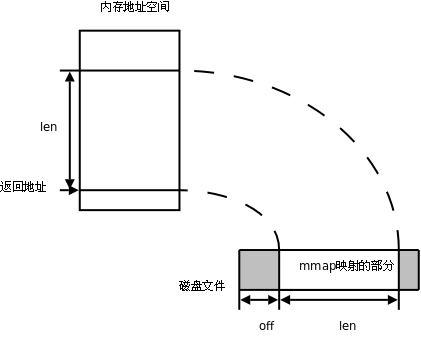

mongodb 使用MMAP 将文件映射到内存中

, 这里其实是将文件映射到了虚拟内存,只有使用过的数据才进入物理内存RSS,下面我们来证实一下

wiki:

http://www.hudong.com/wiki/mmap

我用python实现了一个mongodb在内存实现方面的功能,key:value我是用的hash,没有使用btree,代码如下仅供参考:

代码在文章后附属

1.启动mongodb 服务

python _mongo_.py

2.链接到mongo服务

telnet 0.0.0.0 8900

3.开始调试

ps x|grep python

#找到mongo对应的进程号

#接下来使用vmmap [mac] pmap[linux]查看内存使用情况

vmmap -resident 2546|grep wiyun

mapped file 0000000101000000-000000010d801000 [200.0M 8K] rw-/rwx SM=PRV /Users/liuzheng/py.work.dir/wgit/wiyun0.db

mapped file 000000010d801000-000000011a002000 [200.0M 8K] rw-/rwx SM=PRV /Users/liuzheng/py.work.dir/wgit/wiyun1.db

#这里大家看到文件初始大小为200M,RSS内存使用了8k,VM 使用了200M

#接下来我们操作数据库

telnet 0.0.0.0 8900

set a=1

set c=2

get a

get c

set a=helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_

set c=helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_

set d=helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_

set e=helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_helloworld_

gat e

vmmap -resident 2546|grep wiyun

mapped file 0000000101000000-000000010d801000 [200.0M 1032K] rw-/rwx SM=PRV /Users/liuzheng/py.work.dir/wgit/wiyun0.db

mapped file 000000010d801000-000000011a002000 [200.0M 8K] rw-/rwx SM=PRV /Users/liuzheng/py.work.dir/wgit/wiyun1.db

#这里RSS内存使用变为了1032K,说明是使用过多数据进入了内存

cat wiyun0.db

#电池没电了,先到这里

摘录:再说说MongoDB是如何使用内存的

目前,MongoDB使用的是内存映射存储引擎,它会把磁盘IO操作转换成内存操作,如果是读操作,内存中的数据起到缓存的作用,如果是写操作,内存还可以把随机的写操作转换成顺序的写操作,总之可以大幅度提升性能。MongoDB并不干涉内存管理工作,而是把这些工作留给操作系统的虚拟缓存管理器去处理,这样的好处是简化了MongoDB的工作,但坏处是你没有方法很方便的控制MongoDB占多大内存,事实上MongoDB会占用所有能用的内存,所以最好不要把别的服务和MongoDB放一起。

有时候,即便MongoDB使用的是64位操作系统,也可能会遭遇臭名昭著的OOM问题,出现这种情况,多半是因为限制了虚拟内存的大小所致,可以这样查看当前值:

shell> ulimit -a | grep 'virtual'

多数操作系统缺省都是把它设置成unlimited的,如果你的操作系统不是,可以这样修改:

shell> ulimit -v unlimited

不过要注意的是,ulimit的使用是有上下文的,最好放在MongoDB的启动脚本里

#coding=utf-8

#_mongo_.py 源码

import os, sys

import errno

import functools

import socket

import time

import os

import traceback

import memcache

from tornado import ioloop, iostream

from threading import Thread

from Queue import Queue

import logging

import mmap

import random

streamDict = {} #用于保存stream

streamRequests = {} #Stream 请求数据队列

io_loop = None #侦听网络服务对象

mmap_obj = None

def printLog(log):

tstr = time.strftime("%Y-%m-%d %X", time.localtime())

print tstr, log

def stream_add(stream, count):

streamkey = str(stream)

streamDict[streamkey] = (stream, 0)

streamRequests[streamkey] = Queue()

def stream_remove(streamkey, stream):

print "stream closed", stream.__dict__

stream.close()

if streamDict.has_key(streamkey):

del streamDict[streamkey]

if streamRequests.has_key(streamkey):

del streamRequests[streamkey]

class MMapping(object):

data_map = []

_hash = {}

def __init__(self, data_path, db):

self.read_ns_file(data_path,db)

def read_ns_file(self, data_path, db):

#f = open(os.path.join(data_path, db + ".ns"), "w+b")

#for i in xrange(1):

sz = (1024 * 1024 * 200 )

db_name = "%s.db" % (db)

f = open(os.path.join(data_path,db_name), "w+b")

f.seek(sz)

if f.readline() != "\0":

f.write('\0')

f.flush()

MMapping.data_map.append(mmap.mmap(f.fileno(), 0))

def parse_data(self, data):

command, values = data.split(" ")

if command == "set":

key, value = values.split("=")

return command, key, value

else:

key = values.strip()

self._hash.get(key, "no match\r\n")

return command, key, None

def flush_data(self, data):

self.data_map[0].write(data)

def get_data(self, data):

command, key, value = self.parse_data(data)

print "command,key,value", command, key, value

if command == "set":

d = "%s=%s" % (key, value)

self.flush_data(d)

self._hash[key] = value

return "True"

else:

return self._hash.get(key, "on match")

class ClockResponse(Thread):

def __init__(self):

Thread.__init__(self)

self.flag = True

self.count = 0

def run(self):

while self.flag:

#打印 LOG,N次/打印

ct = self.count % 10000

if ct == 0:

print 'now connections:%s' % (len(streamDict))

self.count = ct + 1

us = 0

for streamkey, (stream, num) in streamDict.items():

queue = streamRequests[streamkey]

try:

data = queue.get(False)

except Exception, e:

continue

if data:

print "get data %s", data

else:

continue

try:

d = mmap_obj.get_data(data)

stream.write(d + "\r\n")

except Exception, e:

logging.error(e)

stream.write(str(e) + "\r\n")

time.sleep(0.01)

def stop(self):

self.flag = False

class SocketRequest(object):

delimiter = "\r\n"

def __init__(self, stream, address):

self.stream = stream

self.streamkey = str(stream)

self.address = address

self.stream.read_until(SocketRequest.delimiter, self.on_body)

def on_body(self, data):

queue = streamRequests[self.streamkey]

size = queue.qsize()

if size <= 10000:

print "put in queue %s " % data

queue.put(data)

try:

self.stream.read_until(SocketRequest.delimiter, self.on_body)

except Exception, e:

print "in read", e

stream_remove(self.streamkey, self.stream)

def connection_ready(sock, fd, events):

while True:

try:

connection, address = sock.accept()

except socket.error, e:

if e[0] not in (errno.EWOULDBLOCK, errno.EAGAIN):

raise

return

print "connection on:", address

#non-block

connection.setblocking(0)

stream = iostream.IOStream(connection, io_loop)

stream_add(stream, 0)

skey = str(stream)

scallback = functools.partial(stream_remove, skey, stream)

stream.set_close_callback(scallback)

SocketRequest(stream, address)

def run_thread_worker(n=1):

threads = []

for t in xrange(n):

clock = ClockResponse()

threads.append(clock)

for t in threads:

t.start()

if __name__ == '__main__':

server_port = 8900

#init data

data_path = os.path.abspath(os.path.join(os.path.dirname(__file__)))

mmap_obj = MMapping(data_path, "wiyun")

run_thread_worker(1)

sock = socket.socket(socket.AF_INET, socket.SOCK_STREAM, socket.IPPROTO_TCP)

sock.setsockopt(socket.SOL_SOCKET, socket.SO_REUSEADDR, 1)

sock.setblocking(0)

sock.bind(("", server_port))

sock.listen(9999)

io_loop = ioloop.IOLoop.instance()

callback = functools.partial(connection_ready, sock)

io_loop.add_handler(sock.fileno(), callback, io_loop.READ)

try:

io_loop.start()

except KeyboardInterrupt:

io_loop.stop()

clock.stop()

print "exited cleanly"

sys.exit(1)

except Exception, e:

print e

#mongodb 调试

shell> top -p $(pidof mongod)

Mem: 32872124k total, 30065320k used, 2806804k free, 245020k buffers

Swap: 2097144k total, 100k used, 2097044k free, 26482048k cached

VIRT RES SHR %MEM

1892g 21g 21g 69.6

#平时可以通过mongo命令行来监控MongoDB的内存使用情况,如下所示:

mongo> db.serverStatus().mem:

{

"resident" : 22346,

"virtual" : 1938524,

"mapped" : 962283

}

其中内存相关字段的含义是:

mapped:映射到内存的数据大小

visze:占用的虚拟内存大小

res:实际使用的内存大小

注:如果操作不能再内存中完成,结果faults列的数值不会是0,视大小可能有性能问题。

在上面的结果中,vsize是mapped的两倍,而mapped等于数据文件的大小,所以说vsize是数据文件的两倍,之所以会这样,是因为本例中,MongoDB开启了journal,需要在内存里多映射一次数据文件,如果关闭journal,则vsize和mapped大致相当。

如果想验证这一点,可以在开启或关闭journal后,通过pmap命令来观察文件映射情况:

shell> pmap $(pidof mongod)

分享到:

相关推荐

**Python-mtools:MongoDB测试环境与日志分析利器** `Python-mtools` 是一个强大的工具集合,专门针对MongoDB数据库进行测试环境的搭建以及日志文件的分析和可视化。这个开源项目由Rückstädt开发,其版本号为...

1. **实时性能监控**:Python-mtop能够实时显示MongoDB服务器的各项关键指标,如CPU使用率、内存占用、磁盘I/O、网络吞吐量等。 2. **多线程支持**:它支持同时监控多个MongoDB实例,这对于处理分布式集群或复制集...

该插件的核心功能是通过Python编程语言与MongoDB服务器进行交互,检查其运行状态,包括但不限于连接性、数据库读写性能、内存使用情况、磁盘空间、复制集状态等。这为系统管理员提供了一种有效的方式来确保MongoDB...

MongoDB是一种流行的开源、分布式文档数据库,而MongoEngine是针对MongoDB的一个强大的Python对象文档映射库(ORM)。它使得Python开发者能够以更加面向对象的方式来操作数据,类似于SQL数据库中的ActiveRecord或 ...

8. **性能优化**:涵盖工作负载分析、查询优化、存储引擎选择、内存管理等方面的策略,以提升 MongoDB 的运行效率。 9. **操作与监控**:如何使用 MongoDB 的命令行工具、监控工具以及日志管理,进行日常维护和故障...

pymongo是Python官方推荐的MongoDB驱动程序,通过它可以直接操作MongoDB数据库,执行查询、插入、删除和更新等操作。 MongoDB支持多种数据类型,包括但不限于字符串、整型、布尔类型、双精度浮点数、数组、时间戳、...

2.资源占用高:MongoDB需要占用一定的资源,例如CPU、内存等。 3. 数据一致性难以保证:MongoDB使用的是最终一致性模型,可能会出现数据不一致的情况。 WebStorm配置MongoDB可以提高开发效率和数据处理能力,...

3. **高性能**:MongoDB采用内存映射技术,将数据存储在内存中,读写速度非常快,尤其适合实时查询和分析。 4. **灵活查询**:MongoDB提供了强大的查询语言MongoDB Shell,支持丰富的查询操作,包括索引、聚合框架...

- **驱动程序选择**:MongoDB支持多种语言的驱动程序,如Python、Java、Node.js等,选择合适的驱动有助于简化开发。 - **设计API**:如何设计RESTful API,使应用与MongoDB交互更高效、简洁。 - **错误处理与异常...

1. MongoDB架构:深入解析MongoDB的内部工作机制,包括数据存储、内存管理、锁机制等。 2. 高级查询:涵盖更复杂的查询技巧,如正则表达式、地理空间查询和时间序列数据处理。 3. MapReduce与Aggregation Framework...

8. **高性能**:MongoDB采用了内存映射技术,将数据存储在内存中,大大提升了读写速度。 9. **社区支持**:MongoDB拥有活跃的开发者社区,提供了丰富的文档、教程和第三方工具,方便用户学习和使用。 10. **API...

4. **内存映射存储引擎**:MongoDB使用内存映射存储引擎,这使得数据文件和索引以一种高效的方式被映射到内存中,从而加速数据的读写操作。在云存储环境下,这种引擎可以提升大量数据处理的速度。 5. **GridFS**:...

9. 性能优化:MongoDB允许进行内存映射(memory-mapped files),使得数据读写更高效。同时,它支持TTL(Time To Live)索引,可以自动删除过期数据,保持数据库的整洁。 在下载MongoDB时,通常可以从官方网站获取...

8. **驱动程序支持**:MongoDB提供了多种编程语言的驱动程序,如Python、Java、Node.js等,方便开发者在不同环境下使用。 9. **安全性**:MongoDB支持身份验证、访问控制、SSL加密以及审计日志,以保证数据的安全。...

- **跨平台兼容性**:MongoDB可以在多种操作系统上运行,包括但不限于OS X、Linux和Windows等,并为多种编程语言提供了官方驱动程序,如Python、PHP、Ruby、Java、C#、JavaScript、Perl和C++等,甚至还有对Erlang和...

MongoDB提供了多种编程语言的驱动,如Python、Java、Node.js等,使得开发者可以方便地在不同语言环境中使用MongoDB。了解这些驱动的使用方法和最佳实践,能提高开发效率。 八、安全与认证 确保MongoDB的安全性同样...

### MySQL与MongoDB性能对比分析 #### 测试背景与目的 随着大数据时代的到来,数据库的选择对系统的性能至关重要。本报告旨在通过一系列实验对比MySQL和MongoDB两种不同类型的数据库(关系型数据库与NoSQL数据库)...

在IT行业中,数据是至关重要的资源,特别是在金融领域,如股票市场分析。本文将深入探讨如何使用Python这一强大编程语言来爬取股票数据,并通过构建高效的数据存储与缓存系统来实现数据接口。以下是详细的知识点说明...

此外,MongoDB在大规模数据插入时对系统资源(尤其是内存)的消耗更为显著。 针对这些发现,建议在实际应用中根据数据特性和应用场景选择合适的数据库类型。如果主要处理大量非结构化数据,并且对数据写入速度有较...

7. **驱动支持**: MongoDB 2.0.9版本兼容多种编程语言的驱动,如Python、Java、C#、Node.js等,方便开发者在不同平台上使用。 8. **文档与社区**: MongoDB有丰富的官方文档,为用户提供详细的安装、配置和使用指南...