- 浏览: 1056715 次

- 性别:

- 来自: 北京

-

文章分类

- 全部博客 (538)

- 奇文共赏 (36)

- spring (13)

- hibernate (10)

- AOP/Aspectj (9)

- spring security (7)

- lucence (5)

- compass (3)

- jbmp (2)

- jboss rule(drools) (0)

- birt (1)

- jasper (1)

- cxf (3)

- flex (98)

- webgis (6)

- 设计模式 (1)

- 代码重构 (2)

- log4j (1)

- tomcat (9)

- 神品音乐 (1)

- 工作计划 (2)

- appfuse (1)

- svn (4)

- 寻章摘句 (3)

- eclipse (10)

- arcgis api for flex (1)

- 算法 (5)

- opengis-cs (1)

- bug心得 (13)

- 图标 (1)

- software&key (14)

- java (17)

- 搞笑视频 (13)

- sqlserver (9)

- postgresql (1)

- postgis (0)

- geoserver (5)

- 日子 (50)

- 水晶报表 (1)

- 绝对电影 (3)

- Alternativa3D (1)

- 酷站大全 (10)

- c++ (5)

- oracle (17)

- oracle spatial (25)

- flashbuilder4 (3)

- TweenLite (1)

- DailyBuild (6)

- 华山论贱 (5)

- 系统性能 (5)

- 经典古文 (6)

- SOA/SCA/OSGI (6)

- jira (2)

- Hadoop生态圈(hadoop/hbase/pig/hive/zookeeper) (37)

- 风水 (1)

- linux操作基础 (17)

- 经济 (4)

- 茶 (3)

- JUnit (1)

- C# dotNet (1)

- netbeans (1)

- Java2D (1)

- QT4 (1)

- google Test/Mock/AutoTest (3)

- maven (1)

- 3d/OSG (1)

- Eclipse RCP (3)

- CUDA (1)

- Access control (0)

- http://linux.chinaunix.net/techdoc/beginner/2008/01/29/977725.shtml (1)

- redis (1)

最新评论

-

dove19900520:

朋友,你确定你的标题跟文章内容对应???

tomcat控制浏览器不缓存 -

wussrc:

我只想说牛逼,就我接触过的那点云计算的东西,仔细想想还真是这么 ...

别样解释云计算,太TM天才跨界了 -

hw_imxy:

endpoint="/Hello/messagebr ...

flex+java代码分两个工程 -

gaohejie:

rsrsdgrfdh坎坎坷坷

Flex 与 Spring 集成 -

李涤尘:

谢谢。不过说得有点太罗嗦了。

Oracle数据库数据的导入及导出(转)

如何对hadoop作业的某个task进行debug单步跟踪

http://blog.csdn.net/AE86_FC/archive/2010/10/21/5957715.aspx

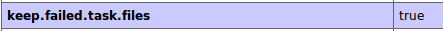

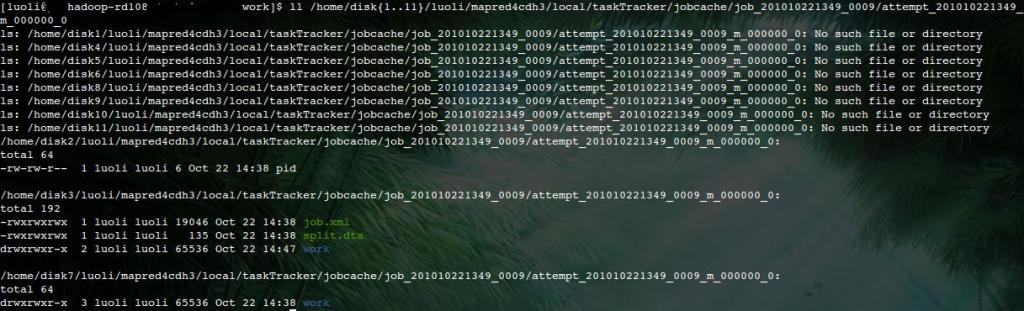

对于使用hadoop进行日志分析等工作的开发者来说,相信一直都面临着一个非常头 疼的问题。那就是:对hadoop的mapreduce作业,在分布式集群上进行单个task的单步debug跟踪调试无法办到。只能在本地进行调试,然 后提交到集群中运行,但是集群中如果某个task总是失败,要对这一个task进行单步跟踪就非常困难。其实原因很简单,因为当把作业提交到hadoop 集群进行运行的时候,你事先根本就不知道那个map或者reduce的task会被分配到哪个tasktracker上执行。所以过去的两年里,写 mapreduce应用的工程师们一直面临着这个悬而未决的问题。只能通过在程序中加日志,并在作业完成或者失败后追踪日志来进行问题定位。无法达到对程 序象调试单机程序一样的进行调试。 其 实在hadoop中,有一个好东西,利用这个好东西,就可以实现在集群中对某个task进行单步调试的需求。这个东西就是 IsolationRunner。IsolationRunner是一个小工具,能够在tasktracker机器上,重新单独运行失败的task,这样 对于某些大作业(比如job的输入有100TB),如果因为某一个task重复失败而导致整个job失败,就不用连续不断的提交job,进行复现,然后定 位某个task失败的原因,这样做的代价就会非常的大。如果能够对失败的task进行单独执行,那么要定位问题的原因代价就变得很小,对工程师来说也非常 的方便。 要 想对失败的task进行单独重跑,肯定是有前提的,大家知道,对于map而言,其输入数据是来自分布式文件系统(通常是HDFS)中输入数据的某个 split,所以如果想要重跑map task,其输入数据就需要被保留下来。同样对于reduce而言,其输入是从所有map的中间结果shuffle到该reduce的数据,如果想要重跑 reduce task,这些数据也就需要保留下来。所以为了提供对失败的task进行单独重跑的功能,作业执行过程中的中间结果,或者每个map的输入数据对应的 split数据,就需要被保留下来。为此hadoop提供了一个作业的配置选项:keep.failed.task.files,该选项默认为 false,表示对于失败的task,其运行的临时数据和目录是不会被保存的,这也是hadoop在支持这项功能前默认的做法,因为如果失败的task的 临时文件和目录被保留的过多,会占据tasktracker上过多的磁盘空间和文件数,造成磁盘浪费。而当将 keep.failed.task.files选项设置为true(注意:该配置选项是一个per job的配置),那么hadoop在执行该job时,当发生map fail或者reduce fail时,就会将task能够单独重跑的所有环境都保留下来,比如task运行时对应的job.xml,map input对应的split.dta文件,或者reduce的输入file.out文件。这样,要重跑一个map或者reduce task的环境就已经具备。

如何重跑:

当fail的task环境具备以后,就可以对单独的task进行重跑了。重跑的方式为:

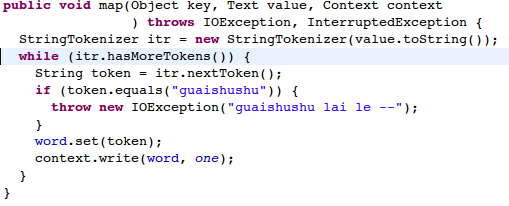

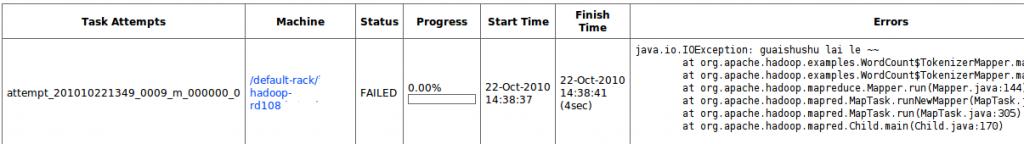

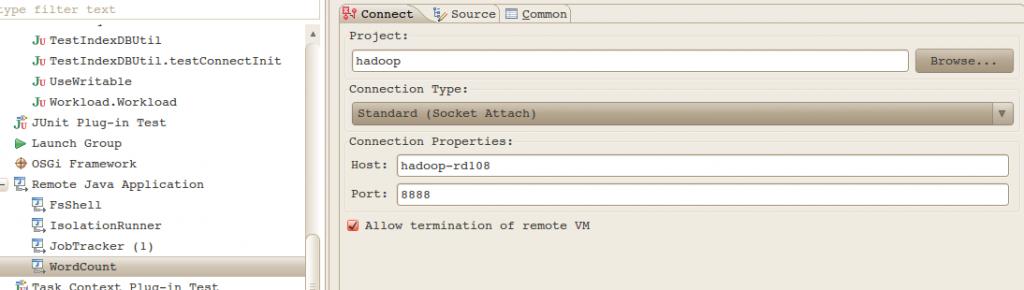

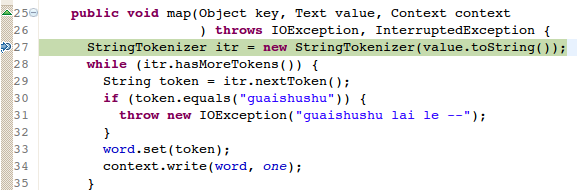

以下是图解示意,这里采用最简单的wordcount来进行示例。在wordcount的输入文 件中,加入一行数据,如“guaishushu”,然后修改wordcount的Mapper实现,如下:

这样修改以后,由于数据中有 “guaishushu”的字符串,并且该行一定会被落到某个map的输入中去,然后代码中当读到”guaishushu”的时候会抛出 IOException异常,所以该job在运行过程中就肯定会有一个task失败。然后,在提交作业时,将 keep.failed.task.files设置为true,并按如下程序提交,job就开始运行:

发表评论

-

一网打尽当下NoSQL类型、适用场景及使用公司

2014-12-28 20:56 981一网打尽当下NoSQL类型、适用场景及使用公司 http:// ... -

别样解释云计算,太TM天才跨界了

2014-02-25 09:41 2461http://mp.weixin.qq.com/s?__bi ... -

Build, Install, Configure and Run Apache Hadoop 2.2.0 in Microsoft Windows OS

2013-12-09 11:17 2557http://www.srccodes.com/p/arti ... -

hadoop的超时设置

2013-06-23 11:47 2437from http://blog.163.com/zheng ... -

hadoop与panasas

2012-12-26 09:53 892在应用的场景中,hadoop当然希望使用全部的本地硬盘,但是对 ... -

程序开过多线程,导致hadoop作业无法运行成功

2012-10-23 16:14 7077Exception in thread "Threa ... -

mount盘异常,导致hadoop作业无法发送

2012-10-23 16:12 965异常信息 2012-10-23 21:10:42,18 ... -

HDFS quota 設定

2012-08-02 16:22 5546http://fenriswolf.me/2012/04/04 ... -

hadoop常用的指令

2011-10-09 16:50 1716hadoop job -kill jobid 可以整个的杀掉 ... -

Hadoop基准测试

2011-08-08 10:04 1290http://www.michael-noll.com/ ... -

Hadoop Job Scheduler作业调度器

2011-05-21 11:02 2541http://hi.baidu.com/zhengxiang3 ... -

hadoop指定某个文件的blocksize,而不改变整个集群的blocksize

2011-03-20 17:20 2118文件上传的时候,使用下面的命令即可 hadoop f ... -

Hadoop Job Tuning

2011-02-28 15:53 828http://www.searchtb.com/2010/12 ... -

如何在不重启整个hadoop集群的情况下,增加新的节点

2011-02-25 10:12 14291.在namenode 的conf/slaves文件中增加新的 ... -

对hadoop task进行profiling的几种方法整理

2011-02-10 21:57 1664对hadoop task进行profiling的几种方法整 ... -

hadoop 0.20 程式開發 eclipse plugin

2011-01-26 19:36 2281http://trac.nchc.org.tw/cloud/w ... -

hadoop-0.21.0-eclipse-plugin无法在eclipse中运行解决方案

2011-01-26 09:47 3614LINUX下将hadoop-0.21自带的hadoop ecl ... -

How to Benchmark a Hadoop Cluster

2011-01-19 22:15 2873How to Benchmark a Hadoop Clu ... -

json在线格式化

2010-12-21 16:23 2451http://jsonformatter.curiouscon ... -

Hadoop的mapred TaskTracker端源码概览

2010-11-14 11:24 1299http://jiwenke.iteye.com/blog/3 ...

相关推荐

Eclipse作为一款强大的Java集成开发环境,为开发者提供了丰富的工具来调试Java应用程序,包括基于Hadoop的作业。本篇文章将详细阐述如何利用Eclipse有效地调试Hadoop作业,以及与之相关的源码分析和工具使用技巧。 ...

Hadoop作业调优是提升大数据处理效率的关键环节,通过对Hadoop MapReduce框架中的参数进行精细调整,可以显著改善作业的性能。以下是对标题和描述中涉及的参数及原理的详细说明: 1. **MapTask运行内部原理** - **...

标题《Hive及Hadoop作业调优》与描述《阿里巴巴内部hive优化经验文档》指明了本文档的核心内容,它涉及到了在大数据处理领域内,如何针对Hive以及Hadoop作业进行优化的详细方法和经验分享。标签“hive”, “hadoop”...

### Hadoop实战大数据大作业——基于Hadoop的单词统计系统 #### 一、课题简介与研究意义 **课题简介:** 本课题旨在设计一个简单的基于Hadoop平台进行的单词统计系统。该系统需要自行搭建Hadoop伪分布式架构,并...

这个"hadop实验+作业.zip"文件显然包含了一些与Hadoop相关的实验和作业资料,可能是某个课程或培训项目的材料。以下是对这些知识点的详细解释: 一、Hadoop概述 Hadoop是由Apache软件基金会开发的一个开源框架,它...

基于java+hadoop和hive的微博热词跟踪系统源码+数据集(高分毕业设计项目),本资源中的源码都是经过本地编译过可运行的,评审分达到98分,资源项目的难度比较适中,内容都是经过助教老师审定过的能够满足学习毕业...

"hadoop作业记录档案"可能指的是在Hadoop生态系统中执行的各种作业(jobs)的详细日志和记录,这些记录对于理解作业的运行状态、诊断问题以及优化性能至关重要。 Hadoop的核心组件包括HDFS(Hadoop Distributed ...

### Hadoop集群作业的调度算法详解 #### 一、引言 随着大数据技术的发展,Hadoop作为一款开源的大数据处理框架,在数据存储和处理方面扮演着至关重要的角色。Hadoop的核心组件之一是MapReduce,这是一种分布式计算...

hadoop作业调度的原理和使用流程 hdfs的原理 mapreduce编程

基于java+hadoop和hive的微博热词跟踪系统源码+数据集+详细文档(高分毕业设计).zip基于java+hadoop和hive的微博热词跟踪系统源码+数据集+详细文档(高分毕业设计).zip 【备注】 1、该资源内项目代码都经过测试...

本文将对MapTask类的源代码进行分析,了解其内部机制和实现细节。 MapTask类的成员变量和方法 --------------------------- MapTask类的成员变量包括split和splitClass。split是InputSplit对象的串行化结果,用于...

"Hadoop作业" Hadoop 是一个由 Apache 基金会所开发的分布式系统基础架构。用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。Hadoop 实现了一个分布式文件系统,...

其次,论文对Hadoop作业调度流程进行了介绍,包括JobTracker、TaskTracker、TaskScheduler等。作业调度流程主要包括作业提交、任务分配、任务执行、任务监控等步骤。 最后,论文对论文主要研究内容进行了介绍,包括...

总的来说,基于Hadoop和Hive的微博热词跟踪系统充分利用了分布式计算的优势,实现了对海量微博数据的高效处理和分析。它不仅展示了大数据技术在社交网络分析领域的应用潜力,也为其他领域的大数据处理提供了借鉴和...

通过对Hadoop作业调度机制的研究与优化,特别是关于数据本地性的改进,可以显著提升Hadoop在处理大规模数据集时的整体性能。未来的研究还可以进一步探索更高效的调度算法和技术,以适应不断增长的大数据处理需求。

国科大Hadoop作业.pdf

云计算大作业使用Hadoop对美国新冠肺炎疫情数据分析项目。 实验内容 统计指定日期下,美国每个州的累计确诊人数和累计死亡人数。 对实验1的结果按累计确诊人数进行倒序排序。(重写排序规则) 对实验1的结果再运算,...

【Hadoop 作业提交流程详解】 在Hadoop生态系统中,提交一个MapReduce作业通常通过执行类似`bin/hadoop jar xxx.jar mainclass args`的命令来完成。这个过程看似简单,实际上涉及到了多个步骤和组件的交互。下面...