ÕøĀõĖ║ķĪ╣ńø«ńÜäķ£ĆĶ”ü’╝īÕŁ”õ╣ĀõĮ┐ńö©õ║åHadoop’╝īÕÆīµēƵ£ēĶ┐ćńāŁńÜäµŖƵ£»õĖƵĀĘ’╝īŌĆ£Õż¦µĢ░µŹ«ŌĆØŃĆüŌĆ£µĄĘķćÅŌĆØĶ┐Öń▒╗Ķ»ŹĶ»ŁÕ£©õ║ÆĶüöńĮæõĖŖµ╗ĪÕż®õ╣▒ķŻ×ŃĆéHadoopµś»õĖĆõĖ¬ķØ×ÕĖĖõ╝śń¦ĆńÜäÕłåÕĖāÕ╝Åń╝¢ń©ŗµĪåµ×Č’╝īĶ«ŠĶ«Īń▓ŠÕʦĶĆīõĖöńø«ÕēŹµ▓Īµ£ēÕÉīń║¦Õł½ÕÉīķćŹķćÅńÜäµø┐õ╗ŻÕōüŃĆéÕÅ”Õż¢õ╣¤µÄźĶ¦”Õł░õĖĆõĖ¬Õåģķā©õĮ┐ńö©ńÜäµĪåµ×Č’╝īÕ»╣õ║ÄHadoopÕüÜõ║åÕ░üĶŻģÕÆīÕ«ÜÕłČ’╝īõĮ┐ÕŠŚµø┤µ╗ĪĶČ│õĖÜÕŖĪķ£Ćµ▒éŃĆéµłæµ£ĆĶ┐æõ╣¤µā│ÕåÖõĖĆõ║øHadoopńÜäÕŁ”õ╣ĀÕÆīõĮ┐ńö©Õ┐āÕŠŚ’╝īõĮåµś»ń£ŗÕł░ńĮæõĖŖķéŻõ╣łµ│øµ╗źńÜäµ¢ćń½Ā’╝īµłæĶ¦ēÕŠŚÕåŹÕåÖńé╣ń¼öĶ«░õĖƵĀĘńÜäõĖ£Ķź┐Õ«×Õ£©µś»µ▓Īµ£ēõ╗ĘÕĆ╝ŃĆéÕĆÆõĖŹÕ”éÕ£©µ╝½Õż®ķó鵣īńÜ䵌ČÕĆÖÕåĘķØÖõĖŗµØźń£ŗń£ŗ’╝īµ£ēÕō¬õ║øõĖŹķĆéÕÉłHadoopĶ¦ŻÕå│ńÜäķÜŠķóśÕæó’╝¤

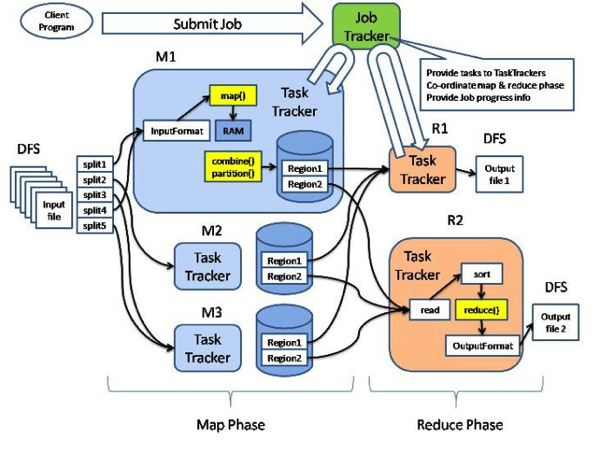

Ķ┐ÖÕ╝ĀÕøŠÕ░▒µś»HadoopńÜäµ×ȵ×äÕøŠ’╝īMapÕÆīReduceµś»õĖżõĖ¬µ£ĆÕ¤║µ£¼ńÜäÕżäńÉåķśČµ«Ą’╝īõ╣ŗÕēŹµ£ēĶŠōÕģźµĢ░µŹ«µĀ╝Õ╝ÅÕ«Üõ╣ēÕÆīµĢ░µŹ«Õłåńēć’╝īõ╣ŗÕÉĵ£ēĶŠōÕć║µĢ░µŹ«µĀ╝Õ╝ÅÕ«Üõ╣ē’╝īõ║īĶĆģõĖŁķŚ┤Ķ┐śÕÅ»õ╗źÕ«×ńÄ░combineĶ┐ÖõĖ¬µ£¼Õ£░reduceµōŹõĮ£ÕÆīpartitionĶ┐ÖõĖ¬ķćŹÕ«ÜÕÉæmapperĶŠōÕć║ńÜäńŁ¢ńĢźĶĪīõĖ║ŃĆéÕÅ»õ╗źÕó×ÕŖĀńÜäÕ«ÜÕłČÕÆīÕó×Õ╝║Õīģµŗ¼’╝Ü

- ĶŠōÕģźµĢ░µŹ«ÕÆīĶŠōÕć║µĢ░µŹ«ńÜäÕ╝║Õī¢’╝īõŠŗÕ”éķĆÜĶ┐ćµĢ░µŹ«ķøåń«ĪńÉåĶĄĘµØź’╝īÕÅ»õ╗źń╗¤õĖĆŃĆüÕÉłÕ╣ČÕÉäÕ╝ŵĢ░µŹ«ķøå’╝īńöÜĶć│õ╣¤ÕÅ»õ╗źń╗ÖµĢ░µŹ«Õó×ÕŖĀĶ┐ćµ╗żµōŹõĮ£õĮ£õĖ║ÕłØńŁø’╝īõ║ŗÕ«×õĖŖõĖÜÕŖĪõĖŖńÜäµĀĖÕ┐āµĢ░µŹ«µ║ɵś»ń¦Źń▒╗ń╣üÕżÜńÜä’╝ø

- µĢ░µŹ«ÕłåńēćńŁ¢ńĢźńÜäµē®Õ▒Ģ’╝īµłæõ╗¼ń╗ÅÕĖĖķ£ĆĶ”üµŖŖÕģĘÕżćµ¤Éõ║øõĖÜÕŖĪÕģ▒µĆ¦ńÜäµĢ░µŹ«µöŠÕł░õĖĆĶĄĘÕżäńÉå’╝ø

- combineÕÆīpartitionńÜäµē®Õ▒Ģ’╝īõĖ╗Ķ”üµś»µ£ēõĖĆõ║øńŁ¢ńĢźÕ«×ńÄ░µś»Õ£©ÕŠłÕżÜHadoopńÜäjobõĖŁķāĮµś»ķĆÜńö©ńÜä’╝ø

- ńøæµÄ¦ÕĘźÕģĘńÜäµē®Õ▒Ģ’╝īĶ┐Öµ¢╣ķØóµłæõ╣¤Ķ¦üĶ┐ćÕł½ńÜäÕģ¼ÕÅĖÕåģķā©Õ«ÜÕłČńÜäÕĘźÕģĘ’╝ø

- ķĆÜĶ«»ÕŹÅĶ««ÕÆīµ¢ćõ╗Čń│╗ń╗¤ńÜäÕó×Õ╝║’╝īÕ░żÕģȵś»µ¢ćõ╗Čń│╗ń╗¤’╝īµ£ĆÕźĮĶāĮńö©ĶĄĘµØźÕāÅµÄźĶ┐æµ£¼Õ£░ÕæĮõ╗żõĖƵĀĘ’╝īĶ┐ÖµĀĘńÜäÕ«ÜÕłČÕ£©õ║ÆĶüöńĮæõĖŖõ╣¤ĶāĮµēŠÕŠŚÕł░’╝ø

- µĢ░µŹ«Ķ«┐ķŚ«ńÜäń╝¢ń©ŗµÄźÕÅŻńÜäĶ┐øõĖƵŁźÕ░üĶŻģ’╝īõĖ╗Ķ”üõ╣¤µś»õĖ║õ║åµø┤ÕłćÕÉłõĖÜÕŖĪ’╝īńö©ńØƵ¢╣õŠ┐’╝ø

- ŌĆ”ŌĆ”

Ķ┐Öõ║øÕ«ÜÕłČõ╗ĵ¤Éń¦Źń©ŗÕ║”õĖŖõ╣¤ÕÅŹÕ║öõ║åHadoopÕ£©Õ«×ķÖģõĮ┐ńö©õĖŁńĢźµä¤Õ▒ĆķÖɵł¢ĶĆģĶ«ŠĶ«ĪµŚČµŚĀµÜćķĪŠÕÅŖńÜäÕ£░µ¢╣’╝īõĮåµś»Ķ┐Öõ║øķāĮµś»Õ░ÅķŚ«ķóś’╝īķāĮµś»ķĆÜĶ┐ćÕ«ÜÕłČÕÆīµē®Õ▒ĢĶāĮÕż¤õ┐«ÕżŹńÜäŃĆéõĮåµś»µ£ēõĖĆõ║øķŚ«ķóś’╝īµś»HadoopÕż®ńö¤µŚĀµ│ĢĶ¦ŻÕå│ńÜä’╝īµł¢ĶĆģĶ»┤’╝īµś»õĖŹķĆéÕÉłõĮ┐ńö©HadoopµØźĶ¦ŻÕå│ńÜäķŚ«ķóśŃĆé

1ŃĆüµ£Ćµ£ĆķćŹĶ”üõĖĆńé╣’╝īHadoopĶāĮĶ¦ŻÕå│ńÜäķŚ«ķóśÕ┐ģķĪ╗µś»ÕÅ»õ╗źMapReduceńÜäŃĆéĶ┐Öķćīµ£ēõĖżõĖ¬ńē╣Õł½ńÜäÕɽõ╣ē’╝īõĖĆõĖ¬µś»ķŚ«ķóśÕ┐ģķĪ╗ÕÅ»õ╗źµŗåÕłå’╝īµ£ēńÜäķŚ«ķóśń£ŗĶĄĘµØźÕŠłÕż¦’╝īõĮåµś»µŗåÕłåÕŠłÕø░ķÜŠ’╝øń¼¼õ║īõĖ¬µś»ÕŁÉķŚ«ķóśÕ┐ģķĪ╗ńŗ¼ń½ŗŌĆöŌĆöÕŠłÕżÜHadoopńÜäµĢÖµØÉõĖŖķØóķāĮõĖŠõ║åõĖĆõĖ¬µ¢Éµ│óķéŻÕźæµĢ░ÕłŚńÜäõŠŗÕŁÉ’╝īµ»ÅõĖƵŁźµĢ░µŹ«ńÜäĶ┐Éń«ŚķāĮõĖŹµś»ńŗ¼ń½ŗńÜä’╝īķāĮÕ┐ģķĪ╗õŠØĶĄ¢õ║ÄÕēŹõĖƵŁźŃĆüÕēŹõ║īµŁźńÜäń╗ōµ×£’╝īµŹóĶ©Ćõ╣ŗ’╝īµŚĀµ│ĢµŖŖÕż¦ķŚ«ķóśÕłÆÕłåµłÉńŗ¼ń½ŗńÜäÕ░ÅķŚ«ķóś’╝īĶ┐ÖµĀĘńÜäÕ£║µÖ»µś»µĀ╣µ£¼µ▓Īµ£ēÕŖ×µ│ĢõĮ┐ńö©HadoopńÜäŃĆé

2ŃĆüµĢ░µŹ«ń╗ōµ×äõĖŹµ╗ĪĶČ│key-valueĶ┐ÖµĀĘńÜ䵩ĪÕ╝ÅńÜäŃĆéÕ£©Hadoop In ActionõĖŁ’╝īõĮ£ĶĆģµŖŖHadoopÕÆīÕģ│ń│╗µĢ░µŹ«Õ║ōÕüÜõ║åµ»öĶŠā’╝īń╗ōµ×äÕī¢µĢ░µŹ«µ¤źĶ»óµś»õĖŹķĆéÕÉłńö©HadoopµØźÕ«×ńÄ░ńÜä’╝łĶÖĮńäČÕāÅHiveĶ┐ÖµĀĘńÜäõĖ£Ķź┐µ©Īµŗ¤õ║åANSI SQLńÜäĶ»Łµ│Ģ’╝ēŃĆéÕŹ│õŠ┐Õ”éµŁż’╝īµĆ¦ĶāĮÕ╝ĆķöĆõĖŹµś»õĖĆĶł¼Õģ│ń│╗µĢ░µŹ«Õ║ōÕÅ»õ╗źµ»öµŗ¤ńÜä’╝īĶĆīÕ”éµ×£µś»ÕżŹµØéõĖĆńé╣ńÜäń╗äÕÉłµØĪõ╗ČńÜ䵤źĶ»ó’╝īĶ┐śµś»õĖŹÕ”éSQLńÜäÕ©üÕŖøÕ╝║Õż¦ŃĆéń╝¢ÕåÖõ╗ŻńĀüĶ░āńö©õ╣¤µś»ÕŠłĶŖ▒Ķ┤╣µŚČķŚ┤ńÜäŃĆé

3ŃĆüHadoopõĖŹķĆéÕÉłńö©µØźÕżäńÉåÕż¦µē╣ķćÅńÜäÕ░ŵ¢ćõ╗ČŃĆéÕģČÕ«×Ķ┐Öµś»ńö▒namenodeńÜäÕ▒ĆķÖɵƦµēĆÕå│Õ«ÜńÜä’╝īÕ”éµ×£µ¢ćõ╗ČĶ┐ćÕ░Å’╝īnamenodeÕŁśÕé©ńÜäÕģāõ┐Īµü»ńøĖÕ»╣µØźĶ»┤Õ░▒õ╝ÜÕŹĀńö©Ķ┐ćÕż¦µ»öõŠŗńÜäń®║ķŚ┤’╝īÕåģÕŁśĶ┐śµś»ńŻüńøśÕ╝ĆķöĆķāĮķØ×ÕĖĖÕż¦ŃĆéÕ”éµ×£õĖƵ¼ĪtaskńÜäµ¢ćõ╗ČÕżäńÉåĶŠāÕż¦’╝īķéŻõ╣łĶÖܵŗ¤µ£║ÕÉ»ÕŖ©ŃĆüÕłØÕ¦ŗÕī¢ńŁēńŁēÕćåÕżćµŚČķŚ┤ÕÆīõ╗╗ÕŖĪÕ«īµłÉÕÉÄńÜäµĖģńÉåµŚČķŚ┤’╝īńöÜĶć│shuffleńŁēńŁēµĪåµ×ȵȳĶĆŚµŚČķŚ┤µēĆÕŹĀńÜäµ»öõŠŗÕ░▒Õ░ÅÕŠŚÕżÜ’╝øÕÅŹõ╣ŗ’╝īÕżäńÉåńÜäÕÉ×ÕÉÉķćÅÕ░▒µÄēõĖŗµØźõ║åŃĆé’╝łµ£ēõ║║ÕüÜõ║åõĖĆõĖ¬Õ«×ķ¬ī’╝īÕÅéķśģ’╝ÜķōŠµÄź’╝ē

4ŃĆüHadoopõĖŹķĆéÕÉłńö©µØźÕżäńÉåķ£ĆĶ”üÕÅŖµŚČÕōŹÕ║öńÜäõ╗╗ÕŖĪ’╝īķ½śÕ╣ČÕÅæĶ»Ęµ▒éńÜäõ╗╗ÕŖĪŃĆéĶ┐Öõ╣¤ÕŠłÕ«╣µśōńÉåĶ¦Ż’╝īõĖŖķØóÕĘ▓ń╗ÅĶ»┤õ║åĶÖܵŗ¤µ£║Õ╝ĆķöĆŃĆüÕłØÕ¦ŗÕī¢ÕćåÕżćµŚČķŚ┤ńŁēńŁē’╝īÕŹ│õĮ┐taskķćīķØóõ╗Ćõ╣łķāĮõĖŹÕüÜÕ«īµĢ┤Õ£░ĶĘæõĖĆķüŹjobõ╣¤Ķ”üĶŖ▒Ķ┤╣ÕćĀÕłåķƤµŚČķŚ┤ŃĆé

5ŃĆüHadoopĶ”üÕżäńÉåń£¤µŁŻńÜäŌĆ£Õż¦µĢ░µŹ«ŌĆØ’╝īµŖŖscale upń£¤µŁŻÕÅśµłÉscale out’╝īõĖżÕÅ░Õ░ÅńĀ┤µ£║ÕÖ©’╝īµł¢ĶĆģÕćĀŃĆüÕŹüÕćĀGBĶ┐Öń¦ŹµĢ░µŹ«ķćÅ’╝īńö©HadoopÕ░▒µśŠÕŠŚń▓Śń¼©õ║åŃĆéÕ╝鵣źń│╗ń╗¤µ£¼Ķ║½ńÜäńø┤Ķ¦éµĆ¦Õ╣ČõĖŹÕāÅķéŻõ║øÕÉīµŁźń│╗ń╗¤µØźÕŠŚÕźĮ’╝īĶ┐Öµś»µśŠĶĆīµśōĶ¦üńÜäŃĆéµēĆõ╗źÕ¤║µ£¼õĖŖµØźĶ»┤’╝īń╗┤µŖżµłÉµ£¼õĖŹõ╝ÜõĮÄŃĆé

µ¢ćń½Āń│╗µ£¼õ║║ÕÄ¤Õłø’╝īĶĮ¼ĶĮĮĶ»Ęõ┐صīüÕ«īµĢ┤µĆ¦Õ╣ȵ│©µśÄÕć║Ķć¬ŃĆŖÕøøńü½ńÜäÕöĀÕÅ©ŃĆŗ

ńøĖÕģ│µÄ©ĶŹÉ

Hadoopµś»Õż¦µĢ░µŹ«ÕżäńÉåńÜäķćŹĶ”üÕĘźÕģĘ’╝īõĮåµś»Õ£©Õ«ēĶŻģÕÆīõĮ┐ńö©HadoopµŚČ’╝īÕÅ»ĶāĮõ╝ÜÕć║ńÄ░õĖĆõ║øÕĖĖĶ¦üńÜäķŚ«ķóś’╝īĶ┐Öõ║øķŚ«ķóśÕÅ»ĶāĮõ╝ÜÕ»╝Ķć┤HadoopµŚĀµ│ĢµŁŻÕĖĖÕĘźõĮ£’╝īµł¢ĶĆģµŚĀµ│ĢĶŠŠÕł░ķóäµ£¤ńÜäµĆ¦ĶāĮŃĆéõĖŗķØ󵜻HadoopÕĖĖĶ¦üńÜäķŚ«ķóśÕÅŖĶ¦ŻÕå│µ¢╣µ│Ģ’╝Ü 1ŃĆüNameNodeÕÉ»ÕŖ©µŚČ...

õĮåµś»Õ£©õĮ┐ńö© Hadoop Ķ┐ćń©ŗõĖŁ’╝īµłæõ╗¼ń╗ÅÕĖĖõ╝ÜķüćÕł░õĖĆõ║øķöÖĶ»»ÕÆīķŚ«ķóś’╝īµ£¼µ¢ćÕ░åõĖ║µé©µÅÉõŠøõĖĆõ║øÕĖĖĶ¦üńÜä Hadoop µĢģķÜ£Ķ¦ŻÕå│µ¢╣µ│ĢŃĆé õĖĆŃĆüShuffle Error: Exceeded MAX_FAILED_UNIQUE_FETCHES; bailing-out Ķ┐ÖõĖ¬ķöÖĶ»»µś»ńö▒õ║Äń│╗ń╗¤ķ╗śĶ«żńÜäµēōÕ╝Ć...

### HadoopķøåńŠżķüćÕł░ńÜäķŚ«ķóśÕÅŖÕģČĶ¦ŻÕå│µ¢╣µ│Ģ #### Õ╝éÕĖĖõĖĆ’╝ÜDataNodeµŚĀµ│ĢĶ┐×µÄźÕł░NameNode **ķŚ«ķóśµÅÅĶ┐░’╝Ü** Õ£©HadoopķøåńŠżķā©ńĮ▓Ķ┐ćń©ŗõĖŁ’╝īń╗ÅÕĖĖõ╝ÜÕć║ńÄ░DataNodeµŚĀµ│ĢµłÉÕŖ¤Ķ┐×µÄźÕł░NameNodeńÜäµāģÕåĄ’╝īÕ»╝Ķć┤ķøåńŠżµŚĀµ│ĢµŁŻÕĖĖÕÉ»ÕŖ©ŃĆé **ÕĤÕøĀÕłåµ×É...

Õ£© Hadoop õĖŁ’╝īShuffle Error µś»õĖĆõĖ¬ÕĖĖĶ¦üńÜäķŚ«ķóś’╝īõĖ╗Ķ”üµś»ńö▒õ║Äń│╗ń╗¤ķ╗śĶ«żńÜäµ¢ćõ╗ȵēōÕ╝ƵĢ░ķÖÉÕłČÕż¬Õ░Å’╝īÕ»╝Ķć┤ń©ŗÕ║ŵŚĀµ│ĢµŁŻÕĖĖĶ┐ÉĶĪīŃĆéĶ¦ŻÕå│µ¢╣µ│Ģµś»õ┐«µö╣ `/etc/security/limits.conf` µ¢ćõ╗Č’╝īÕó×ÕŖĀµ¢ćõ╗ȵēōÕ╝ƵĢ░ńÜäķÖÉÕłČ’╝īÕ░å `nofile` ńÜäÕĆ╝Ķ«ŠńĮ«...

HadoopÕĖĖĶ¦üķŚ«ķóśÕÅŖĶ¦ŻÕå│ÕŖ×µ│Ģµ▒ćµĆ╗ Hadoopµś»õĖĆõĖ¬Õ¤║õ║ÄApacheńÜäÕ╝Ƶ║ÉÕż¦µĢ░µŹ«ÕżäńÉåµĪåµ×Č’╝īÕ╣┐µ│øÕ║öńö©õ║ÄÕż¦µĢ░µŹ«ÕżäńÉåŃĆüµĢ░µŹ«Õłåµ×ÉÕÆīµ£║ÕÖ©ÕŁ”õ╣ĀńŁēķóåÕ¤¤ŃĆé...ÕÉīµŚČ’╝īķ£ĆĶ”üµ│©µäÅńÜ䵜»’╝īÕ£©Ķ¦ŻÕå│ķŚ«ķ󜵌Ȓ╝īķ£ĆĶ”üÕ░ÅÕ┐āÕ£░Õżćõ╗ĮķćŹĶ”üµ¢ćõ╗Č’╝īõ╗źÕģŹķĆĀµłÉµĢ░µŹ«õĖóÕż▒ŃĆé

Hadoop µ¢ćõ╗ČõĖŖõ╝ĀÕż▒Ķ┤źÕĤÕøĀÕłåµ×ÉÕÅŖĶ¦ŻÕå│µ¢╣µ│Ģ µ£¼µ¢ćõĖ╗Ķ”üĶ«©Ķ«║õ║åÕ£© Java Web ń©ŗÕ║ÅõĖŁõĖŖõ╝Āµ¢ćõ╗ČÕł░ Hadoop HDFS µ¢ćõ╗Čń│╗ń╗¤õĖŁÕż▒Ķ┤źńÜäÕĤÕøĀÕłåµ×ÉÕÅŖĶ¦ŻÕå│µ¢╣µ│ĢŃĆéķĆÜĶ┐ćÕ»╣ķŚ«ķóśńÜäÕłåµ×ÉÕÆīĶ¦ŻÕå│’╝īÕÅ»õ╗źµĆ╗ń╗ōÕć║õ╗źõĖŗń¤źĶ»åńé╣’╝Ü 1. Hadoop µ¢ćõ╗ČõĖŖõ╝ĀÕż▒Ķ┤ź...

µŚĀĶ«║µś»ķĆÜĶ┐ćµĖģńÉåõĖ┤µŚČµ¢ćõ╗ČÕ╣Čķ揵¢░µĀ╝Õ╝ÅÕī¢ķøåńŠż’╝īĶ┐śµś»ķĆÜĶ┐ćµēŗÕŖ©õ┐«µö╣ĶŖéńé╣ID’╝īķāĮĶāĮµ£ēµĢłĶ¦ŻÕå│ķŚ«ķóśŃĆéĶ┐ÖõĖżń¦Źµ¢╣µ│ĢÕÉäµ£ēõ╝śń╝║ńé╣’╝īķĆēµŗ®Õō¬ń¦Źµ¢╣Õ╝ÅÕÅ¢Õå│õ║ÄÕģĘõĮōµāģÕåĄÕÆīõĖ¬õ║║ÕüÅÕźĮŃĆéÕĖīµ£øµ£¼µ¢ćµÅÉõŠøńÜäµīćÕŹŚĶāĮÕż¤ÕĖ«ÕŖ®µé©Õ┐½ķƤĶ»Ŗµ¢ŁÕ╣ČĶ¦ŻÕå│HadoopķøåńŠżõĖŁńÜä...

Ķ¦ŻÕå│Ķ┐ÖõĖ¬ķŚ«ķóśńÜäµ¢╣µ│Ģµś»µŻĆµ¤ź Hadoop ķøåńŠżńÜäķģŹńĮ«’╝īńĪ«õ┐Ø WEBHDFS µ£ŹÕŖĪÕĘ▓ń╗ÅÕÉ»ÕŖ©’╝īÕ╣ČõĖö Logstash ńÜäķģŹńĮ«µŁŻńĪ«µŚĀĶ»»ŃĆé õ║īŃĆü Pipeline aborted due to error µŖźķöÖ Õ£© Logstash õĖŁ’╝īPipeline µś»õĖĆõĖ¬ÕżäńÉåµĢ░µŹ«ńÜ䵥üń©ŗ’╝īõĮåµś»Õ”éµ×£...

Õ£©ITĶĪīõĖÜõĖŁ’╝īHadoopµś»õĖĆõĖ¬Õ╣┐µ│øõĮ┐ńö©ńÜäÕ╝Ƶ║ɵĪåµ×Č’╝īõĖ╗Ķ”üńö©õ║ÄÕż¦µĢ░µŹ«ÕżäńÉåÕÆīÕłåÕĖāÕ╝ÅÕŁśÕé©ŃĆé...Õ»╣õ║ĵā│Ķ”üÕ£©WindowsõĖŖµÄóń┤óHadoopõĖ¢ńĢīńÜäõ║║µØźĶ»┤’╝īµĘ▒ÕģźńÉåĶ¦ŻĶ┐Öõ║øń╗äõ╗ČÕÅŖÕģČÕĘźõĮ£ÕĤńÉåÕ░åµ×üÕż¦Õ£░µÅÉÕŹćÕģȵŖƵ£»µ░┤Õ╣│ÕÆīĶ¦ŻÕå│ķŚ«ķóśńÜäĶāĮÕŖøŃĆé

Ķ┐ÖõĖĆķŚ«ķóśķĆÜÕĖĖĶĪ©ńÄ░õĖ║’╝īÕ£©Õ░ØĶ»ĢÕÉ»ÕŖ©HadoopķøåńŠżµŚČ’╝īDatanodeµŚĀµ│ĢµŁŻÕĖĖÕÉ»ÕŖ©’╝īÕ╣ČõĖöÕ£©Ķ«┐ķŚ«NameNodeńÜäWebńĢīķØóµŚČÕÅæńÄ░ń╝║Õ░æDatanodeńÜäńøĖÕģ│õ┐Īµü»ŃĆéĶ┐Öń¦ŹµāģÕåĄõ╝ÜõĖźķćŹÕĮ▒ÕōŹHadoopķøåńŠżńÜäÕÅ»ńö©µĆ¦ÕÆīµĢ░µŹ«ÕżäńÉåĶāĮÕŖøŃĆé #### õ║īŃĆüÕĤÕøĀÕłåµ×É µĀ╣µŹ«...

µĆ╗ń╗ōµØźĶ»┤’╝ī`hadoop.dll`ÕÆī`winutils.exe`µś»HadoopÕ£©WindowsńÄ»ÕóāõĖŁńÜäõĖżõĖ¬Õģ│ķö«ń╗äõ╗Č’╝īÕ«āõ╗¼Ķ¦ŻÕå│õ║åÕ£©ķØ×LinuxÕ╣│ÕÅ░õĖŖĶ┐ÉĶĪīHadoopµŚČķüćÕł░ńÜäÕģ╝Õ«╣µĆ¦ķŚ«ķóśŃĆéķĆÜĶ┐ćÕ░åĶ┐ÖõĖżõĖ¬µ¢ćõ╗ȵöŠÕģźHadoopńÜä`bin`ńø«ÕĮĢÕ╣ȵŁŻńĪ«ķģŹńĮ«ńÄ»ÕóāÕÅśķćÅ’╝īńö©µłĘÕÅ»õ╗źÕ£©...

µŁżÕż¢’╝īWindowsõĖŖńÜäHadoopÕ«ēĶŻģÕÆīĶ░āĶ»ĢÕÅ»ĶāĮķüćÕł░µø┤ÕżÜķŚ«ķóś’╝īՔ鵢ćõ╗ȵØāķÖÉķŚ«ķóśŃĆüń║┐ń©ŗķŚ«ķóśńŁē’╝īķ£ĆĶ”üÕ╝ĆÕÅæĶĆģÕģĘÕżćõĖĆÕ«ÜńÜäĶ¦ŻÕå│ķŚ«ķóśńÜäĶāĮÕŖøŃĆé µĆ╗ńÜäµØźĶ»┤’╝ī`winutils.exe`ÕÆī`hadoop.dll`µś»HadoopÕ£©WindowsõĖŖĶ┐ÉĶĪīńÜäÕ¤║ń¤│’╝īÕ«āõ╗¼õĮ┐ÕŠŚÕ╝ĆÕÅæĶĆģ...

µ¢ćń½Āńø«ÕĮĢĶ¦ŻÕå│ÕŖ×µ│Ģ1’╝ÜĶ¦ŻÕå│ÕŖ×µ│Ģ2’╝ÜĶ¦ŻÕå│ÕŖ×µ│Ģ3’╝ÜĶ¦ŻÕå│ÕŖ×µ│Ģ4’╝ÜĶ¦ŻÕå│ÕŖ×µ│Ģ5’╝Ü Ķ¦ŻÕå│ÕŖ×µ│Ģ1’╝Ü õ┐«µö╣selinux [root@djt002 hadoop]# vi /etc/selinux/config Ķ¦ŻÕå│ÕŖ×µ│Ģ2’╝Ü µ¤źń£ŗõĮĀńÜä$HADOOP_HOME/etc/hadoopõĖŗńÜäcore-site.xmlÕÆī...

µ£¼µ¢ćÕ░åĶ»”ń╗åõ╗ŗń╗ŹĶ┐ÖõĖżõĖ¬µ¢ćõ╗ČÕÅŖÕģČÕ£©Hadoopńö¤µĆüń│╗ń╗¤õĖŁńÜäõĮ£ńö©’╝īõ╗źÕÅŖÕ”éõĮĢĶ¦ŻÕå│Õ«āõ╗¼ń╝║Õż▒ńÜäķŚ«ķóśŃĆé ķ”¢Õģł’╝ī`hadoop.dll`µś»õĖĆõĖ¬ÕŖ©µĆüķōŠµÄźÕ║ōµ¢ćõ╗Č’╝īõĖ╗Ķ”üÕ£©WindowsµōŹõĮ£ń│╗ń╗¤õĖŖńö©õ║ĵö»µīüHadoopµ£¼Õ£░Ķ┐ÉĶĪīµŚČńÄ»ÕóāŃĆéÕ«āÕīģÕɽõ║åHadoopÕ£©Windows...

ÕÉīµŚČ’╝īńö▒õ║ÄHadoopńÜäWindowsµö»µīüµ£ēµŚČÕÅ»ĶāĮÕŁśÕ£©Õģ╝Õ«╣µĆ¦ķŚ«ķ󜵳¢µø┤µ¢░õĖŹÕÅŖµŚČ’╝īÕøĀµŁż’╝īÕ»╣õ║ÄķéŻõ║øµŚĀµ│ĢĶ┐×µÄźÕł░Õż¢ńĮæńÜäńö©µłĘ’╝īµÅÉõŠøĶ┐ÖµĀĘńÜäķóäń╝¢Ķ»æńēłµ£¼’╝łÕ”éÕÄŗń╝®ÕīģõĖŁńÜäµ¢ćõ╗Č’╝ēńĪ«Õ«×ĶāĮÕĖ”µØźÕŠłÕż¦ńÜäÕĖ«ÕŖ®’╝īķü┐ÕģŹõ║åĶć¬ĶĪīń╝¢Ķ»æÕÆīĶ¦ŻÕå│õŠØĶĄ¢ńÜäÕø░µē░ŃĆé...

7. **µŚźÕ┐ŚÕÆīĶ░āĶ»Ģ**’╝ÜÕ£©Ķ¦ŻÕå│ķŚ«ķóśńÜäĶ┐ćń©ŗõĖŁ’╝īµ¤źń£ŗHadoopÕÆīMahoutńÜ䵌źÕ┐Śõ┐Īµü»µś»ķØ×ÕĖĖķćŹĶ”üńÜäŃĆéķĆÜĶ┐ćHadoopńÜäYARNµŚźÕ┐ŚÕÆīMahoutńÜäĶć¬Õ«Üõ╣ēµŚźÕ┐Ś’╝īÕÅ»õ╗źÕ«ÜõĮŹķöÖĶ»»ÕÅæńö¤ńÜäÕģĘõĮōõĮŹńĮ«’╝īõ╗ÄĶĆīĶ┐øĶĪīõ┐«ÕżŹŃĆé Õ£©Ķ¦ŻÕå│Ķ┐Öõ║øķŚ«ķ󜵌Ȓ╝īõ╗źõĖŗµŁźķ¬żÕÅ»ĶāĮõ╝Ü...

µĀćķóśõĖŁńÜäŌĆ£õĖŹÕÉīHadoopńēłµ£¼winutilsµ¢ćõ╗ČÕīģŌĆصīćńÜ䵜»Õ£©WindowsńÄ»ÕóāõĖŗõĮ┐ńö©HadoopµŚČ’╝īķ£ĆĶ”üńÜäõĖĆõĖ¬Õģ│ķö«ń╗äõ╗ČŌĆöŌĆöwinutils.exeŃĆé...Õ»╣õ║ÄÕż¦µĢ░µŹ«õ╗ÄõĖÜĶĆģÕÆīÕ╝ĆÕÅæĶĆģĶĆīĶ©Ć’╝īµÄīµÅĪĶ┐Öõ║øń¤źĶ»åÕ»╣õ║ĵÅÉÕŹćÕĘźõĮ£µĢłńÄćÕÆīĶ¦ŻÕå│ķŚ«ķóśĶć│Õģ│ķćŹĶ”üŃĆé

µŁżÕż¢’╝īõ║åĶ¦ŻHadoopńÜäÕ¤║µ£¼µ”éÕ┐Ą’╝īÕ”éHDFS’╝łHadoop Distributed File System’╝ēÕÆīMapReduce’╝īõ╗źÕÅŖYARN’╝łYet Another Resource Negotiator’╝ēńÜäÕĤńÉå’╝īõ╣¤ĶāĮÕĖ«ÕŖ®ńÉåĶ¦ŻõĖ║õ╗Ćõ╣łĶ┐ÖõĖ¬dllµ¢ćõ╗ČÕ”éµŁżķćŹĶ”ü’╝īÕ╣ȵ£ēÕŖ®õ║ÄĶ¦ŻÕå│ķŚ«ķóśŃĆé µĆ╗ńÜäµØźĶ»┤...